AI dönüşümünde rehberli tur: Uzmanlar ve yöneticiler için bir atölye raporu

Xpert ön sürümü

Dil seçimi 📢

Yayınlanan: 10 Mayıs 2025 / Güncelleme: 10 Mayıs 2025 - Yazar: Konrad Wolfenstein

AI ile şimdi bilmesi gereken yöneticiler: Fırsatlar alın, riskleri yönetin, güvenle liderlik edin (okuma süresi: 32 dk / reklam yok / ödeme duvarı yok)

AI Devrimi Usta: Yöneticilere Giriş

Yapay zekanın dönüştürücü gücünü yeniden tasarlayın: İş ve değer yaratmayı yeniden tasarlayın

Yapay Zeka (AI), iş ve değer yaratmayı temel olarak yeniden düşünmek için başka yeni olasılıklar gibi açılmayan bir teknoloji olarak kabul edilir. Şirketler için yapay zekanın entegrasyonu, uzun vadede başarılı ve rekabetçi kalmak için çok önemli bir adımdır, çünkü yeniliği teşvik eder, verimliliği artırır ve kaliteyi artırır. Yapay zekanın ekonomik ve sosyal etkileri dikkate değerdir; En önemli dijital gelecekteki konulardan biridir, hızla gelişir ve muazzam bir potansiyele sahiptir. Şirketler otomasyonun avantajlarını giderek daha fazla tanıyor ve AI tarafından verimliliği artırıyor. Bu sadece teknolojik bir değişiklik değil, aynı zamanda yarışmada hayatta kalma ihtiyacına uyum sağlayan iş modellerinde, süreç optimizasyonlarında ve müşteri etkileşimlerinde temel bir değişikliktir.

Yapay zekanın çok önemli “dönüştürücü gücü” yeni araçların saf tanıtımının ötesine geçer; Stratejik düşüncede bir paradigma değişimi anlamına gelir. Yöneticilerin temel süreçleri, değer vaadini ve hatta endüstri yapılarını yeniden değerlendirmeleri gerekmektedir. AI'yı yalnızca bir verimlilik aracı olarak görüyorsanız, daha derin stratejik potansiyelinizi gözden geçirme riskini taşırsınız. Yapay zekanın hızlı gelişimi mevcut yetenekli işçi sıkıntısını karşılamaktadır. Bu çifte bir meydan okuma yaratır: Bir yandan, AI kullanabilmek için hızlı bir şekilde daha fazla yeterlilik için acil bir ihtiyaç vardır. Öte yandan, KI görevleri otomatikleştirme ve böylece bazı bölgelerde yetenekli işçi sıkıntısını potansiyel olarak hafifletirken, aynı zamanda yeni yeterlilik gereksinimleri ortaya çıkıyor. Bu, yöneticilerin nüanslı personel planlamasını gerektirir.

İçin uygun:

- Şirkette iş artırıcı olarak yapay zeka - on bir geçici yöneticiden yapay zekanın şirketlere tanıtılmasına yönelik diğer pratik ipuçları

Yapay zeka çağında tartma fırsatları ve riskler

Her ne kadar AI sistemleri oldukça etkili fırsatlar sunsa da, yönetilmesi gereken risklerle ayrılmaz bir şekilde bağlantılıdır. AI çevresindeki söylem, avantajları kullanmak ve dezavantajları en aza indirmek için dengeli bir yaklaşım gerektiren doğal itici güçlere karşı önemli potansiyelinizi düşünmeyi içerir. Şirketler, yenilikleri teşvik etme ve aynı zamanda veri koruma ve etik kurallara uyma zorluğu ile karşı karşıyadır, bu da ilerleme ve uyum arasındaki dengeyi belirleyici hale getirir.

Bu dengeleme eylemi tek bir karar değil, devam eden bir stratejik ihtiyaçtır. AI Technologies'in daha da geliştirilmesiyle, örneğin özel AI'dan daha genel becerilere doğru-fırsatların ve risklerin türü de değişecektir. Bu, yönetişim ve stratejinin sürekli yeniden değerlendirilmesi ve uyarlanmasını gerektirir. Yapay zeka risklerinin ve avantajlarının algılanması bir kuruluş içinde önemli ölçüde değişebilir. Örneğin, aktif AI kullanıcıları henüz AI'yı tanıtmamış olanlardan daha iyimser olma eğilimindedir. Bu, yöneticiler için değişim yönetiminde kritik bir zorluğu göstermektedir: algıdaki bu boşluk, eğitim, açık iletişim ve aynı anda endişelerin ele alınmasıyla somut avantajların gösterilmesi ile sonuçlandırılmalıdır.

AI manzarasını anlayın: temel kavramlar ve teknolojiler

Üretken Ki (Genai) ve Yapay Genel İstihbarat (AGI)

Üretken Ki (Genai)

Generatif Ki (Genai), yazılı metin, ses, görüntü veya video şeklinde yeni içerik oluşturmak için tasarlanmış AI modellerini ifade eder ve çok çeşitli uygulamalar sunar. GENAI, kullanıcıları benzersiz, anlamlı içerik oluşturmada destekler ve akıllı bir soru-cevap sistemi veya kişisel asistan olarak hareket edebilir. Genai zaten içerik, pazarlama ve müşteri sadakatinin yaratılmasında kişiselleştirilmiş malzemelerin hızlı bir şekilde üretilmesini ve cevapların otomasyonunu mümkün kılar.

Anında erişilebilirlik ve Genai'den gelen geniş uygulama yelpazesi, çoğu kuruluş için “giriş seviyesi AI” nı temsil ettiği anlamına gelir. Bu ilk dokunuş algısını şekillendirir ve daha geniş AI adaptasyonunu sürebilir veya engelleyebilir. Yöneticiler olumlu dinamikler oluşturmak için bu ilk deneyimleri dikkatlice kontrol etmelidir.

Yapay Genel İstihbarat (AGI)

Yapay Genel Zeka (AGI), bir kişinin insan bilişsel becerilerini yönetebileceği ve böylece taklit edebileceği herhangi bir entelektüel görevi anlayabilen veya öğrenebilen bir makinenin varsayımsal zekasını ifade eder. Spesifikleştirilmiş olarak uzmanlaşmış olmak yerine çok çeşitli görevler gerçekleştirebilen AI sistemleri ile ilgilidir.

Gerçek AGI şu anda mevcut değil; Bir kavram ve bir araştırma hedefi olmaya devam ediyor. Bu alanda lider bir şirket olan Openai, AGI'yi "insanların ekonomik olarak en değerli çalışmalarda aştığı yüksek -otonom sistemler" olarak tanımlamaktadır. 2023 yılına gelindiğinde, "ortaya çıkan AI" olarak adlandırılan beş yükselen AGI seviyesinden sadece ilkine ulaşıldı.

AGI'nın belirsizliği ve farklı tanımları, yöneticilerin AGI'nin derhal operasyonel bir endişeden daha uzun, potansiyel olarak dönüştürücü bir ufuk düşünmesi gerektiğini önermektedir. Odak noktası mevcut “güçlü AI” nı kullanmak ve aynı zamanda AGI'nın ilerlemesini stratejik olarak gözlemlemek olmalıdır. Spekülatif AGI senaryolarına yapılan yatırımlar, kaynakları daha acil AI fırsatlarından uzaklaştırabilir. AGI ile ilgili devam eden araştırmalara yönelik Genai aracılığıyla uzmanlaşmış yapay zekanın geliştirilmesi, artan bir özerklik ve AI sistemlerinin performansı anlamına gelir. Bu eğilim, daha güçlü AI, istismar veya kasıtsız sonuçlar için daha büyük bir potansiyel taşıydığı için, güçlü etik çerçeve koşullarına ve yönetişime olan ihtiyaç artan bir ihtiyaç ile doğrudan ilişkilidir.

İçin uygun:

AI Asistanı ve AI Temsilcisi: Rolleri ve Becerileri Tanımlayın

AI asistanları insanları bireysel görevlerde destekler, sorulara tepki verir, soruları cevaplar ve önerilerde bulunur. Genellikle reaktiftirler ve insan komutlarını beklerler. Erken asistanlar düzenli olarak dayanıyordu, ancak modern olanlar makine öğrenimi (ML) veya temel modellere dayanıyor. Buna karşılık, AI ajanları daha özerktir ve hedefleri takip edebilir ve minimum insan müdahalesiyle bağımsız olarak kararlar verebilirler. Proaktiftirler, çevreleriyle etkileşime girebilir ve öğrenerek uyarlayabilirler.

Ana farklılıklar özerklik, görev karmaşıklığı, kullanıcı etkileşimi ve karar becerilerinde yatmaktadır. Asistanlar insan kararları için bilgi verirken, ajanlar kararlar verebilir ve gerçekleştirebilir. Uygulama alanında asistanlar müşteri deneyimini geliştirir, banka sorularındaki İK görevlerini destekler ve optimize eder. Öte yandan ajanlar, kullanıcı davranışına gerçek zamanlı olarak uyum sağlayabilir, proaktif olarak sahtekarlığı önleyebilir ve Talenta Pancial gibi karmaşık İK süreçlerini otomatikleştirebilir.

AI asistanlarından AI ajanlarına geçiş, AI'dan bir "araç" olarak AI'ya "işbirlikçisi" veya hatta "otonom çalışan" olarak bir gelişimin olduğuna işaret etmektedir. Bunun, çalışma tasarımı, ekip yapıları ve onları giderek daha fazla yönetmek ve bunlarla çalışmak zorunda olan insan çalışanlarının gerekli becerileri üzerinde derin etkileri vardır. AI ajanları giderek daha yaygın hale geldiğinden ve bağımsız kararlar verebildiğinden, "hesap verebilirlik boşluğu" daha acil bir sorun haline gelir. Bir AI ajanı yanlış bir karar verirse, sorumluluk tahsisi karmaşık hale gelir. Bu, otonom sistemlerin benzersiz zorluklarını ele alan sağlam bir AI hükümetinin kritik gerekliliğinin altını çizmektedir.

Aşağıda en önemli ayırt edici özelliklerin karşılaştırılması:

AI asistanlarının ve AI ajanlarının karşılaştırılması

Bu tablo, yöneticilere, belirli ihtiyaçlar için doğru teknolojiyi seçmek ve farklı denetim ve entegrasyon karmaşıklığını tahmin etmek için temel farklılıklar hakkında net bir anlayış sunmaktadır.

AI asistanları ve AI ajanları arasındaki karşılaştırma, özelliklerinde önemli farklılıklar göstermektedir. AI asistanları oldukça reaktif ve insan komutlarını beklerken, AI ajanları bağımsız hareket ederek proaktif ve özerk bir şekilde hareket eder. Bir AI asistanının birincil işlevi, talep üzerine görevlerin yürütülmesinde yatarken, bir AI temsilcisi hedefe ulaşmaya yöneliktir. AI asistanları insanları karar vermede desteklerken, AI ajanları kararlar alır ve uygulayabilir. İkisinin öğrenme davranışı da farklıdır: AI asistanı çoğunlukla sınırlı ve versiyon tabanlı öğrenirken, AI ajanları uyarlanabilir ve sürekli öğrenme. AI asistanlarının ana uygulamaları arasında sohbet botları ve bilgi çağrısı bulunmaktadır, ancak AI ajanlarının uygulama alanları arasında süreç otomasyonu, sahtekarlık tespiti ve karmaşık problemlerin çözümü bulunmaktadır. İnsanlarla etkileşim AI asistanı için sürekli girdi gerektirirken, AI ajanları için sadece minimal insan müdahalesi gereklidir.

Makine Odası: Makine Öğrenimi, Büyük Ses Modelleri (LLMS) ve Temel Modeller

Makine Öğrenimi (ML)

Makine öğrenimi, bilgisayarların verilerden öğrendiği ve açıkça programlanmadan deneyimle geliştiği AI'nın bir alt -alanıdır. Algoritmalar, büyük veri setlerinde kalıplar bulmak ve buna dayanan kararlar ve tahminler yapmak için eğitilmiştir. ML modelleri, izlenen öğrenme (işaretli verilerden öğrenme), aşılmaz öğrenme (işaretlenmemiş verilerde kalıplar bulma), kısmen izlenen öğrenme (işaretli ve işaretli verilerin karışımı) ve öğrenme (ödüllerle deneyler yoluyla öğrenme) içerir. ML verimliliği artırır, hataları en aza indirir ve şirketlerde karar vermeyi destekler.

Farklı makine öğrenimi türlerini anlamak, sadece teknik açıdan yöneticiler için değil, aynı zamanda veri gereksinimlerini anlamak için de önemlidir. Örneğin izlenen öğrenme, veri stratejisi ve yatırımları üzerinde etkisi olan büyük miktarlarda yüksek kaliteli, belirgin veri kayıtları gerektirir. İş sorunu tanımlaması başlangıçta olsa da, belirli bir ML tipinin uygulanabilirliği büyük ölçüde veri türüne ve türüne bağlı olacaktır.

Büyük Ses Modelleri (LLMS)

Büyük sesli modeller, büyük veri kayıtlarında eğitilmiş ve doğal dildeki sorulara yanıt vermek için genellikle doğal dil işleme (NLP) uygulamalarında kullanılan bir tür derin öğrenme algoritmasıdır. Bunun örnekleri Openai'den GPT serisidir. LLM'ler insan benzeri metinler oluşturabilir, sohbet botları kullanabilir ve otomatik müşteri hizmetlerini destekleyebilir. Bununla birlikte, eğitim verilerinden yanlışlıkları ve bozulmaları da ele geçirebilir ve telif hakkı ve güvenlik ile ilgili endişeleri artırabilirsiniz.

Eğitim verilerinden tam anlamıyla metin çıkardığınız LLMS'de "ezberleme" sorunu, LLM tarafından üretilen içerik kullanan şirketler için önemli telif hakkı ve intihal riskleri barındırır. Bu, dikkatli bir inceleme süreçleri ve LLM baskılarının kökeni hakkında bir anlaşma gerektirir.

Temel modeller

Temel modeller, geniş veriler üzerinde eğitilmiş ve çeşitli aşağı akış görevleri için uyarlanabilen (ince ayarlanmış) büyük AI modelleridir. Bunlar ortaya çıkış (beklenmedik beceriler) ve homojenleştirme (ortak mimari) ile karakterizedir. Klasik AI modellerinden farklı oldukları, başlangıçta evsel spesifik oldukları, kendi kendine izlenen öğrenmeyi kullanmaları, aktarım öğrenmeyi etkinleştirmeleri ve genellikle çok modlu oldukları (metin, görüntü, ses). LLM'ler bir tür temel modeldir. Avantajlar daha hızlı piyasa erişimi ve ölçeklenebilirlik içerir, ancak zorluklar şeffaflık ("kara kutu" problemi), veri koruması ve yüksek maliyetler veya altyapı gereksinimleridir.

Temel modellerin yükselişi, daha çok yönlü ve daha uyarlanabilir AI'ya doğru bir değişikliğe işaret eder. Bununla birlikte, "kara kutu" doğanız ve antrenmanınız veya ince ayar için gerekli olan önemli kaynaklar, erişim ve kontrolün yoğunlaşabileceği anlamına gelir, bu da birkaç büyük sağlayıcıya potansiyel olarak bağımlılıklar yaratır. Bunun "yap veya satın alma" kararları ve satıcı kilitleme riski üzerinde stratejik etkileri vardır. Birçok temel modelin multimodal yeteneği, bulguları farklı veri türlerinden sentezleyebilen tamamen yeni uygulama kategorileri açar (örneğin metin raporlarının kamera kayıtlarıyla birlikte analizi). Bu, metnin odaklı LLM'lerin yapabileceği ötesine geçer ve mevcut veritabanları hakkında daha geniş düşünmeyi gerektirir.

Düzenleyici Pusula: Yasal ve etik çerçeve koşullarında gezinme

AB KI Yasası: Şirketler için temel hükümler ve etkiler

1 Ağustos 2024'te yürürlüğe giren AB KI Yasası, dünyanın ilk kapsamlı AI yasasıdır ve AI için riske dayalı bir sınıflandırma sistemi oluşturur.

Risk kategorileri:

- Çıkarılmaz risk: Güvenlik, geçim ve haklar için açık bir tehdit temsil eden AI sistemleri yasaktır. Bunun örnekleri, kamu yetkilileri tarafından sosyal puanlama, davranışın bilişsel manipülasyonu ve yüz resimlerinin istenmeyen okunmasıdır. Bu yasakların çoğu 2 Şubat 2025'e kadar yürürlüğe giriyor.

- Yüksek risk: Güvenliği veya temel hakları olumsuz etkileyen AI sistemleri. Bunlar, risk yönetim sistemleri, veri yönetişimi, teknik dokümantasyon, insan denetimi ve piyasadan önce uygunluk değerlendirmeleri dahil olmak üzere katı gereksinimlere tabidir. Örnekler kritik altyapılar, tıbbi cihazlar, istihdam ve kolluk kuvvetlerinde AI'dır. Yüksek riskli AI için çoğu kural 2 Ağustos 2026'dan itibaren geçerlidir.

- Sınırlı risk: Chatbots veya derin makale üretenler gibi AI sistemleri şeffaflık yükümlülüklerini yerine getirmeli ve kullanıcılara AI ile etkileşime girdiklerini veya içeriğin AI oluşturulduğunu bildirmelidir.

- Minimal risk: Spam filtreleri veya AI tabanlı video oyunları gibi AI sistemleri. Yasa, gönüllü davranış becerileri teşvik edilmesine rağmen, ücretsiz kullanıma izin verir.

İçin uygun:

Yasa, AI sistemlerinin sağlayıcıları, ithalatçıları, tüccarları ve kullanıcıları (operatörleri) için yükümlülükleri belirler, böylece yüksek riskli sistem sağlayıcıları en katı gereksinimlere tabidir. Yürütme dışı başvuru nedeniyle, AI sistemleri AB pazarında kullanılırsa AB dışındaki şirketleri de etkiler. "Sistemik risk" olarak sınıflandırılanlar için ek yükümlülükleri olan genel amaçlı (GPAI modelleri) olan AI modelleri için belirli kurallar geçerlidir. Bu kurallar genellikle 2 Ağustos 2025'ten itibaren geçerlidir. Eğer uyumsuzluk ise, yasaklanmış başvurular için küresel yıllık cironun 35 milyon avro veya % 7'sine kadar önemli para cezaları vardır. Şubat 2025'ten itibaren, 4 Madde ayrıca, bazı AI sistemlerinin sağlayıcıları ve operatörleri personeli için yeterli düzeyde AI yeterliliği öngörmektedir.

AB AI Yasası'nın risk temelli yaklaşımı, şirketlerin AI'nın geliştirilmesi ve kullanımına yaklaşımında temel bir değişiklik gerektirir. Artık sadece teknik fizibilite veya iş değeri ile ilgili değil; Düzenleyici uyum ve risk azaltma, AI yaşam döngüsünün başlangıcından entegre edilmelidir ("Tasarımla Uyum"). "AI yetkinlik yükümlülüğü" önemli ve erken bir kararlılıktır. Bu, şirketlerin sadece teknik ekipler için değil, aynı zamanda AI sistemlerini geliştiren, kullanan veya izleyen herkes için eğitim programlarını değerlendirmeleri ve uygulaması gerektiği anlamına gelir. Bu temel farkındalığın ötesine geçer ve işlevsellik, sınırların, etik ve yasal çerçevenin anlaşılmasını içerir. Yasanın GPAI modellerine, özellikle sistemik bir riske sahip olanlara odaklanması, bu güçlü, çeşitli modellerin geniş ve potansiyel olarak öngörülemeyen etkileri hakkında düzenleyici bir endişeyi göstermektedir. Bu tür modelleri kullanan veya geliştiren şirketler, kalkınma planlarını ve piyasa tanıtım stratejilerini etkileyen yoğun bir inceleme ve yükümlülüklere tabidir.

AB KI Yasası'nın risk kategorilerine ve temel yükümlülüklere genel bakış

Bu tablo, AB KI Yasası'nın temel yapısını özetler ve yöneticilerin AI sistemlerinin hangi kategoriye düşebileceğini ve ilgili uyumluluk yükünü ve programlarını anlamalarını hızlı bir şekilde tanımalarına yardımcı olur.

AB KI Yasası'nın risk kategorilerine genel bir bakış, sosyal puanlama, bilişsel manipülasyon ve yüz görüntülerinin kazınması gibi kabul edilemez bir riske sahip sistemlerin tamamen yasaklandığını ve artık uygulanmayacağı, örneğin kritik, tıbbi, istihdam, eğitimin uygulanması, örneğin uygulanmayacağını göstermektedir. yükümlülükler. Diğer şeylerin yanı sıra, sağlayıcılar ve operatörler bir risk yönetim sistemi, veri kalitesi yönetimi ve teknik belgelere sahip olmalı, şeffaflık sağlamalı, insan denetimini sağlamalı ve sağlamlık, doğruluk, siber güvenlik ve uygunluk değerlendirmesi gibi kriterleri karşılamalıdır. Karşılık gelen önlemler Ağustos 2026'dan itibaren, kısmen Ağustos 2027'den itibaren yürürlüğe girer. Sınırlı risk, sohbet botları, duygu algılama sistemleri, biyometrik kategorizasyon sistemleri ve daha derin gibi AI uygulamaları ile ilgilidir. AI sistemi veya AI tarafından üretilen içerik olarak etiketleme gibi şeffaflık yükümlülükleri de Ağustos 2026'dan itibaren geçerli olduğu düşünülmektedir. SPAM filtreleri veya AI destekli video oyunları gibi asgari riskli AI uygulamaları için gönüllü davranışsal koodes önerilmektedir. Bu tür sistemler hemen kullanılabilir.

İnovasyon hesaplama yükümlülüğünün voltaj alanı: doğru dengeyi bulun

Şirketler, AI inovasyonunun tanıtımı ile hesap verebilirlik, veri koruma (GDPR) ve etik kullanım garantisi arasındaki gerilim alanında ustalaşmalıdır. GDPR ilkeleri (yasallık, adalet, şeffaflık, amaç bağlama, veri minimizasyonu, doğruluk, hesap verebilirlik) sorumlu AI için temeldir ve AI sistemlerinin nasıl geliştirildiğini ve kullanıldığını etkiler. Denge stratejileri, uyumluluk ve veri koruma ekiplerinin erken entegrasyonu, düzenli denetimler, dış uzmanlık kullanımı ve özel uyumluluk araçlarının kullanımı yer alır. Bazıları düzenleyici yönergeleri inovasyon frenleri olarak değil, güven oluşturan ve yeni teknolojilerin kabulünü artıran bir hızlandırıcı olarak görüyor.

"İnovasyon zorunlu yükümlülüğün gerginliği alanı" statik bir uzlaşma değil, dinamik bir denge. Hesap verebilirlik ve etik hususları AI inovasyon döngüsüne proaktif olarak yerleştiren şirketlerin sürdürülebilir, güvenilir AI çözümleri oluşturma olasılığı daha yüksektir. Bu, sonuçta maliyetli güçlendirme, itibar hasarı veya düzenleyici cezalardan kaçınarak büyük yenilikleri teşvik eder. Bir hesap verebilirliği sürdürmenin zorluğu, gelişmiş AI modellerinin (temel modellerde tartışıldığı gibi) artan karmaşıklığı ve potansiyel "kara kutu" doğası ile güçlendirilmiştir. Bu, AI tarafından alınan kararların gerektiğinde anlaşılabilmesini, haklı çıkarılabilmesini ve tartışılmasını sağlamak için açıklanabilirlik tekniklerine (XAI) ve sağlam denetim mekanizmalarına daha güçlü bir odaklanma gerektirir.

🎯📊 Bağımsız ve veriler arası bir kaynak çapında AI platformunun entegrasyonu 🤖🌐 Tüm şirket konuları için

Tüm şirket meseleleri için bağımsız ve veriler arası bir kaynak çapında bir AI platformunun entegrasyonu-imge: xpert.digital

Ki-Gamechanger: Maliyetleri azaltan, kararlarını artıran ve verimliliği artıran en esnek AI platformu-tailor yapımı çözümler

Bağımsız AI Platformu: Tüm ilgili şirket veri kaynaklarını entegre eder

- Bu AI platformu tüm belirli veri kaynaklarıyla etkileşime girer

- SAP, Microsoft, Jira, Confluence, Salesforce, Zoom, Dropbox ve diğer birçok veri yönetim sisteminden

- Hızlı AI Entegrasyonu: Şirketler için aylar yerine saatler veya günler içinde özel yapım AI çözümleri

- Esnek Altyapı: Bulut tabanlı veya kendi veri merkezinizde barındırma (Almanya, Avrupa, ücretsiz konum seçimi)

- En Yüksek Veri Güvenliği: Hukuk firmalarında kullanmak güvenli kanıttır

- Çok çeşitli şirket veri kaynaklarında kullanın

- Kendi veya çeşitli AI modellerinizin seçimi (DE, AB, ABD, CN)

AI platformumuzun çözdüğü zorluklar

- Geleneksel AI çözümlerinin doğruluğu eksikliği

- Hassas verilerin veri koruması ve güvenli yönetimi

- Bireysel AI gelişiminin yüksek maliyetleri ve karmaşıklığı

- Nitelikli AI eksikliği

- AI'nın mevcut BT sistemlerine entegrasyonu

Bununla ilgili daha fazla bilgiyi burada bulabilirsiniz:

Yöneticiler için AI Stratejileri: Pratik Yönergeler ve Örnekler

AI eylemde: uygulamalar, uygulamalar ve etkili etkileşim

Fırsatları Tanıyın: Endüstrilerdeki AI uygulamaları ve uygulamaları

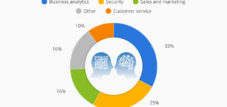

KI, içerik oluşturulması, kişiselleştirilmiş müşteri yaklaşımı, üretim ve lojistikte süreç optimizasyonu, ileriye dönük bakım ve finans, insan kaynakları ve BT'de destek dahil olmak üzere çok çeşitli uygulamalar sunar.

Belirli endüstri örnekleri şunları içerir:

- Otomobil/Üretim: Araştırmada AI ve Simülasyon (Arena2036), Otomatik Robot Etkileşimi (Festo), Üretimde Süreç Optimizasyonu ve Öngörücü Bakım (Bosch).

- Finansal Hizmetler: Şüpheli işlemler, otomatik fatura, yatırım analizi hakkında büyük miktarda veri analiz ederek artan güvenliğe.

- Sağlık hizmetleri: Daha hızlı tanılar, bakıma genişletilmiş erişim (örneğin tıbbi görüntülerin yorumlanması), farmasötik araştırmaların optimizasyonu.

- Telekomünikasyon: Ağ performansının optimizasyonu, görsel -işitsel iyileştirmeler, Müşteri Geçişinin Önlenmesi.

- Perakende/e-ticaret: kişiselleştirilmiş öneriler, müşteri hizmetleri için sohbet botları, otomatik kasiyer süreçleri.

- Pazarlama ve Satış: İçerik oluşturma (ChatGPT, Canva), optimize edilmiş kampanyalar, müşteri segmentasyonu, satış tahminleri.

Birçok uygulama otomasyon ve verimliliği hedeflerken, gelişmekte olan önemli bir eğilim, insan kararını iyileştirirken ve yeni inovasyon biçimlerini (örneğin ilaç geliştirme; ürün geliştirme) sağlarken AI'nın rolüdür. Yöneticiler, AI odaklı büyüme ve inovasyon seçeneklerini belirlemek için maliyet azaltmalarının ötesine bakmalıdır. En başarılı AI uygulamaları, AI'nın bağımsız, izole edilmiş bir teknoloji olarak muamele etmek yerine, AI'nın mevcut çekirdek süreçlere ve sistemlere entegrasyonunu (örneğin SAP, kurumsal yazılımlarda KI kullanır, Microsoft 365 Copilot) içerir. Bu, şirket mimarisinin bütünsel bir görünümünü gerektirir.

İçin uygun:

- Yapay Zeka: Sürdürülebilir Kurumsal Yönetim İçin Yapay Zeka Dönüşümü Başkanlığı için Beş Temel Strateji

Diyalogda Usta: Üretken AI için Etkili İsteme

Derhal mühendislik, net hedefler ve sistematik testler gerektiren model çıktısını geliştirmek için yinelemeli, test kontrollü bir işlemdir. Etkili istemler hem içeriğe (talimatlar, örnekler, bağlam) hem de yapıya (sipariş, etiketleme, ayırıcı) bağlıdır.

Bir istemin önemli bileşenleri şunlardır: hedef/görev, talimatlar, kısıtlamalar (ne yapmalı/yapmalı), ses/stil, bağlam/arka plan verileri, birkaç atış örnekleri, gerekçe isteği (zincir) ve istenen cevap biçimi.

En iyi uygulamalar şunları içerir:

- Net hedefler belirleyin ve eylem fiillerini kullanın.

- Bağlam ve arka plan bilgileri sağlayın.

- Hedef grubu tam olarak tanımlayın.

- Yapay zeka ne yapmaması gerektiğini söyler.

- Hızlı, özlü ve hassas kelime seçimi ile formüle edin.

- Özellikle yazma görevleri için çıktı sınırları ekleyin.

- Bir rol atayın (örneğin "Matematik öğretmenisiniz").

- Hızlı zincirleme (birbirine bağlı istem kullanımı) sürekli fikirler üretebilir.

Etkili yol, LLM'lerle etkileşim için stratejik bir yaklaşımın geliştirilmesinden daha az tek bir "mükemmel istemi" arayışıdır. Bu, model becerilerinin anlaşılması, çıktıya dayalı istemlerin yinelemeli olarak iyileştirilmesini ve AI'yı istenen sonuçlara yönlendirmek için rol tahsisi ve zincir gibi tekniklerin kullanımını içerir. Egzersiz ve eleştirel düşünme gerektiren bir yetenektir. İlgili bağlam sağlama ve kısıtlamaları tanımlama yeteneği, Genai'den değerli sonuçlar elde etmek için büyük önem taşımaktadır. Bu, AI tarafından üretilen içeriğin kalitesinin genellikle insan girdisinin kalitesi ve özgüllüğü ile doğru orantılı olduğu ve bu da süreçteki insan uzmanlığının kalıcı öneminin altını çizdiği anlamına gelir.

Etkili AI istemleri oluşturmak için en iyi uygulama

Bu tablo, yöneticilerin ve uzmanların üretken AI araçlarıyla etkileşimlerini artırmak için hemen uygulayabilecekleri pratik, uygulanabilir tavsiyeler sunar.

Üretken AI kullanımında değerli sonuçlar elde etmek için, hedefi kesin olarak tanımlamak ve "kağıdın en önemli sonuçlarını özetleyen bir kilit nokta listesi oluşturmak" gibi eylem fiillerini kullanmak özellikle ve net bir şekilde ele almak çok önemlidir. Örneğin "finansal rapora dayanarak, son beş yılın karlılığını analiz et" gibi arka plan bilgilerinin ve ilgili verilerin sunulması yoluyla bağlamı sağlamak da önemlidir. Hedef grup ve istenen ses, "sürdürülebilirliğe değer veren genç yetişkinler için bir ürün açıklaması yaz" gibi açıkça ifade edilmelidir. AI'ya belirli bir rol veya persona da verilebilir, örneğin "Bir pazarlama uzmanısınız. “Giriş: Apple. Çıktı: Meyve. Giriş: Carrow. Çıktı:” gibi birkaç atış örneği yardımıyla, istenen çıkış biçimi daha iyi gösterilebilir. Cevapların tam olarak biçimlendirilmesi, "Markdown'da cevabınızı nasıl biçimlendir" tanımlamak için de mantıklıdır. "Teknik jargondan kaçının. Cevap artık 200 kelimeden fazla olmamalı" gibi kısıtlamalar çıktıyı optimize etmeye yardımcı olur. Önceki sonuçlara göre adapte olduğu ve rafine edildiği yinelemeli yaklaşım, kaliteyi daha da artırır. Son olarak, zincir, AI'dan düşünme sürecini adım adım açıklamasını isteyerek (argümanınızı adım adım açıklayın ”gibi düşüncelerle (olsa da) kullanılabilir.

Görünmez AI ile mücadele: Gölge Uygulamalarını Anlayın ve Yönetin (Gölge AI)

Schadten-KI, genellikle üretkenliği artırmak veya yavaş resmi süreçlerden kaçınmak için çalışanlar tarafından AI araçlarının yetkisiz veya düzensiz kullanımını belirtir. Gölgenin bir alt kategorisidir.

Gölge Ki'nin riskleri:

- Veri Güvenliği ve Veri Koruma: Yetkisiz araçlar, veri koruma ihlallerine, hassas genel/şirkete ait verilerin açıklanmasına ve GDPR/HIPAA ile uyumlu olmamasına yol açabilir.

- Uyum ve Hukuk: Veri Koruma Yasalarının İhlalleri, Telif Hakkı Sorunları, Bilgi Özgürlüğü ile Çatışma. Şubat 2025'ten itibaren AB Ki Yasası'nın "AI yetkinliği" nin talebi argümanı acilen yapıyor.

- Ekonomik/operasyonel: verimsiz paralel yapılar, bireysel abonelikler yoluyla gizli maliyetler, lisanslar üzerinde kontrol eksikliği, mevcut sistemlerle uyumsuzluk, iş süreçlerinin bozulması, verimlilik azalması.

- Kalite ve Kontrol: Veri işlemede şeffaflık eksikliği, önyargılı veya yanıltıcı sonuçlar, kamu/iç güven erozyonu.

- Yönetişimin zayıflatılması: Güvenlik yönergelerinin uygulanmasını zorlaştıran BT hükümetinin atlanması.

Schadten-KI yönetimi için stratejiler:

- Açık bir AI stratejisinin geliştirilmesi ve sorumlu bir AI kılavuzunun oluşturulması.

- Resmi, onaylanmış AI araçlarının alternatif olarak sağlanması.

- Yapay zeka kullanımı, veri işleme ve onaylı araçlar için açık yönergelerin tanımı.

- Sorumlu AI kullanımı, riskler ve en iyi uygulamalar için çalışanların eğitimi ve duyarlılığı.

- Yetkili olmayan yapay zekayı ortaya çıkarmak ve uyum sağlamak için düzenli denetimlerin uygulanması.

- Küçük adımlarla başlayarak ve yönergelerin iyileştirilmesinden başlayarak artımlı bir AI hükümeti yaklaşımının kabulü.

- Çapraz bölümlü işbirliğinin ve çalışanların katılımının teşviki.

Schadten-KI genellikle yerine getirilmemiş kullanıcı ihtiyaçları veya teknolojinin tanıtımında aşırı bürokratik süreçler için bir belirtisidir. Tamamen kısıtlayıcı bir yaklaşım ("yasak AI") geri tepebilir. Etkili yönetim, net yönetişimin yanı sıra nedenlerin anlaşılmasını ve pratik, güvenli alternatifler sağlamayı gerektirir. Kolay erişilebilir Genai araçlarının (ChatGPT gibi) yükselişi muhtemelen Schatten-KI'nin yayılmasını hızlandırdı. Çalışanlar bu araçları BT katılımı olmadan hızlı bir şekilde kullanabilirler. Bu, proaktif AI yeterlilik eğitimini (AB KI Yasası'nın gerektirdiği gibi) ve onaylanmış araçlarla net iletişimi daha da önemli hale getirir.

Gölge AI riskleri ve stratejik tepkiler

Bu tablo, düzenlenmemiş AI kullanımından ve yöneticiler için uygulanabilir stratejilerden gelen çeşitli tehditlere yapılan yapılandırılmış bir genel bakış sunmaktadır.

Gölge AI, şirketlerin stratejik olarak karşılaşması gereken çok sayıda risk taşır. Veri güvenliği alanında veri sızıntıları, hassas bilgilere yetkisiz erişim veya kötü amaçlı yazılım enfeksiyonları ortaya çıkabilir. Stratejik önlemler arasında bir AI kullanım kılavuzunun tanıtılması, onaylanmış araçların bir listesinin oluşturulması, şifreleme kullanımı, katı erişim kontrollerinin uygulanması ve çalışanların eğitimi yer almaktadır. GDPR ihlalleri, endüstri düzenlemelerinin ihlalleri veya telif hakkı ihlali, düzenli denetimler, yeni araçlar için veri tabanlı veri koruma dizileri (DSFA), veri işleme için açıkça tanımlanmış yönergeler ve gerekirse yasal tavsiye önemlidir. Finansal riskler, abonelikler, gereksiz lisanslar veya verimsizlikler için kontrolsüz giderlerden kaynaklanmaktadır. Bu nedenle, şirketler merkezi tedarik, katı bütçe kontrolü ve araç kullanımının düzenli olarak gözden geçirilmesine güvenmelidir. Tutarsız sonuçlar, mevcut şirket sistemleriyle uyumsuzluk veya süreç bozuklukları gibi operatif zorluklar, standartlaştırılmış araçlar, mevcut iş akışlarına entegrasyonu ve sürekli kalite kontrolleri sağlayarak hakim olabilir. Son olarak, itibar riskleri bir tehlikedir, örneğin veri dökümleri veya yanlış yapay zeka oluşturulan iletişim sonucunda müşteri güveninin kaybı. Şeffaf iletişim, etik kılavuzlara uyum ve iyi düşünülmüş bir olay müdahale planı, şirkete olan güveni korumak ve olası hasarı en aza indirmek için çok önemli önlemlerdir.

🎯🎯🎯 Kapsamlı bir hizmet paketinde Xpert.Digital'in kapsamlı, beş katlı uzmanlığından yararlanın | Ar-Ge, XR, Halkla İlişkiler ve SEM

Yapay Zeka ve XR 3D İşleme Makinesi: Xpert.Digital'in kapsamlı bir hizmet paketi, AR-GE XR, PR ve SEM ile beş kat uzmanlığı - Resim: Xpert.Digital

Xpert.Digital, çeşitli endüstriler hakkında derinlemesine bilgiye sahiptir. Bu, spesifik pazar segmentinizin gereksinimlerine ve zorluklarına tam olarak uyarlanmış, kişiye özel stratejiler geliştirmemize olanak tanır. Pazar trendlerini sürekli analiz ederek ve sektördeki gelişmeleri takip ederek öngörüyle hareket edebilir ve yenilikçi çözümler sunabiliriz. Deneyim ve bilginin birleşimi sayesinde katma değer üretiyor ve müşterilerimize belirleyici bir rekabet avantajı sağlıyoruz.

Bununla ilgili daha fazla bilgiyi burada bulabilirsiniz:

Liderlik ve işbirliği nasıl dönüştürülebilir ve liderlikte yumuşak becerileri nasıl güçlendirir: AI çağındaki insan avantajı

Liderlik ve İşbirliği Nasıl Dönüştürülür ve Liderlikte Yumuşak Becerileri Kuvvetlendirme: AI yaş görüntüsünde insan avantajı: Xpert.digital

İnsan unsuru: yapay zekanın liderlik, işbirliği ve yaratıcılık üzerindeki etkileri

Yapay Zeka Çağında Liderlik Değiştirme: Yeni Gereksinimler ve Yetkinlikler

AI, liderlikte benzersiz insan becerilerine geçmeyi gerektirir: farkındalık, şefkat, bilgelik, empati, sosyal anlayış, şeffaf iletişim, eleştirel düşünme ve uyarlanabilirlik. Yöneticiler, AI araçları hakkında iyi kurulmuş kararlar almak ve değişim yoluyla liderlik etmek için teknolojik yetkinlik geliştirmek zorundadır. Bu, verilerin anlaşılmasını ve AI tarafından oluşturulan bilgilerin eleştirel değerlendirmesini içerir.

En önemli yönetim görevleri, veri kontrollü karar verme kültürünün teşvik edilmesi, etkili değişim yönetimi, AI hükümeti aracılığıyla etik düşüncelerle uğraşmak ve inovasyon ve yaratıcılığı teşvik etmek yer alıyor. AI, motivasyon ve çalışan gelişimi gibi stratejik ve insan yönlerine odaklanabilmeleri için rutin görevlerin yöneticilerini rahatlatabilir. Teknik uzmanlığı, davranış bilgisini ve stratejik vizyonu birleştiren bir "Baş İnovasyon ve Dönüşüm Görevlisi" (CITO) (CITO) ortaya çıkabilir. Yöneticiler karmaşık etik manzaralarda gezinmeli, kültürel dönüşümleri teşvik etmeli, insanlar ve yapay zekalar arasındaki işbirliğini yönetmeli, çapraz fonksiyonel entegrasyona yönelmeli ve sorumlu yeniliği sağlamalıdır.

Yapay zeka çağındaki yöneticiler için temel zorluk sadece AI'yi anlamak değil, aynı zamanda insan tepkisini AI'ya yönlendirmektir. Bu, bir öğrenme kültürünün yetiştirilmesini, iş kaybından önce korkularla uğraşmasını ve etik yapay zeka kullanımının ortaya çıkmasını içerir, bu da yumuşak becerileri her zamankinden daha önemli hale getirir. Yapay zeka çağında kişilerarası ilişkilerin algılanmasında potansiyel bir tutarsızlık vardır: çalışanların % 82'si, yöneticilerin sadece % 65'ine kıyasla bunları gerekli görmektedir. Bu boşluk, insan bağlantılarına çok az yatırım yapan ve potansiyel olarak ahlak ve işbirliğini bozan liderlik stratejilerine yol açabilir. Etkili AI rehberliği paradoksal bir yetenek seti içerir: öznel insan yargısı, sezgi ve etik argümanı güçlendirirken AI tarafından veri kontrollü nesnelliğin kabulü. Yapay zeka yapmamak, insan zekasını genişletmekle ilgilidir.

İçin uygun:

- Yapay zeka, genişletilmiş ve artırılmış gerçeklik gibi yeni teknolojilerin kabulü ve bunun nasıl teşvik edilebileceği

Takım çalışmasının dönüşümü: AI'nın işbirliği ve ekip dinamikleri üzerindeki etkisi

AI, rutin görevleri otomatikleştirerek ekip çalışmasını geliştirebilir ve çalışanların stratejik ve yaratıcı çalışmaya odaklanmalarını sağlar. AI sistemleri verileri analiz ederek ve ekipler vererek daha iyi karar vermeyi destekleyebilir. AI araçları daha iyi iletişim ve koordinasyonu teşvik edebilir, gerçek zamanlı işbirliğini ve bilgi ve kaynak alışverişini sağlayabilir. Yapay zeka tabanlı bilgi yönetimi merkezi bilgiye erişimi kolaylaştırabilir, akıllı aramalar sağlayabilir ve bilgi alışverişini teşvik edebilir. İnsan yaratıcı becerileri, yargı ve duygusal zekanın yapay zekanın veri analizi ve otomasyon becerileri ile birleşimi daha verimli ve iyi kurulmuş çalışmalara yol açabilir.

Zorluklar arasında, işbirlikçi AI araçlarında veri koruma ve etik veri işleme garantisi, AI'nın daha fazla yeterlilik için bir strateji olmadan çok fazla görev üstlenmesi ve kişisel temasların daha az yaygın olabileceği korkusu varsa, çalışanlar arasında "yetkinlik kaybı" potansiyeli yer almaktadır.

Yapay zeka işbirliğinin verimliliğini artırabilirken (örneğin daha hızlı bilgi alımı, görev otomasyonu), yöneticiler insan etkileşimi ve takım uyumunun kalitesini korumak için aktif olarak çalışmalıdır. Bu, iş süreçlerini AI ekibi üyelerinin izole yerine destekleyecek ve gerçek insan bağlantıları için fırsatlar yaratacak şekilde tasarlamak anlamına gelir. Yapay zekanın ekip çalışmasına başarılı bir şekilde entegrasyonu, teknolojinin güvenilirliğine ve adaletine güven güvenliğine ve ekip üyeleri arasında AI tabanlı bilginin nasıl kullanıldığına güvenmektedir. Güven eksikliği direnişe yol açabilir ve işbirlikçi çabalardan geçebilir.

Yaratıcı bir ortak olarak AI: Kuruluşlarda Yaratıcılığın Genişletilmesi ve Yeniden Tanımlanması

Üretken AI, stratejik ve dikkatli bir şekilde tanıtılırsa, insan yaratıcılığının ve AI'nın birlikte bulunduğu ve birlikte çalıştığı bir ortam yaratabilir. AI, ortak olarak hareket ederek, yeni bakış açıları sunarak ve medya, sanat ve müzik gibi alanlarda olası sınırları değiştirerek yaratıcılığı teşvik edebilir. AI, yaratıcı süreçlerin rutin paylarını otomatikleştirebilir ve böylece daha kavramsal ve yenilikçi çalışmalar için insanları serbest bırakabilir. Ayrıca yapay zeka tabanlı deneyler yoluyla yeni eğilimleri tanımaya veya ürün geliştirmeyi hızlandırmaya yardımcı olabilir.

Etik ikilem ve zorluklar, geleneksel yazarlık, özgünlük, özerklik ve niyet fikirlerini sorgulayan yapay zeka tarafından üretilen içeriğin ortaya çıkmasından kaynaklanmaktadır. AI modellerinin eğitimi ve potansiyel olarak yasal içeriğin üretilmesi için telif hakkı korumalı verilerin kullanılması önemli endişelerdir. Buna ek olarak, uzun vadede bağımsız insan yaratıcı keşif ve yetkinlik gelişimini potansiyel olarak bastırabilecek AI'ya aşırı bağımlılık riski vardır.

Yapay zekanın yaratıcı süreçlere entegrasyonu sadece yeni araçlar sorunu değil, aynı zamanda yaratıcılığın kendisinin temel bir yeniden tanımlanmasıdır. Bu, AI ile yeni bir yöntem olarak çalışmayı vurgulayan yaratıcı profesyoneller ve yöneticileri için zihniyette bir değişiklik gerektirir. Yapay zeka tarafından oluşturulan içerikle (yazarlık, önyargı, derin dişler) ilgili etik hususlar, kuruluşların sağlam etik yönergeler ve denetim olmadan yaratıcı AI araçlarını devralamayacakları anlamına gelir. Yöneticiler, AI'nın aldatma veya ihlal için değil, yaratıcılığı genişletmek için sorumlu bir şekilde kullanılmasını sağlamalıdır.

Sipariş Oluştur: Sorumlu bir dönüşüm için AI hükümetinin uygulanması

AI Hükümetine İhtiyaç: Şirketi için neden önemlidir?

AI hükümeti, AI sistemlerinin etik, şeffaf ve insan değerlerine ve yasal gereksinimlere uygun olarak geliştirilmesini ve kullanılmasını sağlar.

AI hükümetinin önemli nedenleri:

- Etik düşünceler: Önyargılı kararlar ve haksız sonuçlar potansiyelini ele alır, adalet ve insan haklarına saygı gösterir.

- Yasal ve Düzenleyici Uyum: Yapay zekaya özgü yasaların (AB KI Yasası gibi) ve mevcut Veri Koruma Düzenlemeleri (GDPR) geliştirilmesine uyum sağlar.

- Risk Yönetimi: Müşteri güven kaybı, yetkinlik kaybı veya önyargılı karar verme süreçleri gibi yapay zeka ile ilgili riskleri tanımlamak, değerlendirmek ve kontrol etmek için bir çerçeve sunmaktadır.

- Gözetim: AI kararları durumunda şeffaflığı ve açıklığı teşvik eder ve çalışanlar, müşteriler ve paydaşlar arasında güven yaratır.

- Değerin Maksimizasyonu: AI kullanımının iş hedeflerine yönelik olduğundan ve avantajlarının etkili bir şekilde uygulandığından emin olun.

Makul yönetişim olmadan, AI kasıtsız hasara, etik ihlallere, yasal cezalara ve itibar hasarına yol açabilir.

AI hükümeti sadece bir uyum veya risk azaltma fonksiyonu değil, stratejik bir öncüdür. Kuruluşlar, açık kuralları, sorumlulukları ve etik yönergeleri belirleyerek, AI yeniliklerinin sorumlu bir şekilde gelişebileceği bir ortamı teşvik edebilir, bu da daha sürdürülebilir ve daha güvenilir AI çözümlerine yol açar. AI hükümetine duyulan ihtiyaç, AI sistemlerinin artan özerkliği ve karmaşıklığı ile doğru orantılıdır. Basit AI asistanlarından kuruluşlar daha sofistike AI ajanlarına ve temel modellere geçerse, muhasebe yükümlülüğü, şeffaflık ve kontrol açısından yeni zorluklarla başa çıkmak için yönetişimin kapsamı ve katı olma da daha da geliştirilmelidir.

Etkili AI hükümeti için çerçeve işleri ve en iyi uygulamalar

Yönetişim yaklaşımları gayri resmi (kurumsal değerlere dayalı) geçici çözümlere (belirli sorunlara tepki) ve resmi (kapsamlı çerçeve çalışmaları) arasında değişmektedir.

Önde gelen çerçeve çalışmaları (örnekler):

- NIST AI Risk Yönetimi Çerçevesi (AI RMF): Vergiler, haritalama, ölçme ve yönetme gibi işlevler yoluyla AI ile ilgili riskleri kontrol etmede kuruluşları desteklemeye odaklanmaktadır.

- ISO 42001: Kılavuz, risk yönetimi ve sürekli iyileştirme gerektiren kapsamlı bir AI yönetim sistemi oluşturur.

- OECD AI İlkeleri: Yapay zekanın sorumlu bir işlenmesini teşvik edin ve insan haklarını, adaletini, şeffaflığı ve hesap verebilirliği vurgulayın.

Uygulama için en iyi uygulama:

- Açık roller ve sorumluluklarla iç yönetişim yapıları (örneğin AI etiği, çapraz fonksiyonel çalışma grupları) oluşturmak.

- Yapay zeka uygulamaları için risk temelli bir sınıflandırma sisteminin uygulanması.

- Veri kalitesi, veri koruma ve bozulmalar için gözden geçirme dahil olmak üzere sağlam veri hükümetinin ve yönetiminin sağlanması.

- İlgili standartlara ve düzenlemelere dayalı uyum ve uygunluk incelemelerinin uygulanması.

- Özellikle yüksek riskli sistemler ve kritik kararlar için insan denetiminin reçete yazın.

- Şeffaf iletişim yoluyla paydaşların (çalışanlar, kullanıcılar, yatırımcılar) entegrasyonu.

- Açık etik kılavuzların geliştirilmesi ve bunların AI geliştirme döngüsüne entegrasyonu.

- Yönetişim yönergelerinin anlaşılmasını ve kabul edilmesini sağlamak için eğitim kurslarına ve değişim yönetimine yatırım.

- Açıkça tanımlanmış uygulamalar ve pilot projelerle başlayın, ardından kademeli olarak ölçeklendirin.

- Şirkette kullanılan AI sistemlerinin bir dizininin yönetimi.

Etkili AI hükümeti bir birim çözümü değildir. Kuruluşlar, NIST AI RMF veya ISO 42001 gibi çerçeve işlerini belirli endüstrilerine, boyutlarına, risk riskine ve kullandıkları AI türlerine uyarlamalıdır. Pratik adaptasyon olmadan bir çerçevenin tamamen teorik olarak ele geçirilmesi muhtemelen etkili değildir. Yapay zeka hükümetindeki "insan faktörü", "süreç" ve "teknoloji" yönleri kadar çok önemlidir. Bu, açık hesap verebilirlik atanması, kapsamlı eğitim ve etik ve sorumlu AI kullanımını takdir eden bir kültürün tanıtımını içerir. Çalışanların kabulü ve anlayışı olmadan, en iyi tasarlanmış yönetişim çerçevesi bile başarısız olacaktır.

AI Hükümeti çerçevesinin temel bileşenleri

Bu tablo, AI hükümetlerini kurmak veya geliştirmek isteyen yöneticiler için kapsamlı bir kontrol listesi ve talimatlar sunar.

AI hükümeti çerçevesinin temel bileşenleri, AI'nın sorumlu ve etkili kullanımını sağlamak için çok önemlidir. Merkezi ilkeler ve etik yönergeler kurumsal değerler üzerinde düşünmeli ve kendilerini insan hakları, adalet ve şeffaflığa yönlendirmelidir. Roller ve sorumluluklar açıkça tanımlanmalıdır; Bu, bir yapay zeka etiği konseyi, veri yöneticileri ve model denetçileri içerir, burada görevler, karar verme yetkileri ve hesaplama yükümlülüğü açıkça belirlenmelidir. Etkili risk yönetimi, AB KI hukuk kategorileri temelinde tanımlananlar gibi risklerin tanımlanmasını, değerlendirilmesini ve azaltılmasını gerektirir. Düzenli risk değerlendirmeleri ve azaltma stratejilerinin geliştirilmesi ve izlenmesi burada merkezi bir rol oynamaktadır. Veri yönetişimi, GDPR'ye uygunluk ve ayrımcılığa karşı önlemler de dahil olmak üzere kalite, veri koruma, güvenlik ve önyargı tanıma gibi yönlerin dikkate alınmasını sağlar. Model Yaşam Döngüsü Yönetimi, geliştirme, doğrulama, kullanım, izleme ve devreye alma için standartlaştırılmış süreçleri içerir ve dokümantasyon, sürümleme ve sürekli performans izlemeye özel vurgu yapar. AI kararlarının izlenebilirliğini sağlamak ve AI kullanımını ifşa etmek için şeffaflık ve açıklanabilirlik esastır. AB KI Yasası ve GDPR gibi yasal gereksinimlere uyum, devam eden incelemeler ve süreç düzenlemeleri ve Hukuk Departmanı ile işbirliği ile de sağlanmalıdır. Geliştiriciler, kullanıcılar ve yöneticiler için bilincin eğitimi ve keskinleştirilmesi AI temelleri, etik yönler ve yönetişim yönergelerinin anlaşılmasını teşvik eder. Son olarak, arızaları, etik ihlalleri veya güvenlik olaylarını etkili bir şekilde ele almak için olay reaksiyonu ve iyileştirme garanti edilmelidir. Bu, yerleşik raporlama yollarını, yükseltme süreçlerini ve hızlı ve hedefli müdahaleyi mümkün kılan düzeltici önlemleri içerir.

İçin uygun:

Önderlik Alın: AI dönüşümü için stratejik zorunluluk

Yapay zeka hazırlığını geliştirin: sürekli öğrenmenin ve daha fazla yeterliliğin rolü

Uzman bilgiye ek olarak, yöneticiler şirketlerini etkin bir şekilde ilerletmek için AI hakkında stratejik bir anlayışa ihtiyaç duyarlar. Yöneticiler için AI eğitimi AI tabanlarını, başarılı vaka çalışmaları, veri yönetimi, etik hususlar ve kendi şirketlerinde AI potansiyelinin tanımlanmasını kapsamalıdır. 2 Şubat 2025'ten itibaren AB KI Yasası (Madde 4), AI sistemlerinin geliştirilmesinde veya kullanımında yer alan personel için bir “AI yeterliliği” öngörmektedir. Bu, AI teknolojilerinin anlaşılmasını, uygulama bilgisini, eleştirel düşünmeyi ve yasal çerçeve koşullarını içerir.

Yöneticiler için AI eğitiminin avantajları arasında AI projelerini yönetme, sürdürülebilir AI stratejileri geliştirme, süreçleri optimize etme, rekabet avantajları güvence altına alma ve etik ve sorumlu AI kullanımını sağlama yeteneği yer alır. Yapay zeka yeterliliği ve becerilerin eksikliği, AI uyarlaması için önemli bir engeldir. Çeşitli eğitim formatları mevcuttur: sertifika kursları, seminerler, çevrimiçi kurslar, varlık eğitimi.

Yapay zeka hazırlık sadece teknik becerilerin edinilmesi değil, aynı zamanda tüm kuruluşta sürekli öğrenme ve uyarlanabilirlik düşünme biçiminin teşvik edilmesi anlamına gelir. Yapay zekanın hızlı gelişimi göz önüne alındığında, özel alet tabanlı eğitim güncel olabilir. Bu nedenle, eleştirel düşünme için temel yapay zeka bilgi ve becerileri daha kalıcı yatırımlardır. AB KI Yasası'ndan "AI yetkinlik yükümlülüğü" daha fazla yeterlilik için düzenleyici bir itici güçtür, ancak kuruluşlar bunu sadece bir uyum yükü olarak değil, bir fırsat olarak görmelidir. Daha fazla yetkin bir iş gücü, yenilikçi AI uygulamalarını tanımlamak, araçları etkili bir şekilde kullanmak ve genel olarak daha iyi AI sonuçlarına yol açan etik sonuçları anlamak için daha donanımlıdır. AI becerilerinin/anlayışının eksikliği ile gölge AI'nın yayılması arasında açık bir bağlantı vardır. Kapsamlı AI oluşumuna yapılan yatırımlar, çalışanların bilinçli ve sorumlu kararlar almalarını sağlayarak yetkisiz AI kullanımı ile ilişkili riskleri doğrudan azaltabilir.

Şans ve riskler sentezlenir: Egemen AI liderliği için bir yol haritası

AI dönüşümünün yönetimi, teknoloji potansiyelinin (inovasyon, verimlilik, kalite) ve doğal risklerinin (etik, yasal, sosyal olarak) bütünsel bir şekilde anlaşılmasını gerektirir.

Organizasyonun AI gezilerinin proaktif tasarımı, egemen AI liderliğini içerir:

- AB KI Yasası gibi etik ilkelere ve yasal çerçeveye dayalı sağlam bir AI hükümetinin kurulması.

- Her düzeyde sürekli öğrenme ve AI yeterliliği kültürünün teşvik edilmesi.

- Somut bir değer sağlayan AI uygulamalarının stratejik olarak tanımlanması ve önceliklendirilmesi.

- Yapay zekanın insan etkilerini değiştirmek ve yönetim yerine tamamlanan becerilere odaklanarak insan yeteneklerini güçlendirmek.

- Schatten-KI gibi proaktif yönetim zorlukları.

Nihai hedef, AI'yi sürdürülebilir büyüme ve rekabet avantajları için stratejik bir öncü olarak kullanmak ve aynı zamanda potansiyel dezavantajlarını azaltmaktır. Gerçek "egemen AI liderliği" iç organizasyon yönetiminin ötesine geçer ve AI'nın sosyal etkileri ve şirketin bu ekosistemdeki rolü hakkında daha geniş bir anlayış içerir. Bu, siyasi tartışmalara katılmak, etik standartların belirlenmesine katkıda bulunmak ve yapay zekanın sadece kâr için değil, sosyal kuyu için kullanılmasını sağlamak anlamına gelir. AI dönüşümünün yolculuğu doğrusal değildir ve belirsizlikler ve beklenmedik zorluklar yoluyla navigasyon içerecektir. Bu nedenle yöneticiler, ekiplerinin öngörülemeyen teknolojik ilerlemelere, düzenleyici değişikliklere veya pazarla ilgili bozukluklara AI tarafından adapte olabilmeleri için örgütsel çeviklik ve esneklik geliştirmelidir.

İçin uygun:

- Danışmanlık ve planlama için ilk on – Yapay Zekaya Genel Bakış ve İpuçları: Çeşitli yapay zeka modelleri ve tipik uygulama alanları

Teknolojileri anlama ve kullanma: karar vericiler için AI tabanları

Yapay zeka yoluyla dönüşüm artık geleceğin uzak bir vizyonu değil, her boyutta ve endüstriden şirketlere meydan okuyan ve aynı zamanda muazzam fırsatlar sunan güncel bir gerçekliktir. Uzmanlar ve yöneticiler için bu, AI'nın potansiyelini sorumlu bir şekilde kaldırmak ve ilişkili riskleri güvenle yönetmek için bu değişikliğin tasarımında aktif bir rol oynamak anlamına gelir.

Yapay zekanın temelleri, üretken modellerden asistanlar ve ajanlar arasındaki ayrıma, makine öğrenimi ve temel modeller gibi teknolojik sürücülere kadar, daha derin bir anlayışın temelini oluşturur. Bu bilgi, AI sistemlerinin kullanımı ve entegrasyonu hakkında iyi kurulmuş kararlar alabilmek için gereklidir.

Yasal çerçeve, özellikle AB KI Yasası, AI'nın geliştirilmesi ve uygulanması için açık yönergeler belirlemektedir. Riske dayalı yaklaşım ve sonuçta ortaya çıkan yükümlülükler, özellikle yüksek riskli sistemler ve çalışanların gerekli AI yeterliliği ile ilgili olarak, proaktif bir tartışma ve sağlam yönetişim yapılarının uygulanmasını gerektirir. İnovasyon arayışı ile hesap verebilirlik ihtiyacı arasındaki gerilim alanı, uyum ve etiği inovasyon sürecinin ayrılmaz bir parçası olarak gören entegre bir strateji ile çözülmelidir.

Yapay zekanın olası kullanımları çeşitlidir ve endüstriler arasındadır. Uygun kullanım durumlarının tanımlanması, isteme ve gölge uygulamalarının bilinçli kullanımı gibi etkili etkileşim tekniklerinin kontrolü, kendi sorumluluk alanınızda AI'nın katma değerini uygulamak için kilit yeterliliklerdir.

Son olarak, AI, yönlendirildiği gibi, birlikte çalıştığı gibi sürdürülebilir bir şekilde değişir ve yaratıcılık yaşanır. Yöneticilerin, empati, eleştirel düşünme ve değişim yönetimi gibi insan becerilerine daha fazla odaklanmak ve insanların ve makinenin sinerjik olarak çalıştığı bir kültür yaratmak için becerilerini uyarlamaları gerekmektedir. İşbirliğinin teşvik edilmesi ve AI'nın yaratıcı bir ortak olarak entegrasyonu, yeni düşünme ve yönetim yolları gerektirir.

Kapsamlı bir AI hükümeti kurmak isteğe bağlı bir aksesuar değil, stratejik bir zorunluluktur. Yapay zekanın etik, şeffaf ve güvenli kullanımı için çerçeveyi yaratır, riskleri en aza indirir ve tüm paydaşlara güven oluşturur.

Yapay zeka dönüşümü, sürekli öğrenme, uyarlanabilirlik ve net bir vizyon gerektiren bir yolculuktur. Bu zorluklarla karşılaşan ve burada özetlenen ilkeleri ve uygulamaları içselleştiren uzmanlar ve yöneticiler, örgütlerinin, alanlarının ve ekiplerinin geleceğini ve yapay zeka çağında güvenle tasarlamak için iyi donanımlıdır.