Publicerad: 13 juni 2025 / UPDATE Från: 13 juni 2025 - Författare: Konrad Wolfenstein

För robotar och andra AI-agenter: AI-modellen V-JEPA 2 i Meta-AI som förstår vår fysiska världsbild: Xpert.Digital

Meta presenterar V-JEPA 2: AI-systemet lär sig förutsägelser om den fysiska världen

Meta publicerar V-JEPA 2: En revolutionär AI World Model för framtiden för konstgjord intelligens

Med V-JEPA 2 har Meta presenterat ett banbrytande AI-system som bedriver en grundläggande strategi än konventionella stora röstmodeller. Den 1,2 miljarder parametern Strong World -modellen utvecklades för att hjälpa robotar och andra AI -agenter att förstå den fysiska världen och för att förutsäga hur den kommer att reagera på dess handlingar.

Vad är V-JEPA 2 och hur skiljer det sig från röstmodeller?

V-JEPA 2 står för ”Video Joint Embedding Predictive Architecture 2” och är baserad på en helt annan arkitektur än traditionella röstmodeller. Medan röstmodeller som Chatgpt eller GPT-4 gör sannolikhetsförutsägelser om textsekvenser, fungerar V-JEPA 2 i ett abstrakt representationsrum och fokuserar på att förstå fysiska lagar.

Den avgörande skillnaden är i inlärningsmetoden: språkmodeller kräver stora mängder märkta data och lärande genom övervakad utbildning. V-JEPA 2, å andra sidan, använder självövervakad lärande och extrahering av kunskap från ovända videor, vilket avsevärt minskar kostnaderna för dataförberedelser. Modellen lär sig inte genom pixelrekonstruktion, utan genom abstrakta representationer av videoinnehållet.

JEPA -arkitekturen: Lärande efter förutsägelse

Den gemensamma inbäddade prediktiva arkitekturen (JEPA) utvecklades av Yann Lecun, Metas Chief AI -forskare och representerar ett alternativ till generativa AI -modeller. I motsats till generativa tillvägagångssätt som försöker rekonstruera alla saknade pixlar, fungerar V-Jepa 2 med maskerade videokor och lär sig att förutsäga abstrakta begrepp.

Systemet använder en tvåstegsutbildningsstrategi:

Första fasen: Självmoniterad lärande

- Träning med över en miljon timmars videomaterial och en miljon bilder

- Lär dig fysiska interaktionsmönster utan mänsklig kommentar

- Utveckling av en intern modell av den fysiska världen

Andra fas: Action -relaterad anpassning

- Finjustering med bara 62 timmars robotkontrolldata från Droid -datauppsättningen

- Integration av agentåtgärder i de prediktiva färdigheterna

- Aktivera planering och stängd kontrollkretsstyrning

Överlägsen prestanda i praktiken

V-JEPA 2 visar imponerande prestanda inom olika områden:

Videoförståelse och rörelseupptäckt

- 77,3% Topp 1 noggrannhet i något något V2 -datauppsättning

- 39,7% återkallande-AT-5 för Epic-Kitchens-100-åtgärdsprognos (44% förbättring jämfört med tidigare modeller)

- Modernaste prestanda i olika videokretsuppgifter

Robotkontroll

- 65-80% framgångsgrad för pick-and-place-uppgifter i okända miljöer

- Nollskottsrobotkontroll utan omgivningsspecifik träning

- Använd i två olika laboratorier med Franka Robot Arms

Effektivitet jämfört med tävlingen

V-JEPA 2 är 30 gånger snabbare än Nvidias Cosmos-modell och behöver bara 16 sekunder för att planera en robotåtgärd, medan Cosmos behöver 4 minuter.

Tekniska innovationer och viktiga egenskaper

Modellen kännetecknas av fem centrala tekniska genombrott:

- Självmoniterat lärande: Eliminerar behovet av stora mängder märkta data

- Maskeringsmekanism: Tränar modellen genom att förutsäga dolda videoområden

- Abstract Representative Learning: Fokusera på semantiska betydelser istället för pixelinformation

- Världsmodellarkitektur: Upprättande av en intern förståelse av fysiska lagar

- Effektivt överföringsinlärning: Enastående inlärningsförmåga

Nya riktmärken uppenbara gränser för nuvarande AI

Meta har släppt tre nya riktmärken parallellt med V-JEPA 2 som testar den fysiska förståelsen för AI-system:

Intphys 2

Testar förmågan att skilja mellan fysiskt rimliga och omöjliga scenarier. Även avancerade modeller är fortfarande nära slumpmässig nivå här.

Mvpbench

Visuellt använder liknande videobilar med motsatta svar på samma fråga. V-JEPA 2 når 44,5% parad noggrannhet-bästa prestanda för alla testade system.

Kausalvqa

Undersöker kausal förståelse och mot -aktivt tänkande. Resultaten visar att nuvarande AI -system väl kan beskriva vad de ser men har svårt att förutsäga alternativa kurser.

AI utan hunger efter data: Hur V-JEPA 2 maskininlärning gör effektivare

Yann Lecun ser nyckeln till nästa generation av AI-utveckling i världsmodeller som V-JEPA 2. Modellen kan revolutionera olika tillämpningsområden:

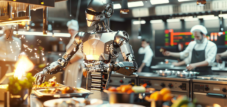

Robotik och budgetassistenter

Världsmodeller är tänkt att inleda en ny era av robotik där AI -agenter kan hantera verkliga uppgifter utan astronomiska mängder träningsdata.

Autonoma fordon

Den rumsliga förståelsen av realtid från V-JEPA 2 kan vara avgörande för autonoma fordon, lagerrobotar och drone-leveranssystem.

Utökad verklighet (AR) och virtuella assistenter

Meta planerar att utöka funktionerna i V-JEPA 2 genom att integrera ljudanalys och utvidgad videomelett för AR-glasögon och virtuella assistenter.

Open Source -tillgänglighet och forskningsfrämjande

Meta har släppt V-JEPA 2 under CC-BY-NC-licensen som en öppen källkod för att främja global AI-forskning. Modellkoden är tillgänglig på GitHub och kan köras på plattformar som Google Colab och Kaggle. Denna öppenhet är i motsats till många andra stora AI -modeller och är avsedd att främja utvecklingen av världsmodeller inom robotik och förkroppsligad AI.

Ett paradigmskifte i AI -utvecklingen

V-JEPA 2 representerar ett grundläggande paradigmskifte från ren språkbearbetning till en djupare förståelse av den fysiska världen. Medan de flesta AI -företag förlitar sig på generativa modeller följer Meta en alternativ vision för framtiden för konstgjord intelligens med sin världsmodellstrategi. Möjligheten att lära av minimal data och möjliggöra nollskottsrobotkontroll kan bana väg för en ny generation av intelligenta system som inte bara förstår utan också kan agera i den verkliga världen.

Lämplig för detta:

Din globala marknadsförings- och affärsutvecklingspartner

☑ Vårt affärsspråk är engelska eller tyska

☑ Nytt: korrespondens på ditt nationella språk!

Jag är glad att vara tillgänglig för dig och mitt team som personlig konsult.

Du kan kontakta mig genom att fylla i kontaktformuläret eller helt enkelt ringa mig på +49 89 674 804 (München) . Min e -postadress är: Wolfenstein ∂ xpert.digital

Jag ser fram emot vårt gemensamma projekt.