Экскурсия по трансформации искусственного интеллекта: отчет о семинаре для специалистов и менеджеров

Предварительная версия Xpert

Выбор голоса 📢

Опубликовано по адресу: 10 мая 2025 г. / Обновление от: 10 мая 2025 г. - Автор: Конрад Вольфенштейн

Экскурсия по трансформации искусственного интеллекта: отчет о семинаре для специалистов и менеджеров-Image: xpert.digital

Что менеджеры теперь должны знать с ИИ: воспользоваться возможностями, управлять рисками, с уверенностью привести (время чтения: 32 мин / без рекламы / нет платежного стенка)

Овладеть революцией ИИ: введение в менеджеров

Перепроектирование преобразующей силы ИИ: перепроектирование работы и создание ценности

Искусственный интеллект (ИИ) считается технологией, которая открывается, как ни одна из других новых возможностей для принципиального переосмысления работы и создания стоимости. Для компаний интеграция искусственного интеллекта является важным шагом, чтобы оставаться успешным и конкурентоспособным в долгосрочной перспективе, поскольку она способствует инновациям, повышает эффективность и повышает качество. Экономические и социальные последствия ИИ значительны; Это одна из самых важных цифровых будущих тем, быстро развивает огромный потенциал. Компании все чаще осознают преимущества автоматизации и повышения эффективности с помощью ИИ. Это не просто технологические изменения, но и фундаментальные изменения в бизнес -моделях, оптимизации процессов и взаимодействия с клиентами, которые приспосабливаются к необходимости выживания в конкуренции.

Оснащенная «преобразующая сила» ИИ выходит за рамки чистого введения новых инструментов; Это подразумевает сдвиг парадигмы в стратегическом мышлении. Менеджеры обязаны пересмотреть основные процессы, обещание ценностей и даже отраслевые структуры. Если вы рассматриваете AI только инструментом эффективности, вы рискуете упускать из виду свой более глубокий стратегический потенциал. Быстрое развитие ИИ соответствует существующей нехватке квалифицированных работников. Это создает двойную задачу: с одной стороны, существует неотложная необходимость в быстрой дальнейшей квалификации, чтобы иметь возможность использовать ИИ. С другой стороны, KI предлагает возможность автоматизировать задачи и, следовательно, потенциально облегчить нехватку квалифицированных работников в некоторых областях, в то же время возникают новые квалификационные требования. Это требует нюансированного планирования персонала со стороны менеджеров.

Подходит для:

- Искусственный интеллект как стимул для бизнеса в компании: дальнейшие практические советы по внедрению ИИ в компаниях от одиннадцати временных менеджеров

Возможности взвешивания и риски в возрасте ИИ

Хотя системы ИИ предлагают очень эффективные возможности, они неразрывно связаны с рисками, которыми необходимо управлять. Дискурс вокруг ИИ включает в себя рассмотрение вашего значительного потенциала против неотъемлемых дисков, который требует сбалансированного подхода для использования преимуществ и минимизации недостатков. Компании сталкиваются с проблемой продвижения инноваций и в то же время соблюдать руководящие принципы по защите данных и этике, что делает баланс между прогрессом и соответствием определяющим.

Этот балансирующий акт -не одно решение, а постоянная стратегическая потребность. Благодаря дальнейшему развитию AI Technologies для примера от специализированного ИИ до более общих навыков-тип возможностей и рисков также изменится. Это требует постоянной переоценки и адаптации управления и стратегии. Восприятие рисков и преимуществ ИИ может значительно различаться в рамках организации. Например, активные пользователи ИИ, как правило, более оптимистичны, чем те, кто еще не представил ИИ. Это иллюстрирует критическую проблему в управлении изменениями для менеджеров: этот пробел в восприятии должен быть завершен образованием, четким общением и демонстрацией ощутимых преимуществ при одновременной решении проблем.

Понять ландшафт ИИ: основные концепции и технологии

Генеративный ки (генай) и путь к искусственному общему интеллекту (AGI)

Генеративный ки (генай)

Генеративный Ki (Genai) обозначает модели искусственного интеллекта, которые предназначены для создания нового контента в виде письменного текста, аудио, изображений или видео и предлагают широкий спектр приложений. Genai поддерживает пользователей в создании уникального, значимого контента и может выступать в качестве интеллектуальной системы вопросов-ответов или личного помощника. Genai уже революционизирует создание контента, маркетинга и лояльности клиентов, позволяя быстрому производству персонализированных материалов и автоматизации ответов.

Непосредственная доступность и широкий спектр применения от Genai означают, что он часто представляет «ИИ начального уровня» для многих организаций. Это первое прикосновение формирует восприятие и может стимулировать или препятствовать более широкой адаптации искусственного интеллекта. Менеджеры должны тщательно контролировать этот первый опыт, чтобы создать позитивную динамику.

Общий искусственный интеллект (AGI)

Искусственный общий интеллект (AGI) относится к гипотетическому интеллекту машины, которая способна понимать или изучить любую интеллектуальную задачу, которой может управлять человек, и, таким образом, имитирует человеческие когнитивные навыки. Речь идет о системах искусственного интеллекта, которые могут выполнять широкий спектр задач вместо того, чтобы специализироваться на спецификации.

Real Agi в настоящее время не существует; Это остается концепцией и целью исследования. OpenAI, ведущая компания в этой области, определяет AGI как «высокоаутономные системы, которые люди превышают в наиболее экономически ценной работе». К 2023 году были достигнуты только первый из пяти повышенных уровней AGI, который называется «Новым ИИ».

Неоднозначность и различные определения AGI предполагают, что менеджеры AGI должны рассматривать длительный, потенциально преобразующий горизонт, чем в качестве непосредственной оперативной проблемы. Основное внимание должно быть уделено использованию текущего «мощного ИИ» и в то же время стратегически наблюдать за прогрессом AGI. Из -за инвестиций в спекулятивные сценарии AGI могут отвлечь ресурсы от более непосредственных возможностей ИИ. Разработка специализированного ИИ через Genai для текущих исследований AGI подразумевает повышение уровня автономии и производительности систем ИИ. Эта тенденция напрямую коррелирует с растущей потребностью в надежных этических рамочных условиях и управлении, поскольку более влиятельный ИИ имеет больший потенциал для злоупотреблений или непреднамеренных последствий.

Подходит для:

Помощник ИИ против ИИ Агент: определить роли и навыки

Помощники ИИ поддерживают людей в отдельных задачах, реагируют на запросы, отвечают на вопросы и дают предложения. Они обычно реагируют и ждут человеческих команд. Ранние помощники регулярно основывались, но современные полагаются на машинное обучение (ML) или модели фундамента. Напротив, агенты искусственного интеллекта являются более автономными и способны преследовать цели и принимать решения независимо от минимального вмешательства человека. Они упреждают, могут взаимодействовать со своим окружением и адаптировать их, обучаясь.

Основные различия заключаются в автономии, сложности задач, взаимодействии с пользователем и навыками принятия решений. Помощники предоставляют информацию для человеческих решений, в то время как агенты могут принимать и принимать решения. В области применения помощники улучшают качество обслуживания клиентов, поддерживают HR -задачи в банковских запросах и оптимизируют. Агенты, с другой стороны, могут адаптироваться к поведению пользователя в режиме реального времени, активно предотвращать мошенничество и автоматизировать сложные процессы HR, такие как таланта.

Переход от помощников искусственного интеллекта к агентам ИИ сигнализирует о разработке от ИИ как «инструмента» к ИИ как «сотруднику» или даже как «автономного сотрудника». Это оказывает глубокое влияние на дизайн работы, командные структуры и необходимые навыки человеческих сотрудников, которым все чаще приходится управлять и работать с ними. Поскольку агенты ИИ становятся все более распространенными и способны принимать независимые решения, «разрыв в подотчетности» становится более насущной проблемой. Если агент ИИ принимает неправильное решение, распределение ответственности становится сложным. Это подчеркивает критическую необходимость надежного правительства ИИ, которое решает уникальные проблемы автономных систем.

Ниже приведено сравнение наиболее важных отличительных особенностей:

Сравнение помощников ИИ и агентов ИИ

Эта таблица предлагает менеджерам четкое понимание фундаментальных различий, чтобы выбрать правильную технологию для конкретных потребностей и предвидеть различные степени надзора и сложности интеграции.

Сравнение между помощниками ИИ и агентами ИИ показывает значительные различия в их характеристиках. В то время как помощники искусственного интеллекта довольно реагируют и ждут человеческих команд, агенты искусственного интеллекта действуют активно и автономно, действуя независимо. Основная функция помощника ИИ заключается в выполнении задач по запросу, тогда как агент ИИ направлен на достижение цели. Помощники искусственного интеллекта поддерживают людей в принятии решений, в то время как агенты искусственного интеллекта независимо принимают и реализуют решения. Учебное поведение двух также отличается: помощник искусственного интеллекта в основном учится ограниченным и на основе версий, в то время как агенты искусственного интеллекта являются адаптивными и постоянно обучающимися. Основными приложениями помощников искусственного интеллекта являются чат -боты и информационный вызов, но области применения агентов ИИ включают автоматизацию процессов, обнаружение мошенничества и решение сложных проблем. Взаимодействие с людьми требует постоянного вклада для помощника искусственного интеллекта, в то время как для агентов искусственного интеллекта необходимо только минимальное вмешательство человека.

Машиная комната: машинное обучение, большие голосовые модели (LLMS) и основные модели

Машинное обучение (ML)

Машинное обучение -это подразделение искусственного интеллекта, в котором компьютеры учатся на данных и улучшаются с опытом, не будучи явно запрограммированным. Алгоритмы обучены находить закономерности в больших наборах данных и принимать решения и прогнозы на основе этого. Модели ML включают в себя контролируемое обучение (обучение из маркированных данных), непреодолимое обучение (нахождение закономерности в не известных данных), частично контролируемое обучение (смешивание отмеченных и не отмеченных данных) и усиление обучения (обучение через эксперименты с вознаграждениями). ML повышает эффективность, сводит к минимуму ошибки и поддерживает принятие решений в компаниях.

Понимание различных типов машинного обучения важно не только для менеджеров с технической точки зрения, но и для понимания требований к данным. Например, контролируемое обучение требует большого количества высококачественных, маркированных записей данных, что оказывает влияние на стратегию данных и инвестиции. Хотя идентификация бизнес -проблем должна быть в начале, применимость определенного типа ML будет в значительной степени зависеть от доступности и типа данных.

Большие голосовые модели (LLMS)

Большие голосовые модели представляют собой своего рода алгоритм глубокого обучения, который обучается в огромных записях данных и часто используется в приложениях обработки естественного языка (NLP) для реагирования на запросы на естественном языке. Примерами этого являются серия GPT от Openai. LLMS может генерировать человеческие тексты, управлять чат -ботами и поддержать автоматизированное обслуживание клиентов. Тем не менее, вы также можете взять на себя неточности и искажения от учебных данных и вызвать обеспокоенность по поводу авторских прав и безопасности.

Проблема «запоминания» в LLMS, в которой вы буквально выводите текст из учебных данных, содержит значительные риски по авторскому праву и плагиату для компаний, которые используют контент, генерируемый LLM. Это требует тщательных процессов рассмотрения и понимания происхождения изданий LLM.

Базовые модели

Основные модели представляют собой большие модели ИИ, которые были обучены широким данным и могут быть адаптированы (тонко настраиваемые) для различных задач вниз по течению. Они характеризуются появлением (неожиданные навыки) и гомогенизацией (совместная архитектура). Они отличаются от классических моделей искусственного интеллекта тем, что изначально они являются домашними, используют самоконтролируемое обучение, обеспечивают обучение передачи и часто являются мультимодальными (обработка текста, изображение, аудио). LLMS - это своего рода базовая модель. Преимущества включают в себя более быстрый доступ к рынку и масштабируемость, но проблемы являются прозрачностью (проблема «черного ящика»), защита данных и высокие затраты или требования к инфраструктуре.

Рост основных моделей сигнализирует о изменении в направлении более универсального и более адаптируемого ИИ. Тем не менее, ваш «черный ящик» и значительные ресурсы, которые необходимы для вашего обучения или точной настройки, означают, что доступ и контроль могут быть сконцентрированы, что создает потенциально зависимости от нескольких крупных поставщиков. Это оказывает стратегическое влияние на решения «макияж или покупки» и риск блокировки поставщиков. Мультимодальная способность многих основных моделей открывает совершенно новые категории приложений, которые могут синтезировать результаты из разных типов данных (например, анализ текстовых отчетов вместе с записями мониторинга камеры). Это выходит за рамки того, что могут делать LLMS -основанные на текста LLM, и требует более широкого размышлений о их доступных базах данных.

Регулирующий компас: навигация через законные и этические рамочные условия

Закон ЕС Ки: основные положения и последствия для компаний

Закон ЕС Ки, который вступил в силу 1 августа 2024 года, является первым в мире всеобъемлющим законом ИИ и устанавливает систему классификации, основанную на рисках для ИИ.

Категории рисков:

- Незначительный риск: системы ИИ, которые представляют четкую угрозу для безопасности, средств к существованию и прав, запрещены. Примерами этого являются социальные оценки государственными органами, когнитивные манипуляции с поведением и нежелательное чтение изображений лица. Большинство из этих запретов вступают в силу до 2 февраля 2025 года.

- Высокий риск: системы ИИ, которые негативно влияют на безопасность или фундаментальные права. Они подлежат строгим требованиям, включая системы управления рисками, управление данными, техническую документацию, контроль человека и оценки соответствия перед рынком. Примерами являются ИИ в критических инфраструктурах, медицинских устройствах, занятости и правоохранительных органах. Большинство правил для искусственного интеллекта с высоким риском применяются с 2 августа 2026 года.

- Ограниченный риск. Системы ИИ, такие как чат -боты или те, которые генерируют глубокие статьи, должны соответствовать обязательствам по прозрачности и информировать пользователей, что они взаимодействуют с ИИ или что контент генерируется.

- Минимальный риск: системы ИИ, такие как спам-фильтры или видеоигры на основе искусственного интеллекта. Закон позволяет бесплатно использовать, хотя добровольные поведенческие навыки поощряются.

Подходит для:

- Системы ИИ, системы высокого риска и Закон о искусственном интеллекте для практики в компаниях и властях

Закон определяет обязательства для поставщиков, импортеров, трейдеров и пользователей (операторов) систем искусственного интеллекта, в соответствии с которыми поставщики систем высокого риска подлежат самым строгим требованиям. Благодаря экстратерриториальному применению, оно также влияет на компании за пределами ЕС, если их системы ИИ используются на рынке ЕС. Конкретные правила применяются к моделям ИИ с общей целью (модели GPAI), с дополнительными обязательствами для тех, которые классифицируются как «системный риск». Эти правила, как правило, применяются с 2 августа 2025 года. Если не соответствует непревзойденту, существует значительные штрафы, до 35 миллионов евро или 7 % от глобального годового оборота для запрещенных заявлений. С февраля 2025 года статья 4 также предписывает адекватный уровень компетентности ИИ для персонала поставщиков и операторов некоторых систем ИИ.

Основанный на рисках подход Закона ЕС AI требует фундаментальных изменений в подходе компаний к разработке и использованию ИИ. Это больше не просто техническая осуществимость или бизнес -ценность; Соответствие нормативным требованиям и снижение риска должны быть интегрированы с начала жизненного цикла ИИ («Соответствие по дизайну»). «Обязательство по компетенции ИИ» является важной, ранней решимостью. Это подразумевает немедленную необходимость для компаний для оценки и реализации учебных программ не только для технических команд, но и для тех, кто разрабатывает, использует или контролирует системы ИИ. Это выходит за рамки фундаментальной осведомленности и включает в себя понимание функциональных возможностей, ограничений, а также этических и правовых базой. В центре внимания закона на моделях GPAI, в частности те, на системном риске, указывает на нормативную проблему о широких и потенциально непредвиденных эффектах этих мощных, разнообразных моделей. Компании, которые используют или разрабатывают такие модели, подлежат интенсифицированному изучению и обязательствам, которые влияют на их планы развития и вводные стратегии на рынке.

Обзор категорий рисков Закона ЕС Ки и основных обязательств

Эта таблица суммирует основную структуру Закона ЕС Ки и помогает менеджерам быстро распознать, в какую категорию их системы ИИ могут попасть, и понимать соответствующую нагрузку и графики соответствия.

Обзор категорий рисков Закона ЕС KI показывает, что системы с неприемлемым риском, такие как социальная оценка, когнитивные манипуляции и нехисный соскабливание изображений лица, полностью запрещены и больше не могут применяться с февраля 2025 года. Hoch-Risiko-Ki, который используется, например, в критической инфраструктуре, медицинская департамента, поставка, поставка, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, образовательная, а также обширные обязательства. Среди прочего, поставщики и операторы должны иметь систему управления рисками, управление качеством данных и техническая документация, также обеспечивают прозрачность, обеспечивают такие критерии, как такие критерии, как надежность, точность, кибербезопасность и оценка соответствия. Соответствующие меры вступают в силу с августа 2026 года, частично с августа 2027 года. Ограниченный риск касается приложений ИИ, таких как чат -боты, системы обнаружения эмоций, системы биометрической категоризации и глубже. Обязательства по прозрачности, такие как маркировка в качестве системы ИИ или сгенерированный ИИ содержание, также считаются эффективными с августа 2026 года. Не существует конкретных обязательств для приложений ИИ с минимальным риском, таких как спам-фильтры или поддержанные ИИ видеоигры, при этом рекомендуются добровольные поведенческие Kodices. Такие системы могут быть использованы немедленно.

Поле поля напряжения инноваций Обязательство Расчеты: Найдите правильный баланс

Компании должны овладеть области напряженности между продвижением инноваций ИИ и гарантией подотчетности, защиты данных (GDPR) и этического использования. Принципы GDPR (законность, справедливость, прозрачность, обязательство цели, минимизация данных, правильность, подотчетность) являются фундаментальными для ответственного ИИ и влияют на то, как разрабатываются и используются системы ИИ. Стратегии баланса включают раннюю интеграцию групп по соблюдению и защите данных, регулярные аудиты, использование внешней экспертизы и использование специализированных инструментов соответствия. Некоторые не рассматривают нормативные руководящие принципы как инновационные тормоза, а как ускоритель, который укрепляет доверие и увеличивает принятие новых технологий.

«Обязательное обязательство инноваций на напряжение» - это не статический компромисс, а динамический баланс. Компании, которые активно внедряют ответственность и этические соображения в свой инновационный цикл искусственного интеллекта, с большей вероятностью создают устойчивые, заслуживающие доверия решения искусственного интеллекта. Это в конечном итоге способствует крупным инновациям, избегая дорогостоящей модернизации, повреждения репутации или регулирующих наказаний. Задача поддержания подотчетности подкрепляется растущей сложностью и потенциальной природой «черного ящика» передовых моделей ИИ (как обсуждалось в основных моделях). Это требует более сильного внимания к методам объяснения (XAI) и надежным механизмам аудита, чтобы гарантировать, что решения, принятые ИИ, можно понять, оправдать и оспариваться, если это необходимо.

🎯📊 Интеграция независимой и перекрестной платформы AI в масштабе источника 🤖🌐 для всех вопросов компании

Интеграция независимой и перекрестной платформы AI в масштабах для всех компаний Matters-Image: Xpert.Digital

Ki-GameChanger: наиболее гибкие решения AI-Tailor, которые снижают затраты, улучшают свои решения и повышают эффективность

Независимая платформа искусственного интеллекта: интегрирует все соответствующие источники данных компании

- Эта платформа ИИ взаимодействует со всеми конкретными источниками данных

- От SAP, Microsoft, Jira, Confluence, Salesforce, Zoom, Dropbox и многих других систем управления данными

- Быстрая интеграция AI: специально разработанные решения для ИИ для компаний в течение нескольких часов или дней вместо месяцев

- Гибкая инфраструктура: облачный или хостинг в вашем собственном центре обработки данных (Германия, Европа, свободный выбор местоположения)

- Самая высокая безопасность данных: использование в юридических фирмах является безопасным доказательством

- Используйте в широком спектре источников данных компании

- Выбор ваших собственных или различных моделей искусственного интеллекта (DE, EU, USA, CN)

Проблемы, которые решает наша платформа ИИ

- Отсутствие точности обычных решений ИИ

- Защита данных и безопасное управление конфиденциальными данными

- Высокие затраты и сложность индивидуального развития ИИ

- Отсутствие квалифицированного ИИ

- Интеграция ИИ в существующие ИТ -системы

Подробнее об этом здесь:

Стратегии искусственного интеллекта для менеджеров: практические руководящие принципы и примеры

Стратегии искусственного интеллекта для менеджеров: Практические руководящие принципы и примеры-изображение: xpert.digital

ИИ в действии: приложения, приложения и эффективное взаимодействие

Признайте возможности: приложения и приложения ИИ в разных отраслях промышленности

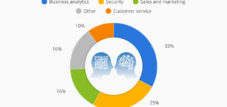

KI предлагает широкий спектр приложений, включая создание контента, персонализированный подход клиентов, оптимизацию процессов в производстве и логистике, направленное на дальнейшее обслуживание, а также поддержку в области финансов, человеческих ресурсов и ИТ.

Конкретные примеры отрасли включают:

- Автомобиль/производство: ИИ и моделирование в исследованиях (Arena2036), автоматизированное взаимодействие роботов (FESTO), оптимизация процессов и поддержание прогнозирования в производстве (BOSCH).

- Финансовые услуги: повышение безопасности за счет анализа больших объемов данных о подозрительных транзакциях, автоматическом счете, инвестиционном анализе.

- Здравоохранение: более быстрые диагнозы, расширенный доступ к медицинской помощи (например, интерпретация медицинских изображений), оптимизация фармацевтических исследований.

- Телекоммуникации: оптимизация производительности сети, аудиовизуальные улучшения, предотвращение миграции клиентов.

- Розничная торговля/электронная коммерция: персонализированные рекомендации, чат-боты для обслуживания клиентов, автоматизированные кассовые процессы.

- Маркетинг и продажи: создание контента (CHATGPT, Canva), оптимизированные кампании, сегментация клиентов, прогнозы продаж.

В то время как многие приложения направлены на автоматизацию и эффективность, важной новой тенденцией является роль ИИ при улучшении принятия решений человеком и обеспечением новых форм инноваций (например, разработка лекарств; разработка продукта). Менеджеры должны выходить за рамки снижения затрат, чтобы выявить варианты роста и инноваций, управляемых ИИ. Наиболее успешные реализации ИИ часто включают интеграцию ИИ в существующие основные процессы и системы (например, SAP использует KI в корпоративном программном обеспечении, Microsoft 365 Copilot) вместо того, чтобы рассматривать ИИ как независимую изолированную технологию. Это требует целостного взгляда на архитектуру компании.

Подходит для:

- Искусственный интеллект: пять ключевых стратегий для трансформации искусственного интеллекта, успешная интеграция для устойчивого корпоративного управления

Освоить диалог: эффективное подсказка для генеративного ИИ

Расшипная техническая инженерия -это итеративный, контролируемый тестовым процессом для улучшения вывода модели, который требует четких целей и систематического тестирования. Эффективные подсказки зависят как от содержания (инструкции, примеры, контекст), так и от структуры (порядок, маркировка, сепаратор).

Важными компонентами подсказки являются: цель/миссия, инструкции, ограничения (что делать/делать), звук/стиль, контекст/фоновые данные, несколько выстрелов, запрос на оправдание (цепочка) и желаемый формат ответов.

Лучшие практики включают:

- Установите четкие цели и используйте глаголы действия.

- Предоставить контекст и справочную информацию.

- Определите целевую группу точно.

- ИИ рассказывают, что он не должен делать.

- Сформулируйте быстрый, краткий, краткий и с точным выбором слов.

- Добавьте выходные границы, особенно для написания задач.

- Назначьте роль (например, «Вы - репетитор по математике»).

- Приглашение цепочки (использование взаимосвязанной подсказки) может генерировать непрерывные идеи.

Эффективное подсказка - это не менее поиск одной «идеальной подсказки», чем разработка стратегического подхода для взаимодействия с LLMS. Это включает в себя понимание модельных навыков, итеративного уточнения подсказок, основанных на выходе и использовании таких методов, как распределение ролей и цепочка, чтобы привести ИИ к желаемым результатам. Это способность, которая требует физических упражнений и критического мышления. Способность обеспечить соответствующий контекст и определять ограничения имеет первостепенное значение для получения ценных результатов Геная. Это означает, что качество контента, сгенерированного AI, часто напрямую пропорционально качеству и специфичности человеческого вклада, что подчеркивает постоянное значение человеческого опыта в процессе.

Лучшая практика для создания эффективных подсказок искусственного интеллекта

Эта таблица предлагает практические, реализуемые советы, которые менеджеры и специалисты могут сразу же применить для улучшения их взаимодействия с генеративными инструментами искусственного интеллекта.

Чтобы достичь ценных результатов в использовании генеративного ИИ, крайне важно конкретно и четко решать, чтобы точно определить цель и использовать глаголы действия, такие как «создать список ключевых пунктов, которые суммируют наиболее важные результаты статьи». Так же важно предоставить контекст, например, путем предоставления справочной информации и соответствующих данных, таких как «На основании финансового отчета, анализ прибыльности последних пяти лет». Целевая группа и желаемый звук должны быть четко сформулированы, такие как «Напишите описание продукта для молодых людей, которые ценят устойчивость». ИИ также может быть назначена конкретная роль или личность, например, «вы являетесь экспертом по маркетингу. Дерворт кампанию для ...». С помощью нескольких примеров, таких как «Вход: Apple. Выход: Фрукты. Вход: Carrow. Точное форматирование ответов также разумно определить, как «форматировать ваш ответ в Markdown». Такие ограничения, как «Избегайте технического жаргона. Ответ больше не должен составлять более 200 слов», чтобы оптимизировать вывод. Итеративный подход, в котором подсказка адаптирована и утончена на основе предыдущих результатов, еще больше повышает качество. Наконец, цепь может использоваться мыслями (цепочка), попросив ИИ объяснить его процесс мышления шаг за шагом, например, «Объясните свой аргумент шаг за шагом».

Возьмите Invisible AI: понимать и управлять теневыми приложениями (Shadow AI)

Schadten-Ki обозначает несанкционированное или нерегулируемое использование инструментов ИИ сотрудниками, часто для повышения производительности или для предотвращения медленных официальных процессов. Это подкатегория тени.

Риски тени Ки:

- Безопасность данных и защита данных: несанкционированные инструменты могут привести к нарушениям защиты данных, раскрытие конфиденциальных данных общественности/компании и неразрешения с GDPR/HIPAA.

- Соответствие и право: нарушения законов о защите данных, проблемы с авторским правом, конфликты со свободой информации. Запрос «компетентности ИИ» Закона ЕС Ки с февраля 2025 года срочно делает аргумент.

- Экономически/операционно: неэффективные параллельные структуры, скрытые затраты через отдельные подписки, отсутствие контроля над лицензиями, несовместимость с существующими системами, нарушение рабочих процессов, снижение эффективности.

- Качество и контроль: отсутствие прозрачности в обработке данных, потенциал для предвзятых или вводящих в заблуждение результатов, эрозия общественного/внутреннего доверия.

- Подрыв управления: обход ИТ -правительства, что затрудняет обеспечение соблюдения руководящих принципов безопасности.

Стратегии управления Шадтен-Ки:

- Разработка четкой стратегии ИИ и создания ответственного руководства по ИИ.

- Предоставление официальных, утвержденных инструментов ИИ в качестве альтернатив.

- Определение четких рекомендаций для использования искусственного интеллекта, обработки данных и утвержденных инструментов.

- Обучение и сенсибилизация сотрудников для ответственного использования ИИ, рисков и лучших практик.

- Внедрение регулярных аудитов для раскрытия неавторизованного ИИ и обеспечения соответствия.

- Принятие постепенного подхода правительства ИИ, начиная с небольших шагов и уточнения руководящих принципов.

- Продвижение кросс -департамента сотрудничества и вовлечения сотрудников.

Шадтен-Ки часто является симптомом невыполненных потребностей пользователей или чрезмерных бюрократических процессов при введении технологии. Чисто ограничительный подход («запретный ИИ») может иметь неприятные последствия. Эффективное управление требует понимания причин и обеспечения практических, безопасных альтернатив в дополнение к четкому управлению. Рост легкодоступных инструментов Genai (таких как CHATGPT), вероятно, ускорил распространение Шаттен-Ки. Сотрудники могут быстро использовать эти инструменты без участия. Это делает упреждающую обучение компетентности искусственного интеллекта (как того требует Закон ЕС KI) и четкую связь с помощью утвержденных инструментов еще более важным.

Риски теневого ИИ и стратегических реакций

Эта таблица предлагает структурированный обзор разнообразных угроз от нерегулируемого использования ИИ и конкретных, реализуемых стратегий для менеджеров.

Теневой ИИ несет многочисленные риски, с которыми компании должны стратегически столкнуться. Утечки данных, несанкционированный доступ к конфиденциальной информации или вредоносных программных инфекциям в области безопасности данных. Стратегические меры включают введение руководства по использованию ИИ, создание списка утвержденных инструментов, использование шифрования, реализацию строгого контроля доступа и обучение сотрудников. Что касается рисков соответствия, таких как нарушения GDPR, нарушения отраслевых норм или нарушение авторских прав, регулярные аудиты, последовательности защиты данных на основе данных (DSFA) для новых инструментов, четко определенные руководящие принципы для обработки данных и, если необходимо, необходимы юридическая консультация. Финансовые риски возникают из неконтролируемых расходов на подписки, избыточные лицензии или неэффективность. Поэтому компании должны полагаться на централизованные закупки, строгий контроль бюджета и регулярный обзор использования инструментов. Оперативные проблемы, такие как противоречивые результаты, несовместимость с существующими системами компаний или расстройства процесса, могут быть освоены путем предоставления стандартизированных инструментов, их интеграции в существующие рабочие процессы и постоянный контроль качества. Наконец, репутационные риски представляют опасность, например, потеря доверия клиентов в результате разбивки данных или неправильной общения, сгенерированной ИИ. Прозрачное общение, соблюдение руководящих принципов этики и хорошо продуманного плана реагирования на инциденты являются решающими мерами для поддержания доверия к компании и минимизации возможного ущерба.

🎯🎯🎯 Воспользуйтесь обширным пятикратным опытом Xpert.Digital в комплексном пакете услуг | НИОКР, XR, PR и SEM

Машина для 3D-рендеринга AI и XR: пятикратный опыт Xpert.Digital в комплексном пакете услуг, исследования и разработки XR, PR и SEM — Изображение: Xpert.Digital

Xpert.Digital обладает глубокими знаниями различных отраслей. Это позволяет нам разрабатывать индивидуальные стратегии, которые точно соответствуют требованиям и задачам вашего конкретного сегмента рынка. Постоянно анализируя тенденции рынка и следя за развитием отрасли, мы можем действовать дальновидно и предлагать инновационные решения. Благодаря сочетанию опыта и знаний мы создаем добавленную стоимость и даем нашим клиентам решающее конкурентное преимущество.

Подробнее об этом здесь:

Как преобразовать лидерство и сотрудничество и укрепить мягкие навыки в лидерстве: человеческое преимущество в AI Age

Как трансформировать лидерство и сотрудничество и укрепить мягкие навыки в лидерстве: человеческое преимущество в возрасте AI-Image: Xpert.Digital

Человеческий элемент: влияние ИИ на лидерство, сотрудничество и творчество

Изменение лидерства в эпохе ИИ: новые требования и компетенции

ИИ требует сдвига в лидерстве к уникальным человеческим навыкам: осознание, сострадание, мудрость, сочувствие, социальное понимание, прозрачное общение, критическое мышление и адаптивность. Менеджеры должны развить технологическую компетентность, чтобы принимать обоснованные решения об инструментах ИИ и ведущих командах посредством перемен. Это включает в себя понимание данных и критическую оценку информации, сгенерированной AI.

Наиболее важные управленческие задачи включают в себя содействие культуре управления данными принятия решений, эффективного управления изменениями, справки с этическими соображениями через правительство ИИ и содействие инновациям и творчеству. ИИ может избавить менеджеров рутинных задач, чтобы они могли сосредоточиться на стратегических и человеческих аспектах, таких как мотивация и развитие сотрудников. Может возникнуть новая роль «главного сотрудника по инновациям и трансформации» (CITO), которая сочетает в себе технический опыт, знание поведения и стратегического видения. Менеджеры должны ориентироваться в сложных этических ландшафтах, содействовать культурным преобразованию, управлять сотрудничеством между людьми и ИИ, стимулировать перекрестную интеграцию и обеспечивать ответственные инновации.

Основной задачей для менеджеров в возрасте ИИ является не только понимание ИИ, но и привести человеческую реакцию на ИИ. Это включает в себя выращивание культуры обучения, борьбу с страхами до потери работы и возникновения этического использования ИИ, что делает мягкие навыки более важными, чем когда -либо. Существует потенциальное расхождение в восприятии межличностных отношений в возрасте ИИ: 82 % сотрудников считают их необходимыми, по сравнению с только 65 % менеджеров. Этот разрыв может привести к стратегиям лидерства, которые слишком мало вкладывают в человеческие связи и потенциально ухудшают мораль и сотрудничество. Эффективное руководство по ИИ включает в себя парадоксальный набор способностей: принятие объективности, контролируемой данными с помощью ИИ, при этом усиливая субъективное человеческое суждение, интуицию и этические аргументы. Речь идет о расширении человеческого интеллекта, а не создании искусственного интеллекта.

Подходит для:

- Принятие внедрения новых технологий, таких как искусственный интеллект, расширенная и дополненная реальность, и как это можно продвигать.

Преобразование командной работы: влияние ИИ на сотрудничество и динамику команды

ИИ может улучшить командную работу, автоматизируя рутинные задачи и позволяет сотрудникам сосредоточиться на стратегической и творческой работе. Системы ИИ могут поддерживать лучшее принятие решений, анализируя данные и предоставляя команды. Инструменты искусственного интеллекта могут способствовать улучшению общения и координации, обеспечить сотрудничество в реальном времени и обмен информацией и ресурсами. Управление знаниями на основе ИИ может облегчить доступ к централизованным знаниям, обеспечить интеллектуальные поиски и способствовать обмену знаниями. Сочетание человеческих творческих навыков, суждений и эмоционального интеллекта с анализом данных и навыками автоматизации ИИ может привести к более эффективной и хорошо обоснованной работе.

Проблемы включают гарантию защиты данных и обработку этических данных в совместных инструментах искусственного интеллекта, потенциал «потери компетентности» среди сотрудников, если ИИ выполняет слишком много задач без стратегии для дальнейшей квалификации и страха, что личные контакты могут стать менее распространенными.

В то время как ИИ может повысить эффективность сотрудничества (например, более быстрое закупки информации, автоматизация задач), менеджеры должны активно работать над поддержанием качества взаимодействия человека и сплоченности команды. Это означает разработку рабочих процессов таким образом, что члены команды искусственного интеллекта дополняли вместо изолированных и создают возможности для реальных человеческих связей. Успешная интеграция ИИ в командную работу сильно зависит от доверия к надежности и справедливости технологий, а также доверия среди членов команды, как используются знания на основе ИИ. Отсутствие доверия может привести к сопротивлению и предпринять совместные усилия.

ИИ как творческий партнер: расширение и переопределение творчества в организациях

Генеративный ИИ может, если он вводится стратегически и тщательно, создать среду, в которой сосуществуют человеческое творчество и ИИ и работают вместе. ИИ может продвигать творчество, выступая в качестве партнера, предлагая новые перспективы и смещая пределы возможных в таких областях, как медиа, искусство и музыка. ИИ может автоматизировать рутинные акции творческих процессов и, таким образом, выпускать людей для более концептуальной и инновационной работы. Это также может помочь распознать новые тенденции или ускорить разработку продуктов с помощью экспериментов на основе искусственного интеллекта.

Этическая дилемма и проблемы возникают из-за того, что сгенерированный AI содержание ставит под сомнение традиционные идеи авторства, оригинальности, автономии и намерения. Использование данных, защищенных авторским правом для обучения моделей ИИ и генерации потенциально юридического содержания, является значительной проблемой. Кроме того, существует риск чрезмерной зависимости от ИИ, что потенциально может подавить независимое развитие творчества человека и развитие компетентности в долгосрочной перспективе.

Интеграция ИИ в творческие процессы-это не только вопрос новых инструментов, но и фундаментальное переопределение творчества, сами по себе, модель творчества человека-ки. Это требует изменения в менталитете для творческих специалистов и их менеджеров, которые подчеркивали работу с ИИ в качестве нового модальности. Этические соображения, связанные с сгенерированным AI контентом (авторство, предвзятость, Deepfakes), означают, что организации не могут просто взять на себя творческие инструменты ИИ без надежных этических руководящих принципов и надзора. Менеджеры должны убедиться, что ИИ ответственно используется для расширения творчества, а не для обмана или нарушения.

Создание порядка: реализация правительства ИИ для ответственного преобразования

Потребность в правительстве ИИ: почему это важно для ее компании

Правительство ИИ гарантирует, что системы ИИ разрабатываются и используются этически, прозрачно и в соответствии с человеческими ценностями и юридическими требованиями.

Важными причинами для правительства ИИ являются:

- Этические соображения: учитывает потенциал предвзятых решений и несправедливых результатов, обеспечивает справедливость и уважение к правам человека.

- Юридические и нормативные требования: обеспечивает соблюдение разработки законов, специфичных для ИИ (таких как Закон ЕС Ки) и существующие правила защиты данных (GDPR).

- Управление рисками: предлагает основу для выявления, оценки и контроля рисков, связанных с ИИ, такими как потеря доверия клиентов, потеря компетентности или предвзятые процессы принятия решений.

- Наблюдение: способствует прозрачности и объяснению в случае решений ИИ и создает доверие среди сотрудников, клиентов и заинтересованных сторон.

- Максимизация стоимости: убедитесь, что использование ИИ ориентировано на бизнес -цели, и его преимущества эффективно реализованы.

Без разумного управления ИИ может привести к непреднамеренному ущербу, этическому нарушениям, юридическим наказаниям и повреждению репутации.

Правительство ИИ - это не просто функция соблюдения требований или снижения риска, но и стратегический пионер. Определяя четкие правила, обязанности и этические руководящие принципы, организации могут продвигать среду, в которой инновации искусственного интеллекта могут процветать ответственно, что приводит к более устойчивым и более надежным решениям искусственного интеллекта. Необходимость в правительстве ИИ напрямую пропорциональна растущей автономии и сложности систем ИИ. Если организации из простых помощников ИИ передают более сложным агентам ИИ и основным моделям, объем и строгость управления также должны быть дополнительно разработаны, чтобы справиться с новыми проблемами с точки зрения обязательств по бухгалтерскому учету, прозрачности и контроля.

Рабочие работы и лучшие практики для эффективного правительства ИИ

Подходы управления варьируются от неформальных (на основе корпоративных ценностей) до специальных решений (реакция на конкретные проблемы) до формальных (комплексные рамочные работы).

Ведущие рамочные работы (примеры):

- NIST AI-структура управления рисками (AI RMF): фокусируется на поддержке организаций в управлении рисками, связанными с ИИ, с помощью таких функций, как налоги, картирование, измерение и управление.

- ISO 42001: устанавливает комплексную систему управления искусственным интеллектом, которая требует руководящих принципов, управления рисками и постоянного улучшения.

- Принципы ОЭСР: содействовать ответственному обращению с ИИ и подчеркивают права человека, справедливость, прозрачность и подотчетность.

Лучшая практика для реализации:

- Создание внутренних структур управления (например, этика AI, межфункциональные рабочие группы) с четкими ролями и обязанностями.

- Внедрение системы классификации, основанной на рисках, для приложений искусственного интеллекта.

- Обеспечение надежного правительства и управления данных, включая качество данных, защиту данных и проверку искажений.

- Внедрение обзоров соответствия и соответствия на основе соответствующих стандартов и правил.

- Назначить человеческий надзор, особенно для систем высокого риска и критических решений.

- Интеграция заинтересованных сторон (сотрудников, пользователей, инвесторов) посредством прозрачного общения.

- Разработка четких этических руководящих принципов и их интеграция в цикл развития ИИ.

- Инвестиции в учебные курсы и управление изменениями для обеспечения понимания и принятия руководящих принципов управления.

- Начните с четко определенных приложений и пилотных проектов, а затем постепенно масштабирование.

- Управление каталогом систем ИИ, используемых в компании.

Эффективное правительство ИИ не является единичным решением. Организации должны адаптировать рамочные работы, такие как NIST AI RMF или ISO 42001, к своей конкретной отрасли, размеру, риска к риску и типам ИИ, который они используют. Чисто теоретическое поглощение структуры без практической адаптации, вероятно, не эффективно. «Фактор человека» в правительстве ИИ так же важен, как и аспекты «процесс» и «технология». Это включает в себя четкое задание подотчетности, комплексного обучения и продвижения культуры, которая ценит этическое и ответственное использование ИИ. Без принятия и понимания со стороны сотрудников даже наиболее разработанная структура управления потерпит неудачу.

Ключевые компоненты правительственной рамки ИИ

Эта таблица предлагает комплексный контрольный список и инструкции для менеджеров, которые хотят создать или улучшить свое правительство ИИ.

Ключевые компоненты правительственной структуры ИИ имеют решающее значение для обеспечения ответственного и эффективного использования ИИ. Центральные принципы и этические руководящие принципы должны размышлять о корпоративных ценностях и ориентироваться на права человека, справедливость и прозрачность. Роли и обязанности должны быть четко определены; Это включает в себя совет по этике ИИ, управляющие данными и модельные экзаменаторы, в результате чего задачи, полномочия по принятию решений и обязательства по учетной записи должны быть четко определены. Эффективное управление рисками требует идентификации, оценки и снижения рисков, таких как определяемые на основе категорий законов ЕС Ки. Регулярные оценки риска, а также разработка и мониторинг стратегий сокращения играют центральную роль здесь. Управление данных гарантирует, что такие аспекты, как качество, защита данных, безопасность и распознавание предвзятости, учитываются, включая соблюдение GDPR и меры против дискриминации. Управление жизненным циклом модели включает в себя стандартизированные процессы для разработки, валидации, использования, мониторинга и ввода в эксплуатацию и уделяют особое внимание документации, управлению версиями и непрерывным мониторингом производительности. Прозрачность и объяснение необходимы для обеспечения отслеживания решений ИИ и раскрытия использования ИИ. Соответствие требованиям к юридическим требованиям, такими как Закон ЕС KI и GDPR, также должно быть обеспечено путем постоянных обзоров и корректировок процессов, а также сотрудничества с юридическим департаментом. Обучение и заточка сознания для разработчиков, пользователей и менеджеров способствует пониманию баз ИИ, этических аспектов и руководящих принципов управления. Наконец, реакция инцидента и исправление должны быть гарантированы для эффективного устранения неисправностей, этических нарушений или инцидентов безопасности. Это включает в себя установленные маршруты отчетности, процессы эскалации и корректирующие меры, которые обеспечивают быстрое и целенаправленное вмешательство.

Подходит для:

- Гонка в области искусственного интеллекта (ИИ): 7 стран, за которыми следует следить, включая Германию – десять советов

Возьмите лидерство: стратегический императив для трансформации ИИ

Культивировать готовность ИИ: роль непрерывного обучения и дальнейшей квалификации

В дополнение к специализированным знаниям менеджеры нуждаются в стратегическом понимании ИИ, чтобы эффективно продвигать свои компании. Обучение ИИ для менеджеров должна охватывать базы ИИ, успешные тематические исследования, управление данными, этические соображения и идентификацию потенциала ИИ в их собственной компании. С 2 февраля 2025 года Закон ЕС Ки (ст. 4) предписывает «компетентность ИИ» для персонала, который участвует в разработке или использовании систем ИИ. Это включает в себя понимание технологий искусственного интеллекта, знаний применения, критического мышления и условий правовой основы.

Преимущества обучения ИИ для менеджеров включают в себя возможность управления проектами ИИ, разработки устойчивых стратегий ИИ, оптимизировать процессы, обеспечить конкурентные преимущества и обеспечить этическое и ответственное использование ИИ. Отсутствие компетентности и навыков ИИ является значительным препятствием для адаптации ИИ. Доступны различные форматы обучения: курсы по сертификатам, семинары, онлайн -курсы, обучение присутствию.

Готовность ИИ означает не только приобретение технических навыков, но и продвижение способа мышления о непрерывном обучении и адаптивности во всей организации. Ввиду быстрого развития ИИ конкретное обучение на основе инструментов может быть устаревшим. Следовательно, базовые знания и навыки ИИ для критического мышления являются более постоянными инвестициями. «Обязательство по компетенции ИИ» от Закона ЕС Ки является регулирующим фактором для дальнейшей квалификации, но организации должны рассматривать это как возможность, а не просто нагрузку на соответствие. Более AI-компетентная рабочая сила лучше оборудована для выявления инновационных приложений для искусственного интеллекта, эффективного использования инструментов и для понимания этических последствий, что приводит к лучшим результатам ИИ в целом. Существует четкая связь между отсутствием навыков/понимания ИИ и распространением теневого ИИ. Инвестиции в комплексную формирование искусственного интеллекта могут напрямую снизить риски, связанные с неавторизованным использованием ИИ, позволяя сотрудникам принимать обоснованные и ответственные решения.

Шансы и риски синтезируются: дорожная карта для суверенного лидерства ИИ

Управление трансформацией ИИ требует целостного понимания потенциала технологий (инновации, эффективность, качество) и его неотъемлемые риски (этические, юридически, социально).

Упреждающий дизайн поездок искусственного интеллекта в организации включает в себя суверенное руководство ИИ:

- Создание надежного правительства ИИ на основе этических принципов и правовых рамках, таких как Закон ЕС Ки.

- Продвижение культуры непрерывного обучения и компетентности ИИ на всех уровнях.

- Стратегическая идентификация и приоритет приложений искусственного интеллекта, которые обеспечивают осязаемую ценность.

- Укрепление человеческих талантов посредством акцента на навыках дополняется вместо замены и управления человеческими последствиями ИИ.

- Проактивные проблемы управления, такие как Шаттен-Ки.

Конечная цель состоит в том, чтобы использовать ИИ в качестве стратегического пионера для устойчивого роста и конкурентных преимуществ и в то же время уменьшить их потенциальные недостатки. Настоящее «суверенное руководство ИИ» выходит за рамки внутреннего организационного управления и включает в себя более широкое понимание социальных последствий ИИ и роли компании в этой экосистеме. Это означает участие в политических дискуссиях, способствуя определению этических стандартов и обеспечению того, чтобы ИИ использовался для социального скважины и не только для прибыли. Путешествие трансформации ИИ не является линейным и будет содержать навигацию через неоднозначности и неожиданные проблемы. Поэтому менеджеры должны развивать организационную ловкость и устойчивость, чтобы их команды могли адаптироваться к непредвиденному технологическому прогрессу, нормативным изменениям или расстройствам, связанным с рынком, со стороны ИИ.

Подходит для:

- Десять лучших по консалтингу и планированию — Обзор и советы по искусственному интеллекту: различные модели ИИ и типичные области применения

Понимание и использование технологий: базы ИИ для лиц, принимающих решения,

Трансформация с помощью искусственного интеллекта больше не является отдаленным видением будущего, а в нынешней реальности, которая бросает вызов компаниям всех размеров и отраслей и в то же время предлагает огромные возможности. Для специалистов и менеджеров это означает играть активную роль в проектировании этого изменения, чтобы ответственно поднять потенциал ИИ и уверенно управлять связанными рисками.

Основы ИИ, от генеративных моделей до различия между помощниками и агентами до технологических драйверов, таких как машинное обучение и базовые модели, составляют основу для более глубокого понимания. Эти знания необходимы для того, чтобы иметь возможность принимать обоснованные решения об использовании и интеграции систем ИИ.

Правовая база, в частности, Закон ЕС KI, устанавливает четкие руководящие принципы для разработки и применения ИИ. Основанный на рисках подход и полученные обязательства, особенно для систем высокого риска и в отношении необходимой компетентности сотрудников ИИ требуют упреждающего обсуждения и реализации надежных структур управления. Область напряженности между стремлением к инновациям и необходимостью подотчетности должна быть распущена из -за интегрированной стратегии, которая рассматривает соответствие и этику как неотъемлемая часть инновационного процесса.

Возможное использование ИИ разнообразны и в разных отраслях. Идентификация подходящих вариантов использования, контроль эффективных методов взаимодействия, таких как подсказка и сознательное использование теневых приложений, является ключевым компетенциями для реализации дополнительной стоимости ИИ в вашей собственной области ответственности.

И последнее, но не менее важное, ИИ устойчиво меняет путь, как это руководствовалось, работают вместе, и творчество проживает. Менеджеры обязаны адаптировать свои навыки, чтобы больше сосредоточиться на человеческих навыках, таких как эмпатия, критическое мышление и управление изменениями, а также создать культуру, в которой люди и машинная работа синергетически. Содействие сотрудничеству и интеграции ИИ как творческого партнера требуют новых способов мышления и управления.

Создание комплексного правительства ИИ - это не дополнительный аксессуар, а стратегическая необходимость. Это создает основу для этического, прозрачного и безопасного использования ИИ, сводит к минимуму риски и укрепляет доверие к всем заинтересованным сторонам.

Преобразование ИИ - это путешествие, которое требует непрерывного обучения, адаптивности и четкого видения. Специалисты и менеджеры, которые сталкиваются с этими проблемами и усваивают принципы и практики, изложенные здесь, хорошо оборудованы для разработки будущего своих организаций, областей и команд и уверенно в эпоху искусственного интеллекта.