Искусственный интеллект в финансовой журналистике: Bloomberg сталкивается с проблемами из-за некорректных сводок, созданных ИИ

Предварительная версия Xpert

Выбор голоса 📢

Опубликовано: 6 апреля 2025 г. / Обновлено: 6 апреля 2025 г. – Автор: Konrad Wolfenstein

Искусственный интеллект в финансовой журналистике: Bloomberg сталкивается с проблемами из-за некорректных сводок, созданных ИИ – Изображение: Xpert.Digital

Достигнуты ли на данный момент пределы возможностей искусственного интеллекта в журналистике?

Подходят ли решения на основе ИИ для повседневного использования? Неудачный старт Bloomberg с автоматизированными сводками

Интеграция искусственного интеллекта в журналистику ставит перед медиакомпаниями сложные задачи, как показывает недавний случай с Bloomberg. Финансовый новостной сервис экспериментирует с созданием ИИ-генерируемых резюме для своих статей с января 2025 года, но уже был вынужден исправить как минимум 36 ошибочных резюме. Эта ситуация подчеркивает трудности внедрения систем ИИ в редакционные процессы, особенно в отношении точности, надежности и доверия к автоматизированному контенту. В следующих разделах рассматриваются конкретные проблемы Bloomberg, помещаются в контекст общих проблем ИИ и обсуждаются потенциальные решения для успешной интеграции ИИ в журналистику.

Подходит для:

- Trusty AI: Европейская карта Трампа и вероятность взять на себя ведущую роль в искусственном интеллекте

Проблемный выход Bloomberg на рынок контента, создаваемого искусственным интеллектом

Потенциал ошибок в сводках, созданных с помощью ИИ

Bloomberg, ведущая мировая компания, специализирующаяся на финансовых новостях, начала использовать сгенерированные искусственным интеллектом маркированные списки в качестве резюме в начале своих статей в начале 2025 года. Однако с момента запуска этой функции 15 января компании пришлось исправить как минимум три десятка таких автоматизированных резюме, что указывает на серьезные проблемы с точностью контента, сгенерированного ИИ. Эти проблемы особенно тревожны для такой компании, как Bloomberg, которая известна своей точной финансовой отчетностью и информация которой часто может напрямую влиять на инвестиционные решения. Необходимость многочисленных исправлений подрывает доверие к надежности этой новой технологии и поднимает вопросы о преждевременном внедрении систем ИИ в журналистику.

Одна особенно существенная ошибка произошла, когда агентство Bloomberg сообщило о планах президента Трампа ввести пошлины на автомобили. Хотя в оригинальной статье правильно указывалось, что Трамп может объявить о введении пошлин в тот же день, сгенерированное ИИ резюме содержало неверную информацию о сроках введения более масштабных пошлин. В другом случае, резюме, созданное ИИ, ошибочно утверждало, что президент Трамп введет пошлины на товары из Канады уже в 2024 году. Такие ошибки демонстрируют ограничения ИИ в интерпретации сложных новостей и риски публикации непроверенного, автоматизированного контента.

Помимо неверных дат, ошибки также включали неточные цифры и ошибочное приписывание действий или заявлений отдельным лицам или организациям. Эти типы ошибок, часто называемые «галлюцинациями», представляют собой особую проблему для систем искусственного интеллекта, поскольку они могут звучать правдоподобно и поэтому их трудно обнаружить без тщательной проверки человеком. Частота таких ошибок в Bloomberg подчеркивает необходимость надежных процессов проверки и поднимает вопросы о зрелости используемой технологии ИИ.

Реакция Bloomberg на проблемы искусственного интеллекта

В официальном заявлении Bloomberg подчеркнул, что 99 процентов созданных с помощью ИИ кратких обзоров соответствуют редакционным стандартам. Компания заявляет, что ежедневно публикует тысячи статей и поэтому считает уровень ошибок относительно низким. Bloomberg утверждает, что ценит прозрачность и исправляет или обновляет статьи по мере необходимости. Компания также подчеркнула, что журналисты полностью контролируют, будет ли опубликован созданный с помощью ИИ обзор или нет.

В эссе от 10 января, основанном на лекции в лондонском City St. George's, главный редактор Bloomberg Джон Миклтуэйт описал причины создания кратких обзоров с помощью ИИ. Он объяснил, что клиенты ценят их, потому что они могут быстро понять суть истории, в то время как журналисты относятся к ним более скептически. Он признал, что репортеры опасаются, что читатели могут полагаться исключительно на обзоры и пренебречь основной идеей. Тем не менее, Миклтуэйт подчеркнул, что ценность обзора, созданного с помощью ИИ, полностью зависит от качества самой истории, а для этого человеческий опыт остается решающим.

Представитель Bloomberg сообщил газете The New York Times, что отзывы о сводках в целом положительные и что компания продолжает работать над улучшением пользовательского опыта. Это заявление говорит о том, что, несмотря на возникшие проблемы, Bloomberg намерен придерживаться своей стратегии использования ИИ для создания сводок, но с большим упором на обеспечение качества и совершенствование используемой технологии.

Искусственный интеллект в журналистике: тема, актуальная для всей отрасли

Опыт других медиакомпаний в использовании ИИ

Bloomberg — не единственная медиакомпания, экспериментирующая с интеграцией ИИ в свои журналистские процессы. Многие новостные организации пытаются понять, как лучше всего внедрить эту новую технологию в свою работу по подготовке репортажей и редакционной деятельности. Газетная сеть Gannett использует аналогичные сгенерированные ИИ резюме для своих статей, а The Washington Post разработала инструмент под названием «Спроси Post», который генерирует ответы на вопросы из опубликованных статей Post. Такое широкое внедрение демонстрирует значительный интерес медиаиндустрии к технологиям ИИ, несмотря на связанные с ними риски и проблемы.

Другие медиакомпании также сталкивались с проблемами, связанными с инструментами искусственного интеллекта. В начале марта газета Los Angeles Times удалила свой инструмент ИИ из статьи с мнением эксперта после того, как технология описала Ку-клукс-клан не как расистскую организацию. Этот инцидент показывает, что проблемы, с которыми сталкивается Bloomberg, не являются единичным случаем, а симптомом более широких проблем с интеграцией ИИ в журналистику. Вырисовывается закономерность: технология еще недостаточно зрела, чтобы надежно функционировать без участия человека, особенно при работе с деликатными или сложными темами.

Эти примеры иллюстрируют противоречие между стремлением к инновациям и эффективности с помощью ИИ, с одной стороны, и необходимостью поддерживать журналистские стандарты и точность, с другой. Медиакомпании должны соблюдать баланс: они хотят извлечь выгоду из преимуществ ИИ, не рискуя доверием своих читателей и не поступаясь основополагающими журналистскими принципами. Опыт Bloomberg и других новостных организаций служит важным уроком для всей отрасли о возможностях и ограничениях ИИ в журналистике.

Подходит для:

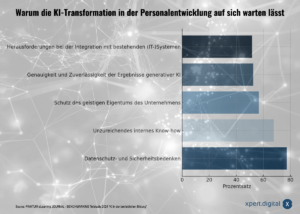

- Одна из причин нерешительного использования ИИ: 68% HR-менеджеров жалуются на недостаток знаний в области ИИ в компаниях

Особая сложность финансовой журналистики

В финансовом секторе, где Bloomberg является одним из ведущих новостных сервисов, требования к точности и достоверности особенно высоки. Влияние ложной информации может иметь значительные финансовые последствия, поскольку инвесторы и финансовые эксперты принимают решения, основываясь на таких новостях. Эта особая ответственность делает интеграцию технологий искусственного интеллекта в финансовую журналистику еще более сложной задачей, чем в других областях репортажей.

Интересно, что «универсальный ИИ» превзошел специализированный ИИ Bloomberg именно в своей области: анализе финансовых отчетов. Сообщается, что Bloomberg инвестировал не менее 2,5 миллионов долларов в разработку собственного финансового ИИ, но менее чем через год после его запуска в конце марта 2023 года стало ясно, что универсальные модели ИИ, такие как ChatGPT и GPT-4, показали лучшие результаты в этой области. Это иллюстрирует стремительные темпы развития искусственного интеллекта и трудности, с которыми сталкиваются компании, пытаясь угнаться за специализированными решениями по мере того, как универсальные модели становятся все более мощными.

🎯🎯🎯 Воспользуйтесь преимуществами обширного пятистороннего опыта Xpert.Digital в комплексном пакете услуг | BD, R&D, XR, PR и оптимизация цифровой видимости

Воспользуйтесь преимуществами обширного пятистороннего опыта Xpert.Digital в комплексном пакете услуг | НИОКР, XR, PR и оптимизация цифровой видимости — Изображение: Xpert.Digital

Xpert.Digital обладает глубокими знаниями различных отраслей. Это позволяет нам разрабатывать индивидуальные стратегии, которые точно соответствуют требованиям и задачам вашего конкретного сегмента рынка. Постоянно анализируя тенденции рынка и следя за развитием отрасли, мы можем действовать дальновидно и предлагать инновационные решения. Благодаря сочетанию опыта и знаний мы создаем добавленную стоимость и даем нашим клиентам решающее конкурентное преимущество.

Подробнее об этом здесь:

Качество данных и модели ИИ: невидимые препятствия современных технологий

Фундаментальные проблемы генеративного ИИ

Проблема галлюцинаций в моделях искусственного интеллекта

Одна из самых фундаментальных проблем систем искусственного интеллекта, также отмеченная в обзорах Bloomberg, — это проблема «галлюцинаций» — тенденция моделей ИИ генерировать правдоподобно звучащую, но фактически неверную информацию. Эта проблема возникает, когда системы ИИ создают контент, выходящий за рамки предоставленной им информации, или когда они неправильно интерпретируют данные. Такие галлюцинации особенно проблематичны в журналистике, где фактическая точность и достоверность имеют первостепенное значение.

Проблемы, с которыми столкнулся Bloomberg, — это именно такие галлюцинации: ИИ «выдумал» даты, например, дату введения Трампом пошлин на автомобили, или ложно заявил, что Трамп уже ввел пошлины на Канаду в 2024 году. Подобные ошибки подчеркивают ограничения современных технологий ИИ, особенно когда речь идет о точной интерпретации сложной информации.

Эксперты отмечают, что галлюцинации могут быть вызваны различными факторами, включая способ кодирования обучающих подсказок и текстов. Большие языковые модели (LLM) связывают понятия с рядом чисел, известных как векторные кодировки. Для неоднозначных слов, таких как «банк» (которое может относиться как к финансовому учреждению, так и к месту), может использоваться одна кодировка для каждого значения, чтобы избежать неоднозначности. Любая ошибка в кодировании и декодировании представлений и текстов может привести к галлюцинациям у генеративного ИИ.

Прозрачность и отслеживаемость решений, принимаемых с помощью ИИ

Еще одна фундаментальная проблема систем искусственного интеллекта — это отсутствие прозрачности и отслеживаемости в процессах принятия решений. В случае некоторых методов ИИ становится невозможно понять, как генерируется тот или иной прогноз или результат, или почему система ИИ пришла к конкретному ответу на заданный вопрос. Эта непрозрачность, часто называемая «проблемой черного ящика», затрудняет выявление и исправление ошибок до того, как они станут достоянием общественности.

Отслеживаемость особенно важна в таких областях, как журналистика, где решения о содержании должны быть прозрачными и обоснованными. Если Bloomberg и другие медиакомпании не смогут понять, почему их ИИ генерирует неверные резюме, им будет сложно внедрить системные улучшения. Вместо этого им придется полагаться на реактивные исправления после того, как ошибки уже произошли.

Эксперты из деловых кругов и академических кругов также признают эту проблему значительной. Хотя это в первую очередь техническая проблема, она может также привести к проблемам с социальной или правовой точки зрения в определенных областях применения. В случае с Bloomberg это может привести к потере доверия читателей или, в худшем случае, к принятию финансовых решений на основе неточной информации.

Зависимость от качества и объема данных

Кроме того, эффективность приложений на основе ИИ зависит от качества данных и алгоритмов. Учитывая объем и сложность используемых данных, систематические ошибки в данных или алгоритмах часто остаются незамеченными. Это еще одна фундаментальная проблема, которую Bloomberg и другие компании должны преодолеть при внедрении систем ИИ.

Проблема с объемом данных — ИИ может учитывать лишь относительно небольшие «контекстные окна» при обработке команд или запросов — значительно уменьшилась за последние годы, но остается сложной задачей. Модель ИИ от Google «Gemini 1.5 Pro 1M» уже способна обрабатывать запрос в 700 000 слов или час видео — более чем в семь раз больше, чем лучшая на данный момент модель GPT от OpenAI. Тем не менее, тесты показывают, что, хотя искусственный интеллект может осуществлять поиск в данных, ему сложно понимать взаимосвязи внутри них.

Подходит для:

- Снижение затрат и оптимизация эффективности являются доминирующими бизнес-принципами-риск и выбор правильной модели ИИ

Решения и перспективы развития

Контроль со стороны персонала и редакционные процессы

Одно из очевидных решений проблем, с которыми столкнулся Bloomberg, — усиление человеческого контроля над контентом, созданным с помощью ИИ. Bloomberg уже подчеркивал, что журналисты имеют полный контроль над тем, будет ли опубликован сгенерированный ИИ обзор. Однако этот контроль должен осуществляться эффективно, а это значит, что редакторы должны иметь достаточно времени для проверки обзоров, созданных ИИ, перед их публикацией.

Внедрение надежных редакционных процессов для проверки контента, созданного с помощью ИИ, имеет решающее значение для минимизации ошибок. Это может включать в себя требование, чтобы все резюме, созданные ИИ, проверялись как минимум одним редактором-человеком перед публикацией, или подвергать определенные типы информации (например, данные, рисунки или ссылки на источники) особенно тщательной проверке. Хотя такие процессы увеличивают рабочую нагрузку и, следовательно, снижают некоторые преимущества ИИ с точки зрения эффективности, они необходимы для поддержания точности и достоверности.

Технические усовершенствования моделей искусственного интеллекта

Постоянное технологическое развитие самих моделей ИИ — ещё один важный подход к решению современных проблем. Количество галлюцинаций уже значительно уменьшилось в модели GPT-4 по сравнению с её предшественницей, GPT-3.5. Новейшая модель Anthropic, «Claude 3 Opus», демонстрирует ещё меньше галлюцинаций в ходе первоначальных тестов. Вскоре частота ошибок речевых моделей должна стать ниже, чем у среднестатистического человека. Тем не менее, в отличие от того, к чему мы привыкли в компьютерах, речевые модели ИИ, вероятно, не будут полностью безошибочными в обозримом будущем.

Перспективным техническим подходом является «смешение экспертов»: несколько небольших специализированных моделей соединены с сетью вентилей. Входные данные системы анализируются вентилем, а затем, при необходимости, передаются одному или нескольким экспертам. Наконец, ответы объединяются в единый, исчерпывающий ответ. Это позволяет избежать необходимости всегда активировать всю модель во всей ее сложности. Такая архитектура потенциально может повысить точность за счет использования специализированных моделей для конкретных типов информации или областей.

Реалистичные ожидания и прозрачная коммуникация

Наконец, важно иметь реалистичные ожидания от систем ИИ и прозрачно сообщать об их возможностях и ограничениях. Современные системы ИИ разрабатываются специально для конкретного контекста применения и никоим образом не сравнимы с человеческим интеллектом. Это понимание должно определять внедрение ИИ в журналистику и другие области.

Bloomberg и другие медиакомпании должны прозрачно информировать о своем использовании ИИ и четко давать понять, что контент, созданный с помощью ИИ, может содержать ошибки. Этого можно достичь путем явной маркировки контента, созданного с помощью ИИ, прозрачных процессов исправления ошибок и открытого информирования об ограничениях используемой технологии. Такая прозрачность поможет сохранить доверие читателей, даже когда возникают ошибки.

Почему интеграция ИИ в журналистику терпит неудачу без участия человека

Опыт Bloomberg с использованием сводок, сгенерированных искусственным интеллектом, подчеркивает сложные проблемы интеграции ИИ в журналистику. По меньшей мере 36 ошибок, потребовавших исправления с января, демонстрируют, что, несмотря на свой потенциал, технология еще недостаточно зрела для надежного использования без тщательного контроля со стороны человека. Проблемы, с которыми сталкивается Bloomberg, не уникальны, но отражают фундаментальные проблемы ИИ, такие как иллюзии, отсутствие прозрачности и зависимость от высококачественных данных.

Успешная интеграция ИИ в журналистику требует нескольких подходов: надежных редакционных процессов для проверки контента, созданного ИИ, постоянного технического совершенствования самих моделей ИИ и прозрачного информирования о возможностях и ограничениях используемой технологии. Опыт Bloomberg может послужить ценным уроком для других медиакомпаний, планирующих аналогичные внедрения ИИ.

Будущее журналистики, основанной на искусственном интеллекте, зависит от того, насколько эффективно мы будем использовать преимущества ИИ и его инновационные возможности, не поступаясь при этом журналистскими стандартами. Ключ к успеху — сбалансированный подход, рассматривающий технологию как инструмент поддержки журналистов-людей, а не как замену им. Как метко заметил Джон Миклетвейт из Bloomberg: «Краткое изложение, сгенерированное ИИ, настолько же хорошо, насколько хороша история, на которой оно основано. А для таких историй люди по-прежнему важны»

Мы здесь для вас - советы - планирование - реализация - управление проектами

☑️ Поддержка МСП в разработке стратегии, консультировании, планировании и реализации.

☑️ Создание или корректировка цифровой стратегии и цифровизации.

☑️ Расширение и оптимизация процессов международных продаж.

☑️ Глобальные и цифровые торговые платформы B2B

☑️ Пионерское развитие бизнеса

Буду рад стать вашим личным консультантом.

Вы можете связаться со мной, заполнив контактную форму ниже, или просто позвонить мне по телефону +49 89 89 674 804 (Мюнхен) .

Я с нетерпением жду нашего совместного проекта.

Xpert.Digital - Konrad Wolfenstein

Xpert.Digital — это промышленный центр с упором на цифровизацию, машиностроение, логистику/внутреннюю логистику и фотоэлектрическую энергетику.

С помощью нашего решения для развития бизнеса на 360° мы поддерживаем известные компании, начиная с нового бизнеса и заканчивая послепродажным обслуживанием.

Аналитика рынка, маркетинг, автоматизация маркетинга, разработка контента, PR, почтовые кампании, персонализированные социальные сети и привлечение потенциальных клиентов являются частью наших цифровых инструментов.

Дополнительную информацию можно узнать на сайте: www.xpert.digital - www.xpert.solar - www.xpert.plus