Publié le: 21 juillet 2025 / mise à jour du: 21 juillet 2025 – Auteur: Konrad Wolfenstein

Un nouveau «moment Spoutnik»? Modèles AI: Kimi K3 arrivera-t-il bientôt? Pourquoi Kimi K2 élit-il l'industrie de l'IA? – Image: xpert.digital

Le Kimi Bang: Ce modèle d'IA en Chine est 10 fois moins cher que GPT-4 et tout aussi intelligent.

Percée de la Chine | AI au prix de combat: lorsque la technologie devient plus démocratique

Le monde de l'IA est sous le pouvoir et le déclencheur a un nom: Kimi K2. Développé par la startup de Pékin Moonshot AI, ce nouveau modèle de langue assure un véritable «kimi bang» dans l'industrie et est déjà traduit comme le «deuxième moment profondément» – événement qui réorganise l'équilibre des pouvoirs dans la compétition mondiale de l'IA. Mais qu'est-ce qui rend Kimi K2 si spécial? Il s'agit de la combinaison explosive de trois propriétés perturbatrices: l'ouverture radicale à travers une co-licence modifiée, une performance impressionnante qui tient des références avec des géants tels que le GPT-4 et un modèle de prix qui sape la compétition occidentale par taille.

La métaphore du "moment Sputnik" décrit le choc que les États-Unis ont connu en 1957 lorsque l'Union soviétique a tiré de façon inattendue le premier satellite – Spoutnik 1 – dans l'espace. Cet événement a soudainement fait conscience de l'Occident qu'elle avait été dépassée par un concurrent dans un domaine technologique décisif. Le résultat a été un appel national de sillage qui a conduit à des investissements massifs dans la science et l'éducation et a déclenché la "race dans l'espace".

Transféré à l'IA, le "Kimi Bang" signifie un réveil similaire pour le monde de la technologie occidentale: une entreprise chinoise a non seulement développé un modèle qui peut suivre les performances avec le GPT-4 leader, mais également le publier en tant que modèle open source et à une fraction des coûts. Cette percée technologique et économique remet en question la domination précédente des entreprises américaines telles que OpenAAI et signale le début d'une nouvelle phase de concurrence resserrée autour de la direction mondiale de l'IA.

Cette avancée prouve de manière impressionnante que les modèles d'IA ouverts et disponibles ne rattrape pas seulement technologiquement, mais aussi inaugurent une nouvelle ère en termes de rentabilité et d'accessibilité. Pour les start-ups, les chercheurs et les entreprises du monde entier, cela signifie une révolution des possibilités, tandis que des acteurs établis tels que OpenAai et Anthropic sont sous pression massive. Nous vous immergeons profondément dans l'architecture, les repères et les implications de grande envergure de Kimi K2 et analysons si ce «moment de Spoutnik de l'IA» de la Chine changera l'avenir de l'intelligence artificielle.

Kimi K2 combine trois propriétés perturbatrices:

- Ouverture – Moonshot AI publie des fichiers modèles sous une co-licence modifiée.

- Performance – Dans les repères comme MMLU-PRO, Kimi K2 dépasse les modèles de concurrents publics et obtient des résultats au niveau GPT-4.

- Coûts – L'API ne demande que 0,15 $ chaque 1 million de jetons d'entrée et 2,50 $ chacun de 1 million de jetons de production, ce qui signifie qu'il est moins cher que les modèles Western Top.

Convient à:

- Ki Model Kimi K2 de Moonshot AI: Le nouveau produit phare open source de Chine – une autre étape importante pour les systèmes d'IA ouverts

Qui développe Kimi K2 et que signifie le terme "Kimi Bang"?

Moonshot AI, fondée à Pékin en 2023, se concentre sur des modèles vocaux extrêmement grands et décrit chaque publication de grande version en interne comme "bang". La communauté a repris le terme lorsque Kimi K2 a pris d'assaut les listes de référence le 11 juillet 2025 et a mené les graphiques de téléchargement à des câlins en temps record.

Quel a été le premier "Moment Deepseek"?

L'expression décrit le choc lorsque Deepseek R1 a pour la première fois réalisé les performances de raisonnement des systèmes propriétaires en tant que modèle ouvert en janvier 2025. Les analystes ont comparé cette étape à un "moment Sputnik" pour l'open source de l'IA.

Convient à:

- Course cambriolage aux parts technologiques – Échanges AI depuis la Chine: Deepseek Shakes Global Ai Tech Giants aux États-Unis

Pourquoi parlez-vous d'un deuxième moment Deepsek?

Kimi K2 répète et renforce le récit: une startup chinoise publie un LLM téléchargeable librement qui peut non seulement suivre, mais également dominer dans les disciplines individuelles – mais cette fois avec l'architecture MOE, la mise au point des usages d'outils et encore une fois les coûts d'exploitation inférieurs.

Comment Kimi K2 est-elle construite?

- Architecture: Transformateur de mélange d'Experts avec 1 billion de paramètres totaux, 32 milliards par inférence sont activés.

- Fenêtre de contexte: jetons 128 K, optimisé par la station latente multi-tête (MLA).

- Optimiseur: MuONCLIP réduit les instabilités de formation et diminue les dépenses arithmétiques vers ADAMW.

- Vues de l'outil: le point de contrôle de l'instruct contient des schémas d'appels de fonction implémentés natifs.

De quel matériel a-t-il besoin d'un auto-hôte?

Sans quantification, les poids s'élèvent à ≈1 TB. Un thread dans le Subreddit / R / Localllama calcule une configuration de RAM CPU avec 1,152 Go DDR5 et un RTX 5090 pour moins de 10 000 $. Pour les latences productives, les GPU de lune avec Tensorrt-llm ou Vllm-Back-End recommandent.

Comment fait Kimi K2 dans les références de base?

Moonshot rapporte 87,8% sur MMLU, 92,1% sur GSM-8K et 26,3% de passage @ 1 sur Livecodebech. VentureBeat confirme 65,8% sur SWE-Bench vérifié, avec lequel Kimi K2 dépasse de nombreux systèmes propriétaires.

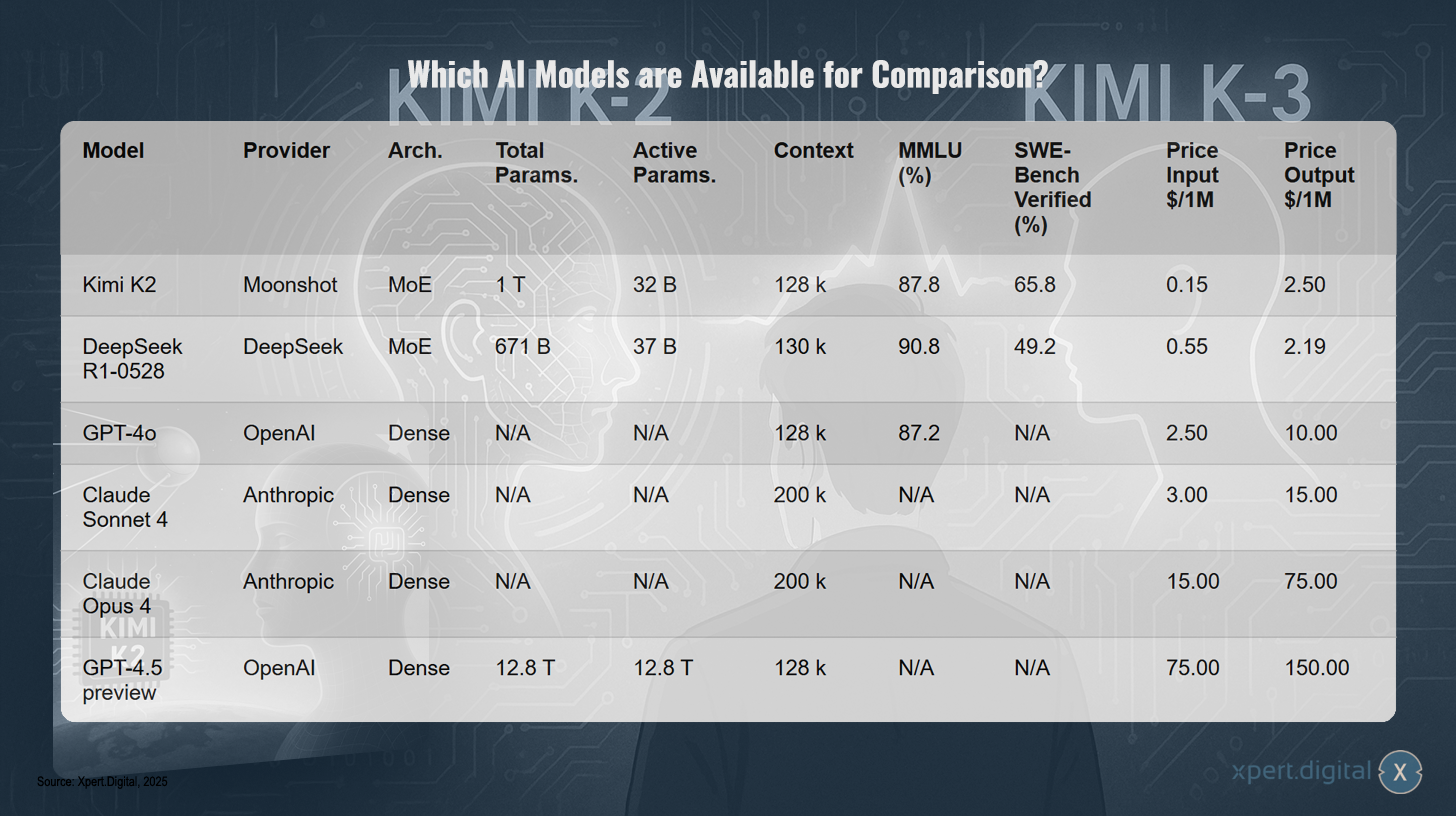

Quels modèles d'IA sont à titre de comparaison?

Dans le paysage actuel des modèles d'IA, il existe une variété impressionnante de systèmes caractérisés par différentes propriétés. L'aperçu comparatif montre des modèles de divers fournisseurs tels que Moonshot, Deepseek, OpenAai et Anthropic, chacun ayant leurs propres caractéristiques d'architecture et de performance.

Le modèle Kimi K2 de Moonshot est basé sur une architecture mixte (MOE) avec un total de 1 billion de paramètres, dont 32 milliards sont actifs. Il offre une portée de contexte de 128 000 caractères et obtient un remarquable 87,8% dans la référence MMLU et 65,8% dans la note vérifiée SWE-Bench. Les coûts sont de 0,15 $ par million de jetons d'entrée et de 2,50 $ par million de jetons de production.

Le modèle R1-0528 de Deepseek montre des caractéristiques similaires avec l'architecture MOE, 671 milliards de paramètres totaux et 37 milliards de paramètres actifs. Il dépasse Kimi K2 avec 90,8% au test MMLU, mais a un prix légèrement plus élevé de 0,55 $ par million de jetons d'entrée.

Les modèles d'OpenAai et d'Anthropic tels que GPT-4O, Claude Sonnet 4, Claude Opus 4 et l'aperçu GPT-4.5 diffèrent de leur architecture dense et parfois des numéros de paramètres non publiés. Les prix nettement plus élevés sont particulièrement frappants, en particulier pour le modèle d'aperçu GPT-4.5 avec 75 $ par million de jetons d'entrée et 150 $ par million de jetons de production.

Qu'est-ce qui est particulièrement visible dans la comparaison?

- Kimi K2 atteint des scores MMLU presque identiques tels que GPT-4O, mais n'a besoin que de paramètres actifs de 32 B par réponse.

- Deepseek R1 bat Kimi K2 sur MMLU, mais est plus faible dans les repères d'ingénierie logicielle.

- En termes de prix, Kimi K2 est un facteur de 10 sous GPT-4O et un facteur de 5 sous Claude Sonnet 4.

Dans quelle mesure la différence de prix est-elle radicale?

Les différences de prix entre les différents modèles d'IA sont remarquables et illustrent un changement dramatique dans le rapport coût-performance. Un échantillon de calcul pour 1 million de jetons montre les différences de prix significatives: tandis que des modèles tels que Kimi K2 et Deepseek R1 sont très bon marché autour de 2,65 à 2,74 $ par million de jetons, les prix du GPT-4O à 12,50 $ Sonnet 4 à 9,00 $ et Claude Opus. Le coût de GPT-4,5 à 112,50 $ par million de jetons est particulièrement frappant. Ce calcul souligne que le rapport coût-performance évolue de plus en plus de la Chine en faveur des modèles Open MOE (mélange d'experts), qui sont nettement moins chers que les modèles d'IA occidentaux établis.

Quel effet cela a-t-il sur les start-ups et la recherche?

Les prix des jetons favorables permettent des fenêtres de contexte plus longues et plus d'itérations par expérience, ce qui rend la recherche moins chère. Dans le même temps, les prix élevés occidentaux déplacent les utilisateurs à faible marge dans le sens de l'infrastructure Kimi K2, tels que Siliconflow ou Groq.

Que signifie le Kimi Bang pour la compétition transatlantique?

Selon les analystes de Golem, Moonshot AI OpenAai se révèle ouvertement et oblige les entreprises américaines à accélérer davantage les pas de prix. Les magazines d'experts comparent l'effet avec une "série Ki Spoutnik" après que Deepseek ait lancé le récit. Les investisseurs en Europe préviennent que l'inertie réglementaire conduit à une nouvelle émigration technologique.

Comment les leaders du marché réagissent-ils?

En avril 2025, OpenAai a annoncé son propre modèle de poids ouvert pour la première fois pour contrer l'impression open source. Anthropic offre désormais des remises de cache agressives allant jusqu'à 90%, mais reste derrière Kimi K2.

Pourquoi MuONCLIP est-il crucial?

Moonshot et UCLA montrent que MuONCLIP minimise les instabilités en milliards de dollars et récupère la consommation de mémoire d'ADAMW. Cela permet une formation de jetons de 15,5 billions sans interruption.

Quel rôle joue la conception du mélange de réductions?

MOE active un seul sous-ensemble d'experts spécialisés par jeton. Cela réduit le temps de calcul et la consommation d'électricité, tandis que le nombre total de paramètres reste élevé. GPT-4O et Claude, en revanche, utilisent des architectures denses et doivent calculer tous les poids des coûts.

Que comprend la co-licence modifiée?

Il permet une utilisation commerciale, de transmettre et de subliffer, mais oblige à se référer à la source et à la licence. Cela signifie que Kimi K2 peut être utilisé dans des environnements sur site, qui répond en particulier aux exigences européennes de protection des données.

Y a-t-il des côtés sombres?

Les chercheurs critiquent que Kimi K2 a sous-jacent des événements historiques dans l'histoire chinoise et a donc un biais. Il y a également peur que l'ouverture facilite les applications indésirables, comme la désinformation automatisée.

Intelligence agentique: Kimi K2 est-elle une étape vers des agents d'IA autonomes?

Oui. Moonshot a formé explicitement l'outil - Utilisation et l'appel de fonction, afin que Kimi K2 puisse orchestrer indépendamment. VentureBeat met l'accent sur les compétences d'agent en tant que argument de vente unique. Cela distingue Kimi K2 de Deepseek R1, qui révèle principalement le raisonnement, mais rend l'utilisation d'outils dépendante du cadre de l'agent.

Intégration dans les workflows: comment intégrer Kimi K2 dans les pipelines OpenAI existants?

Moonshot offre des points d'extrémité compatibles OpenAI, par lequel la température demandée est mise à l'échelle en interne à 0,6. Les développeurs n'ont qu'à échanger une URL de base et peuvent utiliser des outils tels que Langchain ou Llamaindex sans aucun changement.

Quelles sont les meilleures pratiques pour l'appel à outils?

- Fonctions remises en tant que schéma JSON.

- Maintenez la température de 0,6 pour forcer les appels d'outils déterministes.

- Vérifiez les résultats avec une invite de réflexion pour minimiser les hallucinations.

Quel fournisseur de cloud a hébergé Kimi K2?

Siliconflow, Fireworks AI et Groq offrent aux tourtereaux des paiements avec un débit jusqu'à 100 K TPM.

Comment l'Europe peut-elle se rattraper?

Les analystes nécessitent une «AI Gigafactory» basée sur le modèle américain pour former leurs propres modèles avec une alimentation électrique favorable. Jusque-là, l'Europe pouvait s'appuyer sur des modèles ouverts tels que Kimi K2 et se concentrer sur les Finetunes verticaux.

Quels champs spécifiques de l'application bénéficient d'abord?

- Assistance au code: Kimi-DEV-72B utilise des données Kimi-K2 et atteint 60,4% SWE-Bench.

- Analyse des documents: la fenêtre de contexte 128 K permet une longue opinion.

- Pipelines de données: une faible latence de 0,54 s premier jeton rend réaliste les chatbots en temps réel.

Quels sont les principaux risques?

- Biais et censure dans des sujets critiques.

- Écoulement des données via des API publiques.

- Les coûts matériels pour l'inférence sur site sont encore élevés malgré le MOE.

Kimi K2 fera-t-elle définitivement pression sur les prix occidentaux?

La pression des prix a déjà été utilisée: OpenAI a abaissé le GPT-4O trois fois en moins de douze mois. Claude a sape les tarifs antérieurs par des mécanismes de cache. Les analystes voient Kimi K2 comme un catalyseur pour une "course vers le bas" pour les prix des jetons, similaire à AWS a façonné le Cloud Market 2010.

Kimi K3 viendra-t-il bientôt?

Moonshot nomme des modèles mondiaux multimodaux et des architectures d'auto-amélioration comme les prochains jalons. Les fuites d'initiés parlent d'une fenêtre de contexte à des jetons 512 K et à l'optimisation de Pegasus. Cependant, la société ne commente pas officiellement une feuille de route.

Qu'est-ce qui reste du "Second Deepseek Moment"?

Kimi K2 prouve que les modèles ouverts peuvent non seulement suivre, mais également dominer en termes de prix. Le mouvement du pouvoir, conduit l'innovation et oblige tous les prestataires à faire plus de transparence. Pour les entreprises, une nouvelle base de coûts est créée, un riche champ de test pour les chercheurs et pour les régulateurs, la pression pour suivre la vitesse du développement ouvert.

Le Kimi Bang marque donc une gaine: ceux qui combinent l'ouverture et l'efficacité établiront à l'avenir les normes de l'économie de l'IA.

Convient à:

Votre transformation d'IA, l'intégration de l'IA et l'expert de l'industrie de la plate-forme d'IA

☑️ Notre langue commerciale est l'anglais ou l'allemand

☑️ NOUVEAU : Correspondance dans votre langue nationale !

Je serais heureux de vous servir, vous et mon équipe, en tant que conseiller personnel.

Vous pouvez me contacter en remplissant le formulaire de contact ou simplement m'appeler au +49 89 89 674 804 (Munich) . Mon adresse e-mail est : wolfenstein ∂ xpert.digital

J'attends avec impatience notre projet commun.