Visite guidée dans la transformation de l'IA: un rapport d'atelier pour les spécialistes et les gestionnaires

Version préliminaire d'Xpert

Sélection de voix 📢

Publié le: 10 mai 2025 / mise à jour de: 10 mai 2025 - Auteur: Konrad Wolfenstein

Visite guidée dans la transformation de l'IA: un rapport d'atelier pour les spécialistes et les gestionnaires-image: xpert.digital

Ce que les gestionnaires doivent maintenant savoir avec l'IA: profitez des opportunités, gérez les risques, dirigez-vous en toute confiance (temps de lecture: 32 min / pas de publicité / pas de mur payant)

Master la révolution de l'IA: une introduction aux gestionnaires

Repenser le pouvoir transformateur de l'IA: refonte le travail et la création de valeur

L'intelligence artificielle (IA) est considérée comme une technologie qui s'ouvre comme aucune autre nouvelle possibilité pour repenser fondamentalement le travail et la création de valeur. Pour les entreprises, l'intégration de l'IA est une étape cruciale pour rester réussie et compétitive à long terme car elle favorise l'innovation, augmente l'efficacité et augmente la qualité. Les effets économiques et sociaux de l'IA sont considérables; C'est l'un des futurs sujets numériques les plus importants, se développe rapidement et abrite un énorme potentiel. Les entreprises reconnaissent de plus en plus les avantages de l'automatisation et l'efficacité croissante de l'IA. Ce n'est pas seulement un changement technologique, mais un changement fondamental dans les modèles commerciaux, les optimisations de processus et les interactions client qui font une adaptation au besoin de survie dans la concurrence.

La «force transformatrice» très citée de l'IA va au-delà de la pure introduction de nouveaux outils; Cela implique un changement de paradigme dans la pensée stratégique. Les gestionnaires sont tenus de ré-évaluer les processus centraux, de promesses de valeurs et même de structures de l'industrie. Si vous ne considérez que l'IA comme un outil d'efficacité, vous courez le risque de négliger votre potentiel stratégique plus profond. Le développement rapide de l'IA répond à une pénurie existante de travailleurs qualifiés. Cela crée un double défi: d'une part, il y a un besoin urgent d'une qualification rapide pour pouvoir utiliser l'IA. D'un autre côté, KI offre la possibilité d'automatiser les tâches et de soulager donc potentiellement la pénurie de travailleurs qualifiés dans certains domaines, tandis que de nouvelles exigences de qualification surviennent en même temps. Cela nécessite une planification du personnel nuancé de la part des gestionnaires.

Convient à:

- L'intelligence artificielle comme moteur de business dans l'entreprise - autres conseils pratiques pour l'introduction de l'IA dans les entreprises de onze managers de transition

Passer des opportunités et risques à l'ère de l'IA

Bien que les systèmes d'IA offrent des opportunités très efficaces, elles sont inextricablement liées aux risques qui doivent être gérés. Le discours autour de l'IA comprend la prise en compte de votre potentiel important contre les disques inhérents, ce qui nécessite une approche équilibrée pour utiliser les avantages et minimiser les inconvénients. Les entreprises sont confrontées au défi de promouvoir les innovations et, en même temps, se conforment aux directives de protection des données et d'éthique, ce qui rend l'équilibre entre le progrès et la conformité décisive.

Cet acte d'équilibrage n'est pas une décision unique, mais un besoin stratégique continu. Avec le développement ultérieur des technologies d'IA, pour l'exemple de l'IA spécialisée vers des compétences plus générales, le type d'opportunités et de risques changera également. Cela nécessite une réévaluation continue et une adaptation de la gouvernance et de la stratégie. La perception des risques et des avantages de l'IA peut varier considérablement au sein d'une organisation. Par exemple, les utilisateurs d'IA actifs ont tendance à être plus optimistes que ceux qui n'ont pas encore introduit l'IA. Cela illustre un défi essentiel dans la gestion du changement pour les gestionnaires: cette lacune dans la perception doit être conclue par l'éducation, une communication claire et la démonstration des avantages tangibles avec une résolution simultanée des préoccupations.

Comprendre le paysage de l'IA: concepts et technologies de base

Ki génératif (Genai) et la voie à l'intelligence générale artificielle (AGI)

Ki génératif (Genai)

Generative Ki (Genai) désigne des modèles d'IA qui sont conçus pour créer un nouveau contenu sous la forme de texte écrit, d'audio, d'images ou de vidéos et d'offrir une large gamme d'applications. Genai prend en charge les utilisateurs dans la création de contenu unique et significatif et peut agir comme un système de questions-réponses intelligent ou un assistant personnel. Genai révolutionne déjà la création de contenu, de marketing et de fidélité des clients en permet à la production rapide de matériaux personnalisés et à l'automatisation des réponses.

L'accessibilité immédiate et le large éventail d'applications de Genai signifient qu'il représente souvent «l'IA d'entrée de gamme» pour de nombreuses organisations. Cette première touche façonne la perception et peut conduire ou entraver l'adaptation AI plus large. Les managers doivent contrôler soigneusement ces premières expériences afin de créer une dynamique positive.

Intelligence générale artificielle (AGI)

L'intelligence générale artificielle (AGI) fait référence à l'intelligence hypothétique d'une machine capable de comprendre ou d'apprendre une tâche intellectuelle qu'une personne peut gérer et ainsi imite les compétences cognitives humaines. Il s'agit de systèmes d'IA qui peuvent effectuer un large éventail de tâches au lieu d'être spécialisés dans Spécialisé.

Le vrai AGI n'existe actuellement pas; Il reste un concept et un objectif de recherche. Openai, une entreprise de premier plan dans ce domaine, définit AGI comme "des systèmes élevés-autonomes que les gens dépassent dans le travail le plus précieux économiquement". D'ici 2023, seuls le premier des cinq niveaux de hausse de l'AGI, qui est appelé «IA émergeant», ont été atteints.

L'ambiguïté et les différentes définitions de l'AGI suggèrent que les gestionnaires AGI devraient considérer un horizon à long terme et potentiellement transformateur que comme une préoccupation opérationnelle immédiate. L'accent devrait être mis sur l'utilisation de «l'IA puissante actuelle» et en même temps d'observer stratégiquement les progrès de l'AGI. Les investissements dans les scénarios AGI spéculatifs pourraient distraire les ressources des opportunités plus immédiates de l'IA. Le développement d'une IA spécialisée via le Genai vers des recherches en cours sur l'AGI implique un niveau croissant d'autonomie et de performance des systèmes d'IA. Cette tendance est directement en corrélation avec un besoin croissant de conditions éthiques solides et de gouvernance, car une IA plus puissante comporte un plus grand potentiel d'abus ou de conséquences involontaires.

Convient à:

Assistant AI vs Agent AI: Définir les rôles et les compétences

Les assistants de l'IA soutiennent les personnes dans des tâches individuelles, réagissent aux demandes de renseignements, répondent aux questions et donnent des suggestions. Ils sont généralement réactifs et attendent les commandes humaines. Les premiers assistants étaient régulièrement basés, mais les modernes reposent sur l'apprentissage automatique (ML) ou les modèles de fondation. En revanche, les agents de l'IA sont plus autonomes et capables de poursuivre des objectifs et de prendre des décisions indépendamment avec une intervention humaine minimale. Ils sont proactifs, peuvent interagir avec leur environnement et les adapter en apprenant.

Les principales différences résident dans l'autonomie, la complexité des tâches, l'interaction des utilisateurs et les compétences de décision. Les assistants fournissent des informations sur les décisions humaines, tandis que les agents peuvent prendre et prendre des décisions. Dans le domaine de l'application, les assistants améliorent l'expérience client, prennent en charge les tâches RH dans les demandes bancaires et optimisent. Les agents, en revanche, peuvent s'adapter au comportement des utilisateurs en temps réel, prévenir de manière proactive la fraude et automatiser les processus RH complexes tels que le talenta plancial.

La transition des assistants d'IA aux agents de l'IA signale un développement de l'IA en tant que "outil" à l'IA en tant que "collaborateur" ou même en "employé autonome". Cela a des effets profonds sur la conception du travail, les structures d'équipe et les compétences nécessaires des employés humains qui doivent de plus en plus gérer et travailler avec eux. Étant donné que les agents de l'IA deviennent de plus en plus courants et sont capables de prendre des décisions indépendantes, «l'écart de responsabilité» devient un problème plus urgent. Si un agent d'IA prend une décision incorrecte, l'allocation de responsabilité devient complexe. Cela souligne la nécessité critique d'un gouvernement d'IA robuste qui relève les défis uniques des systèmes autonomes.

Vous trouverez ci-dessous une comparaison des caractéristiques distinctives les plus importantes:

Comparaison des assistants de l'IA et des agents d'IA

Ce tableau offre aux gestionnaires une compréhension claire des différences fondamentales afin de sélectionner la bonne technologie pour des besoins spécifiques et d'anticiper les différents degrés de supervision et de complexité d'intégration.

La comparaison entre les assistants de l'IA et les agents de l'IA montre des différences significatives dans leurs caractéristiques. Alors que les assistants de l'IA sont plutôt réactifs et attendent des commandes humaines, les agents de l'IA agissent proactifs et de manière autonome en agissant indépendamment. La fonction principale d'un assistant d'IA réside dans l'exécution des tâches sur demande, tandis qu'un agent d'IA vise à atteindre l'objectif. Les assistants de l'IA soutiennent les personnes dans la prise de décision, tandis que les agents de l'IA prennent et mettent en œuvre les décisions indépendamment. Le comportement d'apprentissage des deux diffère également: l'assistant AI apprend principalement limité et basé sur des versions, tandis que les agents de l'IA sont adaptatifs et apprennent continuellement. Les principales applications des assistants d'IA comprennent les chatbots et l'appel d'information, mais les domaines d'application des agents d'IA comprennent l'automatisation des processus, la détection de fraude et la solution de problèmes complexes. L'interaction avec les personnes nécessite une contribution constante pour l'assistant d'IA, tandis qu'une seule intervention humaine minimale est nécessaire pour les agents de l'IA.

La salle des machines: apprentissage automatique, grands modèles vocaux (LLM) et modèles de base

Apprentissage automatique (ML)

L'apprentissage automatique est une sous-zone de l'IA dans laquelle les ordinateurs apprennent des données et s'améliorent avec l'expérience sans être explicitement programmé. Les algorithmes sont formés pour trouver des modèles dans de grands ensembles de données et pour prendre des décisions et des prédictions en fonction de cela. Les modèles ML incluent l'apprentissage surveillé (apprentissage à partir de données marquées), l'apprentissage insurmontable (trouver des modèles dans des données non marquées), l'apprentissage partiellement surveillé (mélange de données marquées et non marquées) et le renforcement de l'apprentissage (apprentissage par des expériences avec des récompenses). La ML augmente l'efficacité, minimise les erreurs et soutient la prise de décision dans les entreprises.

Comprendre les différents types d'apprentissage automatique est non seulement important pour les gestionnaires d'un point de vue technique, mais aussi pour comprendre les exigences de données. L'apprentissage surveillé, par exemple, nécessite de grandes quantités d'enregistrements de données marqués à haute qualité, ce qui a un impact sur la stratégie de données et les investissements. Bien que l'identification des problèmes commerciaux soit au début, l'applicabilité d'un certain type de ML dépendra fortement de la disponibilité et du type de données.

Grands modèles vocaux (LLMS)

Les grands modèles vocaux sont une sorte d'algorithme d'apprentissage en profondeur formé dans d'énormes enregistrements de données et sont souvent utilisés dans les applications du traitement du langage naturel (PNL) pour répondre aux demandes de renseignements en langage naturel. Les exemples de cela sont la série GPT d'Openai. Les LLM peuvent générer des textes humains, des chatbots de conduite et prendre en charge le service client automatisé. Cependant, vous pouvez également reprendre des inexactitudes et des distorsions des données de formation et soulever des préoccupations concernant le droit d'auteur et la sécurité.

Le problème de la «mémorisation» chez LLMS, dans lequel vous éteignez littéralement le texte des données de formation, abrite des risques considérables en matière de droit d'auteur et de plagiat pour les entreprises qui utilisent du contenu généré par LLM. Cela nécessite des processus d'examen minutieux et une compréhension de l'origine des éditions LLM.

Modèles de base

Les modèles de base sont de grands modèles d'IA qui ont été formés sur de larges données et peuvent être adaptés (affinés) pour une variété de tâches en aval. Ils se caractérisent par l'émergence (compétences inattendues) et l'homogénéisation (architecture conjointe). Ils diffèrent des modèles d'IA classiques en ce qu'ils sont initialement spécifiques au pays, utilisent l'apprentissage auto-surmonté, permettent un apprentissage du transfert et sont souvent multimodaux (traitement du texte, image, audio). Les LLM sont une sorte de modèle de base. Les avantages incluent l'accès et l'évolutivité du marché plus rapides, mais les défis sont la transparence (problème de "boîte noire"), la protection des données et les coûts élevés ou les exigences d'infrastructure.

L'essor des modèles de base signale un changement vers une IA plus polyvalente et plus adaptable. Cependant, votre nature "Black Box" et les ressources considérables nécessaires à votre formation ou à un réglage fin signifient que l'accès et le contrôle pourraient être concentrés, ce qui crée des dépendances potentiellement sur quelques grands fournisseurs. Cela a des effets stratégiques sur les décisions de «make or-buy» et le risque de verrouillage des fournisseurs. La capacité multimodale de nombreux modèles de base ouvre de nouvelles catégories d'applications qui peuvent synthétiser les résultats de différents types de données (par exemple, l'analyse des rapports de texte ainsi que les enregistrements de caméras de surveillance). Cela va au-delà de ce que les LLMS axés sur le texte peuvent faire et nécessitent une réflexion plus large sur leurs bases de données disponibles.

La boussole réglementaire: navigation à travers des conditions de cadre juridique et éthique

La loi UE KI: dispositions et effets de base pour les entreprises

La loi UE KI, qui est entrée en vigueur le 1er août 2024, est la première loi complète dans l'IA du monde et établit un système de classification basé sur les risques pour l'IA.

Catégories de risques:

- Risque inacceptable: les systèmes d'IA qui représentent une menace claire pour la sécurité, les moyens de subsistance et les droits sont interdits. Des exemples de cela sont la notation sociale par les autorités publiques, la manipulation cognitive du comportement et la lecture non sollicitée des images du visage. La plupart de ces interdictions entrent en vigueur jusqu'au 2 février 2025.

- Risque élevé: systèmes d'IA qui affectent négativement la sécurité ou les droits fondamentaux. Ceux-ci sont soumis à des exigences strictes, notamment les systèmes de gestion des risques, la gouvernance des données, la documentation technique, la supervision humaine et les évaluations de conformité avant le marché. Les exemples sont l'IA dans les infrastructures critiques, les dispositifs médicaux, l'emploi et l'application de la loi. La plupart des règles pour l'IA à haut risque s'appliquent à partir du 2 août 2026.

- Risque limité: les systèmes d'IA tels que les chatbots ou ceux qui génèrent des articles profonds doivent respecter les obligations de transparence et informer les utilisateurs qu'ils interagissent avec l'IA ou que le contenu est généré par l'IA.

- Risque minimal: les systèmes d'IA tels que les filtres à spam ou les jeux vidéo basés sur l'IA. La loi permet une utilisation gratuite, bien que les compétences comportementales volontaires soient encouragées.

Convient à:

- Les systèmes d'IA, les systèmes à haut risque et la loi sur l'IA pour la pratique dans les entreprises et les autorités

La loi détermine les obligations pour les prestataires, les importateurs, les commerçants et les utilisateurs (opérateurs) des systèmes d'IA, par lesquels les prestataires de systèmes à haut risque sont soumis aux exigences les plus strictes. En raison de l'application extraterritoriale, elle affecte également les entreprises en dehors de l'UE si leurs systèmes d'IA sont utilisés sur le marché de l'UE. Des règles spécifiques s'appliquent aux modèles d'IA à des fins générales (modèles GPAI), avec des obligations supplémentaires pour ceux qui sont classés comme «risque systémique». Ces règles s'appliquent généralement à partir du 2 août 2025. Si non-compliance, il y a des amendes considérables, jusqu'à 35 millions d'euros ou 7% du chiffre d'affaires annuel mondial pour les demandes interdites. À partir de février 2025, l'article 4 prescrit également un niveau adéquat de compétence en IA pour le personnel des prestataires et des opérateurs de certains systèmes d'IA.

L'approche basée sur les risques de la loi sur l'IA de l'UE nécessite un changement fondamental dans l'approche des entreprises au développement et à l'utilisation de l'IA. Il ne s'agit plus seulement de faisabilité technique ou de valeur commerciale; La conformité réglementaire et la réduction des risques doivent être intégrées dès le début du cycle de vie de l'IA («Conformité par conception»). L '«obligation de compétence en IA» est une détermination importante et précoce. Cela implique un besoin immédiat pour les entreprises d'évaluer et de mettre en œuvre des programmes de formation, non seulement pour les équipes techniques, mais pour toute personne qui développe, utilise ou surveille les systèmes d'IA. Cela va au-delà de la conscience fondamentale et comprend la compréhension des fonctionnalités, des limites ainsi que du cadre éthique et juridique. L'objectif de la loi sur les modèles GPAI, en particulier ceux à risque systémique, indique une préoccupation réglementaire concernant les effets larges et potentiellement imprévus de ces modèles puissants et variés. Les entreprises qui utilisent ou développent de tels modèles sont soumises à un examen et à des obligations intensifiés, qui influencent leurs plans de développement et leurs stratégies d'introduction de marché.

Aperçu des catégories de risques de la loi UE KI et des obligations essentielles

Aperçu des catégories de risques de la loi de l'UE KI et des obligations essentielles-image: xpert.digital

Ce tableau résume la structure centrale de la loi UE KI et aide les gestionnaires à reconnaître rapidement quelle catégorie leurs systèmes d'IA pourraient tomber et à comprendre la charge et les horaires de conformité correspondants.

Un aperçu des catégories de risques de la loi UE KI montre que les systèmes présentant un risque inacceptable, tels que la notation sociale, la manipulation cognitive et le grattage non réapprovisié des images faciales, sont entièrement interdits et peuvent ne plus être appliqués à partir du 20 février. obligations. Entre autres choses, les prestataires et les opérateurs doivent avoir un système de gestion des risques, une gestion de la qualité des données et une documentation technique, assurer la transparence, assurer la supervision humaine et répondre aux critères tels que la robustesse, la précision, la cybersécurité et l'évaluation de la conformité. Les mesures correspondantes entrent en vigueur à partir d'août 2026, en partie à partir d'août 2027. Présentant le risque limité Les applications d'IA telles que les chatbots, les systèmes de détection d'émotion, les systèmes de catégorisation biométrique et plus profondément. Les obligations de transparence, telles que l'étiquetage en tant que système d'IA ou contenu généré par l'IA, sont également considérées comme efficaces à partir d'août 2026. Il n'y a aucune obligation spécifique pour les applications d'IA avec un risque minimal, telles que les filtres à spam ou les jeux vidéo soutenus par l'IA, avec des kodices comportementaux volontaires recommandés. Ces systèmes peuvent être utilisés immédiatement.

Le champ de tension du calcul de l'innovation obligation: trouver le bon équilibre

Les entreprises doivent maîtriser le domaine de tension entre la promotion de l'innovation de l'IA et la garantie de responsabilité, de protection des données (RGPD) et d'utilisation éthique. Les principes du RGPD (légalité, équité, transparence, liaison à des fins de but, minimisation des données, exactitude, responsabilité) sont fondamentaux de l'IA responsable et influencent la façon dont les systèmes d'IA sont développés et utilisés. Les stratégies d'équilibre comprennent l'intégration précoce des équipes de conformité et de protection des données, les audits réguliers, l'utilisation de l'expertise externe et l'utilisation d'outils de conformité spécialisés. Certains ne considèrent pas les directives réglementaires comme des freins d'innovation, mais comme un accélérateur qui renforcent la confiance et augmentent l'acceptation des nouvelles technologies.

Le «champ de tension de l'innovation obligation obligatoire» n'est pas un compromis statique, mais un équilibre dynamique. Les entreprises qui intégrent de manière proactive la responsabilité et les considérations éthiques dans leur cycle d'innovation d'IA sont plus susceptibles de créer des solutions d'IA durables et dignes de confiance. Cela favorise finalement les innovations majeures en évitant la modernisation coûteuse, les dommages à la réputation ou les sanctions réglementaires. Le défi du maintien d'une responsabilité est renforcé par la complexité croissante et la nature potentielle de "boîte noire" des modèles AI avancés (comme discuté dans les modèles de base). Cela nécessite une concentration plus forte sur les techniques d'explicabilité (XAI) et des mécanismes d'audit robustes pour garantir que les décisions prises par l'IA peuvent être comprises, justifiées et contestées si nécessaire.

🎯📊 Intégration d'une plate-forme d'IA à la source indépendante et croisée à l'échelle de la source 🤖🌐 pour toutes les questions de l'entreprise

Intégration d'une plate-forme d'IA indépendante et transversale à l'échelle de la source pour toutes les questions de l'entreprise: Xpert.Digital

KI-GAMECHANGER: Les solutions de fabrication de plate-forme d'IA les plus flexibles qui réduisent les coûts, améliorent leurs décisions et augmentent l'efficacité

Plateforme d'IA indépendante: intègre toutes les sources de données de l'entreprise pertinentes

- Cette plate-forme AI interagit avec toutes les sources de données spécifiques

- De SAP, Microsoft, Jira, Confluence, Salesforce, Zoom, Dropbox et de nombreux autres systèmes de gestion des données

- Intégration rapide de l'IA: solutions d'IA sur mesure pour les entreprises en heures ou jours au lieu de mois

- Infrastructure flexible: cloud ou hébergement dans votre propre centre de données (Allemagne, Europe, libre choix de l'emplacement)

- La sécurité des données la plus élevée: l'utilisation dans les cabinets d'avocats est la preuve sûre

- Utiliser sur une grande variété de sources de données de l'entreprise

- Choix de vos propres modèles d'IA (DE, DE, UE, USA, CN)

Défis que notre plateforme d'IA résout

- Un manque de précision des solutions d'IA conventionnelles

- Protection des données et gestion sécurisée des données sensibles

- Coûts élevés et complexité du développement individuel d'IA

- Manque d'IA qualifiée

- Intégration de l'IA dans les systèmes informatiques existants

En savoir plus ici :

Stratégies de l'IA pour les gestionnaires: directives pratiques et exemples

IA en action: applications, applications et interaction efficace

Reconnaître les opportunités: applications et applications de l'IA dans toutes les industries

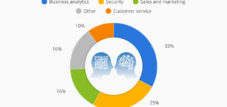

KI propose un large éventail d'applications, notamment la création de contenu, l'approche client personnalisée, l'optimisation des processus dans la production et la logistique, la maintenance à l'avant ainsi que le soutien en finance, en ressources humaines et en informatique.

Des exemples spécifiques de l'industrie comprennent:

- Automobile / production: IA et simulation dans la recherche (Arena2036), interaction automatisée du robot (FESTO), optimisation des processus et maintenance prédictive dans la production (BOSCH).

- Services financiers: garantie accrue en analysant de grandes quantités de données sur les transactions suspectes, une facture automatisée, une analyse des investissements.

- Santé: diagnostics plus rapides, accès prolongé aux soins (par exemple, interprétation des images médicales), optimisation de la recherche pharmaceutique.

- Télécommunications: optimisation des performances du réseau, améliorations audiovisuelles, prévention de la migration des clients.

- Retail / E-commerce: recommandations personnalisées, chatbots pour le service client, processus de caissier automatisés.

- Marketing et ventes: Création de contenu (Chatgpt, Canva), campagnes optimisées, segmentation de la clientèle, prévisions de ventes.

Alors que de nombreuses applications visent l'automatisation et l'efficacité, une tendance émergente importante est le rôle de l'IA lors de l'amélioration de la prise de décision humaine et de l'activation de nouvelles formes d'innovation (par exemple, le développement de médicaments; développement de produits). Les managers doivent regarder au-delà des réductions de coûts afin d'identifier les options de croissance et d'innovation axées sur l'IA. Les implémentations d'IA les plus réussies comprennent souvent l'intégration de l'IA dans les processus et les systèmes de base existants (par exemple SAP, SAP utilise KI dans les logiciels d'entreprise, Microsoft 365 Copilot) au lieu de traiter l'IA comme une technologie indépendante et isolée. Cela nécessite une vision holistique de l'architecture de l'entreprise.

Convient à:

- Intelligence artificielle: cinq stratégies clés pour l'intégration de la transformation de l'IA sans succès pour la gestion durable des entreprises

Master le dialogue: incitation efficace pour l'IA générative

L'ingénierie rapide est un processus itératif et contrôlé par test pour améliorer la sortie du modèle qui nécessite des buts clairs et des tests systématiques. Les invites efficaces dépendent à la fois du contenu (instructions, exemples, contexte) et de la structure (ordre, étiquetage, séparateur).

Les composantes importantes d'une invite sont les suivantes: objectif / mission, instructions, restrictions (que faire / faire), son / style, les données de contexte / arrière-plan, des exemples à quelques tirs, la demande de justification (chaîne de choses) et le format de réponse souhaité.

Les meilleures pratiques comprennent:

- Fixez des objectifs clairs et utilisez des verbes d'action.

- Fournir un contexte et des informations générales.

- Définissez exactement le groupe cible.

- L'IA dit ce qu'elle ne devrait pas faire.

- Formuler une invite, concise, concise et avec un choix précis de mots.

- Ajoutez des bordures de sortie, en particulier pour l'écriture de tâches.

- Attribuez un rôle (par exemple, "vous êtes un tuteur en mathématiques").

- Chaîne rapide (utilisation d'une invite interconnectée) peut générer des idées continues.

Une incitation efficace est moins la recherche d'une seule "invite parfaite" que le développement d'une approche stratégique pour l'interaction avec les LLM. Cela comprend la compréhension des compétences du modèle, le raffinement itératif d'invites basées sur la sortie et l'utilisation de techniques telles que l'allocation de rôles et la chaîne de choses afin de mener l'IA aux résultats souhaités. C'est une capacité qui nécessite de l'exercice et de la pensée critique. La capacité de fournir un contexte pertinent et de définir des restrictions est de la plus haute importance pour obtenir des résultats précieux de Genai. Cela signifie que la qualité du contenu généré par l'IA est souvent directement proportionnelle à la qualité et à la spécificité de l'apport humain, ce qui souligne l'importance persistante de l'expertise humaine dans le processus.

Meilleures pratiques pour créer des invites d'IA efficaces

Ce tableau offre des conseils pratiques et impliquant que les gestionnaires et les spécialistes peuvent appliquer immédiatement pour améliorer leurs interactions avec des outils d'IA génératifs.

Afin d'obtenir des résultats précieux dans l'utilisation de l'IA générative, il est crucial de s'attaquer spécifiquement et clairement à définir avec précision l'objectif et à utiliser des verbes d'action, tels que "créer une liste de points clés qui résume les résultats les plus importants du document". Il est tout aussi important de fournir le contexte, par exemple par la livraison d'informations de base et de données pertinentes telles que "sur la base du rapport financier, analyser la rentabilité des cinq dernières années". Le groupe cible et le son souhaité devraient être clairement articulés, tels que "Rédiger une description de produit pour les jeunes adultes qui apprécient la durabilité". L'IA peut également se voir attribuer un rôle ou un personnage spécifique, par exemple "vous êtes un expert en marketing. Désor d'une campagne pour ...". À l'aide d'exemples à quelques coups, tels que «Entrée: Apple. Sortie: Fruit. Entrée: Carrow. Sortie:», Le format de sortie souhaité peut être mieux illustré. La mise en forme exacte des réponses est également judicieuse pour définir comment "Formater votre réponse dans Markdown". Des restrictions telles que "Évitez le jargon technique. La réponse ne devrait plus dépasser 200 mots" pour optimiser la sortie. L'approche itérative, dans laquelle l'invite est adaptée et raffinée en fonction des résultats précédents, augmente encore la qualité. Enfin, la chaîne peut être utilisée par les pensées (chaîne de choses) en demandant à l'IA d'expliquer son processus de réflexion étape par étape, tel que "expliquer votre argument étape par étape".

Aborder l'invisible AI: Comprendre et gérer les applications d'ombre (Shadow AI)

Schadten-Ki désigne l'utilisation non autorisée ou non réglementée d'outils d'IA par les employés, souvent pour augmenter la productivité ou pour éviter les processus officiels lents. C'est une sous-catégorie de l'ombre.

Risques de l'ombre ki:

- Sécurité des données et protection des données: les outils non autorisés peuvent entraîner des violations de la protection des données, la divulgation de données publiques / d'entreprise sensibles et la non-compliance avec le RGPD / HIPAA.

- Conformité et loi: violations des lois sur la protection des données, problèmes de droit d'auteur, conflit avec la liberté d'information. La demande de la "compétence d'IA" de la loi UE KI à partir de février 2025 fait de toute urgence l'argument.

- Économiquement / opérationnel: structures parallèles inefficaces, coûts cachés grâce aux abonnements individuels, manque de contrôle sur les licences, incompatibilité avec les systèmes existants, perturbation des processus de travail, réduction de l'efficacité.

- Qualité et contrôle: manque de transparence dans le traitement des données, potentiel de résultats biaisés ou trompeuses, érosion de la confiance publique / interne.

- Présentation de la gouvernance: contournement du gouvernement informatique, ce qui rend difficile l'application des directives de sécurité.

Stratégies pour la gestion de Schadten-Ki:

- Développement d'une stratégie d'IA claire et établissement d'une directive d'IA responsable.

- Provision d'outils officiels et approuvés comme alternatives.

- Définition des directives claires pour l'utilisation de l'IA, le traitement des données et les outils approuvés.

- Formation et sensibilisation des employés pour l'utilisation responsable de l'IA, les risques et les meilleures pratiques.

- Mise en œuvre des audits réguliers pour découvrir une IA non autorisée et assurer la conformité.

- Acceptation d'une approche incrémentielle du gouvernement de l'IA, en commençant par de petites étapes et au raffinement des directives.

- Promotion de la coopération croisée et de l'engagement des employés.

Schadten-KI est souvent un symptôme pour les besoins des utilisateurs non satisfaits ou les processus bureaucratiques excessifs dans l'introduction de la technologie. Une approche purement restrictive («interdire l'IA») peut se retourner contre lui. Une gestion efficace nécessite de comprendre les causes et de fournir des alternatives pratiques et sûres en plus d'une gouvernance claire. La montée des outils Genai facilement accessibles (comme Chatgpt) a probablement accéléré la propagation de Schatten-Ki. Les employés peuvent rapidement utiliser ces outils sans participation informatique. Cela rend la formation proactive aux compétences en IA (comme l'exige la loi UE KI) et une communication claire via des outils approuvés encore plus importants.

Risques de l'ombre AI et des réactions stratégiques

Ce tableau offre un aperçu structuré des diverses menaces de l'utilisation non réglementée de l'IA et des stratégies de béton, implémentables pour les gestionnaires.

L'IA de l'ombre comporte de nombreux risques auxquels les entreprises doivent rencontrer stratégiquement. Des fuites de données, un accès non autorisé à des informations sensibles ou à des infections de logiciels malveillants peuvent se produire dans le domaine de la sécurité des données. Les mesures stratégiques comprennent l'introduction d'une directive d'utilisation de l'IA, la création d'une liste d'outils approuvés, l'utilisation du chiffrement, la mise en œuvre de contrôles d'accès stricts et la formation des employés. En ce qui concerne les risques de conformité, tels que les violations du RGPD, les violations des réglementations de l'industrie ou la violation du droit d'auteur, les audits réguliers, les séquences de protection des données basées sur les données (DSFA) pour les nouveaux outils, les directives clairement définies pour le traitement des données et, si nécessaire, les conseils juridiques sont essentiels. Les risques financiers découlent de dépenses incontrôlées pour les abonnements, les licences redondantes ou les inefficacités. Par conséquent, les entreprises devraient s'appuyer sur des achats centralisés, un contrôle budgétaire strict et l'examen régulier de l'utilisation des outils. Les défis opératoires tels que les résultats incohérents, l'incompatibilité avec les systèmes d'entreprise existants ou les troubles du processus peuvent être maîtrisés en fournissant des outils standardisés, leur intégration dans les flux de travail existants et par des contrôles de qualité continus. Enfin, les risques de réputation sont un danger, par exemple la perte de confiance des clients en raison de ruptures de données ou d'une communication générée par l'IA incorrecte. La communication transparente, la conformité aux directives éthiques et un plan de réponse aux incidents bien pensé sont des mesures cruciales pour maintenir la confiance dans l'entreprise et minimiser les dommages possibles.

🎯🎯🎯 Bénéficiez de la quintuple expertise étendue de Xpert.Digital dans une offre de services complète | R&D, XR, RP et SEM

Machine de rendu 3D AI & XR : une expertise quintuplée de Xpert.Digital dans un ensemble complet de services, R&D XR, PR & SEM - Image : Xpert.Digital

Xpert.Digital possède une connaissance approfondie de diverses industries. Cela nous permet de développer des stratégies sur mesure, adaptées précisément aux exigences et aux défis de votre segment de marché spécifique. En analysant continuellement les tendances du marché et en suivant les évolutions du secteur, nous pouvons agir avec clairvoyance et proposer des solutions innovantes. En combinant expérience et connaissances, nous générons de la valeur ajoutée et donnons à nos clients un avantage concurrentiel décisif.

En savoir plus ici :

Comment transformer le leadership et la coopération et renforcer les compétences générales en leadership: l'avantage humain à l'ère de l'IA

Comment transformer le leadership et la coopération et renforcer les compétences générales en leadership: l'avantage humain dans l'image d'âge de l'IA: Xpert.Digital

L'élément humain: effets de l'IA sur le leadership, la collaboration et la créativité

Changement de leadership à l'ère de l'IA: nouvelles exigences et compétences

L'IA nécessite un changement de leadership à des compétences humaines uniques: conscience, compassion, sagesse, empathie, compréhension sociale, communication transparente, pensée critique et adaptabilité. Les managers doivent développer des compétences technologiques afin de prendre des décisions bien fondées sur les outils d'IA et de conduire les équipes par le changement. Cela comprend la compréhension des données et l'évaluation critique des informations générées par l'IA.

Les tâches de gestion les plus importantes comprennent la promotion d'une culture de prise de décision contrôlée par les données, une gestion efficace du changement, des considérations éthiques par le gouvernement de l'IA et la promotion de l'innovation et de la créativité. L'IA peut soulager les gestionnaires des tâches de routine afin qu'ils puissent se concentrer sur des aspects stratégiques et humains tels que la motivation et le développement des employés. Le nouveau rôle d'un «responsable de l'innovation et de la transformation» (CITO) peut survenir, ce qui combine l'expertise technique, la connaissance du comportement et la vision stratégique. Les gestionnaires doivent naviguer dans des paysages éthiques complexes, favoriser les transformations culturelles, gérer la coopération entre les personnes et l'IA, entraîner une intégration transversale et assurer une innovation responsable.

Le défi de base pour les gestionnaires de l'âge de l'IA est non seulement de comprendre l'IA, mais aussi de diriger la réaction humaine à l'IA. Cela comprend la culture d'une culture d'apprentissage, traitant des peurs avant la perte de travail et la survenue d'une utilisation éthique d'IA, ce qui rend les compétences générales plus importantes que jamais. Il y a un écart potentiel dans la perception des relations interpersonnelles dans l'âge de l'IA: 82% des employés les jugent nécessaires, contre seulement 65% des gestionnaires. Cet écart pourrait conduire à des stratégies de leadership qui investissent trop peu dans les liens humains et potentiellement altérer la moralité et la coopération. Des directives efficaces de l'IA comprennent un ensemble de capacités paradoxales: l'acceptation de l'objectivité contrôlée par les données par l'IA tout en renforçant le jugement humain subjectif, l'intuition et l'argument éthique. Il s'agit d'élargir l'intelligence humaine, de ne pas faire de l'intelligence artificielle.

Convient à:

- L'acceptation de l'introduction de nouvelles technologies telles que l'IA, la réalité étendue et augmentée et comment cela peut être promu

Transformation du travail d'équipe: l'influence de l'IA sur la collaboration et la dynamique de l'équipe

L'IA peut améliorer le travail d'équipe en automatisant les tâches de routine et permet aux employés de se concentrer sur le travail stratégique et créatif. Les systèmes d'IA peuvent soutenir une meilleure prise de décision en analysant les données et en donnant des équipes. Les outils d'IA peuvent promouvoir une meilleure communication et coordination, permettent une collaboration en temps réel et l'échange d'informations et de ressources. La gestion des connaissances basée sur l'IA peut faciliter l'accès aux connaissances centralisées, permettre des recherches intelligentes et promouvoir l'échange de connaissances. La combinaison des compétences créatives humaines, du jugement et de l'intelligence émotionnelle avec l'analyse des données et les compétences d'automatisation de l'IA peut conduire à un travail plus efficace et bien fondé.

Les défis incluent la garantie de la protection des données et de la gestion des données éthiques dans les outils collaboratifs de l'IA, le potentiel de "perte de compétence" entre les employés si l'IA entretient trop de tâches sans stratégie de qualification supplémentaire, et la peur que les contacts personnels puissent devenir moins courants.

Bien que l'IA puisse améliorer l'efficacité de la collaboration (par exemple, l'achat d'informations plus rapide, l'automatisation des tâches), les gestionnaires doivent activement travailler pour maintenir la qualité de l'interaction humaine et de la cohésion de l'équipe. Cela signifie concevoir des processus de travail de telle manière que les membres de l'équipe d'IA ont complété au lieu d'isoler et créent des opportunités de véritables connexions humaines. L'intégration réussie de l'IA dans le travail d'équipe dépend fortement de la confiance de confiance dans la fiabilité et l'équité de la technologie ainsi que la confiance entre les membres de l'équipe, la façon dont les connaissances basées sur l'IA sont utilisées. Un manque de confiance peut conduire à la résistance et subir des efforts de collaboration.

IA en tant que partenaire créatif: expansion et redéfinition de la créativité dans les organisations

L'IA générative peut, si elle est introduite stratégique et soigneusement, créer un environnement dans lequel la créativité humaine et l'IA coexistent et travaillent ensemble. L'IA peut promouvoir la créativité en agissant en tant que partenaire, en offrant de nouvelles perspectives et en déplaçant les limites du possible dans des domaines tels que les médias, l'art et la musique. L'IA peut automatiser les partages de routine de processus créatifs et ainsi libérer les gens pour un travail plus conceptuel et innovant. Il peut également aider à reconnaître les nouvelles tendances ou à accélérer le développement de produits grâce à des expériences basées sur l'IA.

Le dilemmata et les défis éthiques découlent du fait que le contenu a gêté en matière de l'IA settant en question les idées traditionnelles de la paternité, de l'originalité, de l'autonomie et de l'intention. L'utilisation de données protégées par le droit d'auteur pour la formation des modèles d'IA et la génération de contenu potentiellement juridique sont des préoccupations considérables. De plus, il existe un risque de dépendance excessive à l'égard de l'IA, qui pourrait potentiellement supprimer l'exploration créative humaine indépendante et le développement des compétences à long terme.

L'intégration de l'IA dans les processus créatives n'est pas seulement une question de nouveaux outils, mais aussi une redéfinition fondamentale de la créativité elle-même un modèle de création de KI-KO. Cela nécessite un changement de mentalité pour les professionnels de la création et leurs managers qui ont mis l'accent sur le travail avec l'IA en tant que nouvelle modalité. Les considérations éthiques liées au contenu généré par l'IA (paternité, biais, profondeur) signifient que les organisations ne peuvent pas simplement reprendre les outils créatifs d'IA sans directives éthiques robustes et supervision. Les gestionnaires doivent s'assurer que l'IA est utilisé de manière responsable pour étendre la créativité, et non pour la tromperie ou la violation.

Créer l'ordre: mise en œuvre du gouvernement de l'IA pour une transformation responsable

La nécessité du gouvernement de l'IA: pourquoi c'est important pour son entreprise

Le gouvernement de l'IA garantit que les systèmes d'IA sont développés et utilisés de manière éthique, transparente et conformément aux valeurs humaines et aux exigences juridiques.

Les raisons importantes du gouvernement de l'IA sont:

- Considérations éthiques: aborde le potentiel de décisions biaisées et des résultats injustes, garantit l'équité et le respect des droits de l'homme.

- Conformité juridique et réglementaire: assure le respect des lois spécifiques à l'IA (telles que la loi UE KI) et des réglementations existantes sur la protection des données (RGPD).

- Gestion des risques: offre un cadre pour identifier, évaluer et contrôler les risques liés à l'IA, tels que la perte de confiance des clients, la perte de compétence ou les processus de prise de décision biaisés.

- Surveillance: favorise la transparence et l'expliabilité en cas de décisions de l'IA et crée la confiance entre les employés, les clients et les parties prenantes.

- Maximisation de la valeur: assurez-vous que l'utilisation de l'IA s'adresse aux objectifs commerciaux et que ses avantages sont effectivement mis en œuvre.

Sans gouvernance raisonnable, l'IA peut entraîner des dommages involontaires, des violations éthiques, des sanctions juridiques et des dommages de réputation.

Le gouvernement de l'IA n'est pas seulement une fonction de conformité ou de réduction des risques, mais un pionnier stratégique. En déterminant des règles, des responsabilités et des directives éthiques claires, les organisations peuvent promouvoir un environnement dans lequel les innovations d'IA peuvent prospérer de manière responsable, ce qui conduit à des solutions d'IA plus durables et plus fiables. La nécessité du gouvernement de l'IA est directement proportionnelle à l'autonomie et à la complexité croissantes des systèmes d'IA. Si les organisations de simples assistants d'IA passent à des agents d'IA et à des modèles de base plus sophistiqués, la portée et la rigueur de la gouvernance doivent également être développées afin de faire face à de nouveaux défis en termes d'obligation comptable, de transparence et de contrôle.

Travaux de cadre et meilleures pratiques pour un gouvernement d'IA efficace

Les approches de gouvernance vont de l'information informelle (basée sur les valeurs d'entreprise) aux solutions ad hoc (réaction à des problèmes spécifiques) à des travaux formels (travaux de cadre complète).

Travaux de framework principaux (exemples):

- NIST Cadre de gestion des risques de l'IA (AI RMF): se concentre sur le soutien des organisations dans le contrôle des risques liés à l'IA par le biais de fonctions telles que les taxes, la cartographie, la mesure et la gestion.

- ISO 42001: établit un système complet de gestion de l'IA qui nécessite des directives, une gestion des risques et une amélioration continue.

- Principes de l'IA de l'OCDE: Promouvoir un traitement responsable de l'IA et mettre l'accent sur les droits de l'homme, l'équité, la transparence et la responsabilité.

Meilleures pratiques pour la mise en œuvre:

- Construire des structures de gouvernance interne (par exemple, l'éthique de l'IA, les groupes de travail interfonctionnels) avec des rôles et des responsabilités clairs.

- Mise en œuvre d'un système de classification basé sur les risques pour les applications d'IA.

- Assurer le gouvernement et la gestion des données robustes, y compris la qualité des données, la protection des données et l'examen des distorsions.

- Mise en œuvre des examens de conformité et de conformité basés sur les normes et réglementations pertinentes.

- Prescrire une supervision humaine, en particulier pour les systèmes à haut risque et les décisions critiques.

- Intégration des parties prenantes (employés, utilisateurs, investisseurs) grâce à une communication transparente.

- Élaboration de directives éthiques claires et de leur intégration dans le cycle de développement de l'IA.

- Investissement dans des cours de formation et la gestion du changement pour assurer la compréhension et l'acceptation des directives de gouvernance.

- Commencez par des applications et des projets pilotes clairement définis, puis à l'échelle progressive.

- Gestion d'un répertoire des systèmes d'IA utilisés dans l'entreprise.

Le gouvernement d'IA efficace n'est pas une solution unitaire. Les organisations doivent adapter les travaux de cadre tels que le NIST AI RMF ou ISO 42001 à leur industrie spécifique, leur taille, leur risque de risque et les types d'IA qu'ils utilisent. Une prise de contrôle purement théorique d'un cadre sans adaptation pratique n'est probablement pas efficace. Le "facteur humain" dans le gouvernement de l'IA est tout aussi crucial que les aspects "processus" et "technologie". Cela comprend la cession claire de la responsabilité, la formation complète et la promotion d'une culture qui apprécie l'utilisation d'IA éthique et responsable. Sans acceptation et compréhension de la part des employés, même le cadre de gouvernance le mieux conçu échouera.

Composants clés d'un cadre gouvernemental d'IA

Ce tableau offre une liste de contrôle complète et des instructions pour les gestionnaires qui souhaitent établir ou améliorer leur gouvernement d'IA.

Les éléments clés d'un cadre gouvernemental d'IA sont cruciaux pour assurer une utilisation responsable et efficace de l'IA. Les principes centraux et les directives éthiques devraient réfléchir aux valeurs des entreprises et s'orienter vers les droits de l'homme, l'équité et la transparence. Les rôles et les responsabilités doivent être clairement définis; Cela comprend un Conseil d'éthique de l'IA, des gestionnaires de données et des examinateurs de modèles, par lesquels les tâches, les pouvoirs décisionnels et l'obligation de rendre compte doivent être clairement déterminés. Une gestion efficace des risques nécessite l'identification, l'évaluation et la réduction des risques, tels que ceux définis sur la base des catégories de droit de l'UE KI. Les évaluations régulières des risques ainsi que le développement et le suivi des stratégies de réduction jouent ici un rôle central. La gouvernance des données garantit que des aspects tels que la qualité, la protection des données, la sécurité et la reconnaissance des biais sont pris en compte, y compris le respect du RGPD et les mesures contre la discrimination. La gestion du cycle de vie du modèle comprend des processus standardisés pour le développement, la validation, l'utilisation, la surveillance et la mise en service et met un accent particulier sur la documentation, le versioning et la surveillance continue des performances. La transparence et l'expliabilité sont essentielles pour assurer la traçabilité des décisions de l'IA et divulguer l'utilisation de l'IA. La conformité aux exigences légales, telles que la loi UE KI et le RGPD, doit également être assurée par des examens et des ajustements en cours ainsi que par la coopération avec le service juridique. Formation et affûtage de la conscience pour les développeurs, les utilisateurs et les gestionnaires favorisent la compréhension des bases de l'IA, des aspects éthiques et des directives de gouvernance. Enfin, la réaction et l'assainissement de l'incident doivent être garantis afin de traiter efficacement les dysfonctionnements, les violations éthiques ou les incidents de sécurité. Cela comprend les voies de rapport établies, les processus d'escalade et les mesures correctives qui permettent une intervention rapide et ciblée.

Convient à:

- La course dans le domaine de l'intelligence artificielle (IA) : 7 pays à surveiller - dont l'Allemagne - top 10

Prenez les devants: impératif stratégique pour la transformation de l'IA

Cultiver la préparation à l'IA: le rôle de l'apprentissage continu et de la qualification supplémentaire

En plus des connaissances spécialisées, les gestionnaires ont besoin d'une compréhension stratégique de l'IA afin de faire progresser efficacement leurs entreprises. La formation en IA pour les gestionnaires devrait couvrir les bases de l'IA, les études de cas réussies, la gestion des données, les considérations éthiques et l'identification du potentiel d'IA dans leur propre entreprise. À partir du 2 février 2025, l'UE KI Act (Art. 4) prescrit une «compétence d'IA» pour le personnel impliqué dans le développement ou l'utilisation des systèmes d'IA. Cela comprend la compréhension des technologies de l'IA, des connaissances sur les applications, de la pensée critique et des conditions de cadre juridique.

Les avantages de la formation d'IA aux gestionnaires comprennent la capacité de gérer les projets d'IA, de développer des stratégies d'IA durables, d'optimiser les processus, de garantir des avantages concurrentiels et d'assurer une utilisation éthique et responsable de l'IA. Un manque de compétence et de compétences en IA est un obstacle considérable à l'adaptation de l'IA. Divers formats de formation sont disponibles: cours de certificat, séminaires, cours en ligne, formation en présence.

La préparation de l'IA signifie non seulement l'acquisition de compétences techniques, mais aussi la promotion d'une façon de penser à l'apprentissage et à l'adaptabilité continus dans toute l'organisation. Compte tenu du développement rapide de l'IA, une formation spécifique basée sur des outils peut être obsolète. Par conséquent, les connaissances et les compétences de base de l'IA pour la pensée critique sont des investissements plus permanents. L'obligation de compétence en IA de la loi sur l'UE KI est un moteur réglementaire pour une qualification ultérieure, mais les organisations devraient voir cela comme une opportunité et pas seulement comme une charge de conformité. Une main-d'œuvre plus compétente en IA est mieux équipée pour identifier les applications d'IA innovantes, utiliser efficacement les outils et comprendre les implications éthiques, ce qui conduit à de meilleurs résultats d'IA dans l'ensemble. Il existe un lien clair entre l'absence de compétences / compréhension de l'IA et la propagation de l'ombre AI. Les investissements dans la formation complète de l'IA peuvent réduire directement les risques associés à l'utilisation d'IA non autorisée en permettant aux employés de prendre des décisions éclairées et responsables.

Les chances et les risques synthétisent: une feuille de route pour le leadership souverain de l'IA

La gestion de la transformation de l'IA nécessite une compréhension globale du potentiel de la technologie (innovation, efficacité, qualité) et ses risques inhérents (éthique, légalement, socialement).

La conception proactive des voyages en IA de l'organisation comprend le leadership souverain de l'IA:

- Établissement d'un gouvernement d'IA robuste basé sur des principes éthiques et un cadre juridique tels que la loi UE KI.

- Promotion d'une culture d'apprentissage continu et de compétence en IA à tous les niveaux.

- Identification stratégique et hiérarchisation des applications d'IA qui fournissent une valeur tangible.

- Renforcer les talents humains grâce à l'accent mis sur les compétences complétées au lieu de remplacer et de gérer les effets humains de l'IA.

- Des défis de gestion proactifs tels que Schatten-KI.

L'objectif ultime est d'utiliser l'IA comme pionnier stratégique pour la croissance durable et les avantages concurrentiels et en même temps réduire leurs inconvénients potentiels. Le vrai «leadership souverain de l'IA» va au-delà de la gestion organisationnelle interne et comprend une compréhension plus large des effets sociaux de l'IA et du rôle de l'entreprise dans cet écosystème. Cela signifie participer à des discussions politiques, contribuer à la détermination des normes éthiques et garantir que l'IA est utilisée pour le puits social et pas seulement pour le profit. Le voyage de la transformation de l'IA n'est pas linéaire et contiendra la navigation à travers des ambiguïtés et des défis inattendus. Les gestionnaires doivent donc cultiver l'agilité et la résilience organisationnelles afin que leurs équipes puissent s'adapter à des progrès technologiques imprévus, à des changements réglementaires ou à des troubles liés au marché par l'IA.

Convient à:

- Top dix en matière de conseil et de planification – Aperçu et astuces de l'intelligence artificielle : divers modèles d'IA et domaines d'application typiques

Comprendre et utiliser les technologies: Bases d'IA pour les décideurs

La transformation par l'intelligence artificielle n'est plus une vision lointaine de l'avenir, mais une réalité actuelle qui remet en question les entreprises de toutes tailles et industries et offre en même temps d'immenses opportunités. Pour les spécialistes et les gestionnaires, cela signifie jouer un rôle actif dans la conception de ce changement afin de soulever le potentiel de l'IA de manière responsable et de gérer les risques associés en toute confiance.

Les bases de l'IA, des modèles génératifs à la distinction entre les assistants et les agents aux moteurs technologiques tels que l'apprentissage automatique et les modèles de base, constituent les bases d'une compréhension plus profonde. Ces connaissances sont essentielles pour pouvoir prendre des décisions bien fondées sur l'utilisation et l'intégration des systèmes d'IA.

Le cadre juridique, en particulier l'UE KI Act, établit des directives claires pour l'élaboration et l'application de l'IA. L'approche basée sur les risques et les obligations qui en résultent, en particulier pour les systèmes à haut risque et en ce qui concerne la compétence d'IA requise des employés, nécessitent une discussion proactive et la mise en œuvre de structures de gouvernance robustes. Le domaine de tension entre la poursuite de l'innovation et la nécessité de responsabilité doit être dissous par une stratégie intégrée qui considère la conformité et l'éthique comme une partie intégrante du processus d'innovation.

Les utilisations possibles de l'IA sont diverses et entre les industries. L'identification des cas d'utilisation appropriés, le contrôle des techniques d'interaction efficaces telles que l'incitation et l'utilisation consciente des applications fantômes sont des compétences clés afin de mettre en œuvre la valeur ajoutée de l'IA dans votre propre domaine de responsabilité.

Enfin et surtout, l'IA change de manière durable, comme cela est guidé, a travaillé ensemble et la créativité est vécue. Les gestionnaires sont tenus d'adapter leurs compétences pour se concentrer davantage sur les compétences humaines telles que l'empathie, la pensée critique et la gestion du changement et pour créer une culture dans laquelle les personnes et les machines travaillent de manière synergique. La promotion de la collaboration et l'intégration de l'IA en tant que partenaire créatif nécessitent de nouvelles façons de penser et de gestion.

L'établissement d'un gouvernement d'IA complet n'est pas un accessoire facultatif, mais une nécessité stratégique. Il crée le cadre pour une utilisation éthique, transparente et sûre de l'IA, minimise les risques et renforce la confiance dans toutes les parties prenantes.

La transformation de l'IA est un voyage qui nécessite un apprentissage continu, une adaptabilité et une vision claire. Les spécialistes et les gestionnaires qui sont confrontés à ces défis et à intérioriser les principes et les pratiques décrits ici sont bien équipés pour concevoir l'avenir de leurs organisations, domaines et équipes et en toute confiance à l'ère de l'intelligence artificielle.