Publicado el 21 de julio de 2025 / Actualización del: 21 de julio de 2025 – Autor: Konrad Wolfenstein

¿Un nuevo "Momento Sputnik"? Modelos AI: ¿Llegará pronto Kimi K3? ¿Por qué Kimi K2 elige la industria de la IA? – Imagen: xpert.digital

El Kimi Bang: este modelo de IA de China es 10 veces más barato que GPT-4 y igual de inteligente.

El avance de China | AI al precio de combate: cuando la tecnología se vuelve más democrática

El mundo de la IA está bajo el poder y el gatillo tiene un nombre: Kimi K2. Desarrollado por la startup de Beijing Moonshot Ai, este nuevo modelo de idioma garantiza un verdadero "Kimi Bang" en la industria y ya está cambiado como el "segundo momento de profundidad profunda" – evento que reorganiza el equilibrio de poder en la competencia global de IA. Pero, ¿qué hace que Kimi K2 sea tan especial? Es la combinación explosiva de tres propiedades disruptivas: la apertura radical a través de una co-licencia modificada, un rendimiento impresionante que se mantiene en puntos de referencia con gigantes como GPT-4 y un modelo de precios que socava la competencia occidental por tamaño.

La metáfora del "momento Sputnik" describe el choque que Estados Unidos experimentó en 1957 cuando la Unión Soviética disparó inesperadamente el primer satélite – Sputnik 1 – al espacio. Este evento de repente hizo que Occidente se diera cuenta de que había sido superado por un competidor en un campo de tecnología decisiva. El resultado fue una llamada nacional de Wake -UP que condujo a inversiones masivas en ciencia y educación y provocó la "carrera hacia el espacio".

Transferido a la IA, el "Kimi Bang" significa una llamada de atención similar para el mundo de la tecnología occidental: una empresa china no solo ha desarrollado un modelo que puede mantener el rendimiento con el GPT-4 líder, sino que también lo publica como un modelo de código abierto y con una fracción de los costos. Este avance tecnológico y económico cuestiona el dominio previo de las empresas estadounidenses como OpenAai y señala el comienzo de una nueva fase de competencia en torno al liderazgo global de IA.

Este avance demuestra impresionantemente que los modelos de IA abiertos y libremente disponibles no solo se ponen al día tecnológicamente, sino que también intervienen en una nueva era en términos de rentabilidad y accesibilidad. Para las nuevas empresas, los investigadores y las empresas en todo el mundo, esto significa una revolución de las posibilidades, mientras que los jugadores establecidos como OpenAai y Anthrope están bajo una presión masiva. Nos sumergimos profundamente en la arquitectura, los puntos de referencia y las implicaciones de gran alcance de Kimi K2 y analizamos si este "momento Ai Sputnik" de China cambiará el futuro de la inteligencia artificial.

Kimi K2 combina tres propiedades disruptivas:

- Abierto – Moonshot AI publica archivos de modelo bajo una co -licenidad modificada.

- Rendimiento – en puntos de referencia como MMLU-Pro, Kimi K2 excede los modelos de competidores públicos y logra resultados en el nivel GPT-4.

- Costos – la API solo exige $ 0.15 cada 1 millón de tokens de entrada y $ 2.50 cada uno de 1 millón de tokens de salida, lo que significa que es más barato que los modelos superiores occidentales.

Adecuado para:

- KI Modelo Kimi K2 de Moonshot AI: El nuevo buque insignia de código abierto de China – otro hito para los sistemas de IA abiertos

¿Quién desarrolla Kimi K2 y qué significa el término "Kimi Bang"?

Moonshot Ai, fundada en Beijing en 2023, se centra en modelos de voz extremadamente grandes y describe cada publicación de versión grande internamente como "Bang". La comunidad se hizo cargo del término cuando Kimi K2 irrumpió en las listas de referencia el 11 de julio de 2025 y llevó las listas de descarga a abrazar a Face en tiempo récord.

¿Cuál fue el primer "momento profundo"?

La expresión describe el choque cuando Deepseek R1 por primera vez logró el rendimiento de razonamiento de los sistemas patentados como modelo abierto en enero de 2025. Los analistas compararon este paso con un "momento sputnik" para el código abierto de IA.

Adecuado para:

- Retirado por el curso en Tech Shares – IA Intercambios desde China: Deepseek Shakes Global AI Tech Giants en los Estados Unidos

¿Por qué hablas de un segundo momento profundo?

Kimi K2 repite y refuerza la narración: una startup china publica un LLM descargable libremente que no solo puede mantenerse al día, sino que también dominar en disciplinas individuales – sino esta vez con la arquitectura MOE, el enfoque de uso de herramientas y nuevamente menores costos operativos.

¿Cómo se construye Kimi K2?

- Arquitectura: transformador de mezcla de expertos con 1 billón de parámetros totales, se activan 32 mil millones por inferencia.

- Ventana de contexto: 128 K tokens, optimizados por la estación latente de múltiples cabezas (MLA).

- Optimizador: Muonclip reduce las inestabilidades de entrenamiento y se mitiga la mitad de los gastos aritméticos hacia Adamw.

- Vistas de herramientas: el punto de control de instrucciones contiene esquemas de llamadas de funciones implementadas nativas.

¿Qué hardware necesita un autohost?

Sin cuantización, los pesos ascienden a ≈1 TB. Un hilo en el subreddit /r /localllama calcula una configuración de RAM de CPU con 1.152 GB DDR5 y un RTX 5090 por menos de $ 10,000. Para latencias productivas, las GPU Moonshot con tensorrt-llm o Vllm-back-end recomiendan.

¿Cómo lo hace Kimi K2 en los puntos de referencia principales?

Moonshot informa 87.8% en MMLU, 92.1% en GSM-8K y 26.3% PASS@1 en LivecodeBech. VentureBeat confirma el 65.8% en el banco SWE verificado, con el cual Kimi K2 excede muchos sistemas patentados.

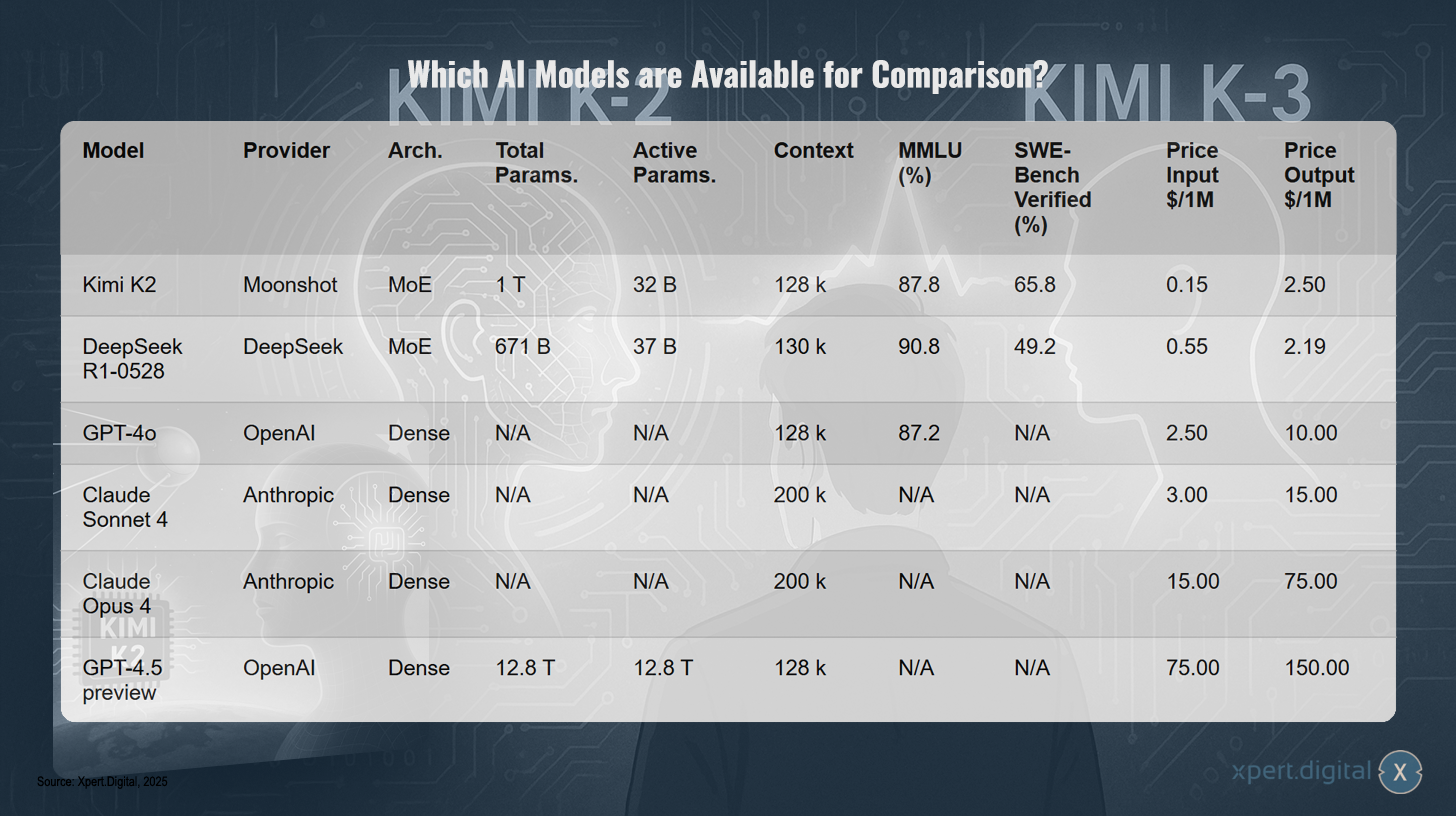

¿Qué modelos de IA son para comparar?

En el paisaje actual de los modelos de IA hay una impresionante variedad de sistemas que se caracterizan por diferentes propiedades. La visión general comparativa muestra modelos de varios proveedores como Moonshot, Deepseek, OpenAai y Anthrope, cada uno de los cuales tiene sus propias características de arquitectura y rendimiento.

El modelo Kimi K2 de Moonshot se basa en una arquitectura mixta de experto (MOE) con un total de 1 billón de parámetros, de los cuales 32 mil millones están activos. Ofrece un alcance de contexto de 128,000 caracteres y logra un notable 87.8% en el punto de referencia MMLU y el 65.8% en la calificación verificada de SWE-Bench. Los costos son de $ 0.15 por millón de tokens de entrada y $ 2.50 por millón de tokens de producción.

El modelo R1-0528 de Deepseek muestra características similares con la arquitectura MOE, 671 mil millones de parámetros totales y 37 mil millones de parámetros activos. Supere Kimi K2 con 90.8% en la prueba MMLU, pero tiene un precio ligeramente más alto de $ 0.55 por millón de tokens de entrada.

Los modelos de OpenAai y antrópico como GPT-4O, Claude Sonnet 4, Claude Opus 4 y la vista previa de GPT-4.5 difieren de su arquitectura densa y, a veces, no se publican números de parámetros. Los precios significativamente más altos son particularmente sorprendentes, especialmente para el modelo de vista previa GPT-4.5 con tokens de entrada de $ 75 por millón y $ 150 por millón de tokens de producción.

¿Qué es particularmente notable en la comparación?

- Kimi K2 alcanza puntajes MMLU casi idénticos como GPT-4O, pero solo necesita 32 b de parámetros activos por respuesta.

- Deepseek R1 vence a Kimi K2 en MMLU, pero es más débil en los puntos de referencia de ingeniería de software.

- En términos de precio, Kimi K2 es un factor de 10 bajo GPT-4O y un factor de 5 bajo el soneto de Claude 4.

¿Qué tan radical es la diferencia de precio?

Las diferencias de precios entre los diferentes modelos de IA son notables e ilustran un cambio dramático en la relación costo-rendimiento. Un cálculo de muestra para 1 millón de tokens muestra las diferencias significativas de precios: mientras que modelos como Kimi K2 y Deepseek R1 son muy baratos alrededor de $ 2.65-2.74 por millón de tokens, los precios de GPT-4O a $ 12.50 soneto 4 a $ 9.00 y Claude Opus. El costo de GPT-4.5 a $ 112.50 por millón de tokens es particularmente sorprendente. Este cálculo subraya que la relación de costo-rendimiento se mueve cada vez más de China a favor de los modelos MOE abiertos (mezcla de expertos), que son significativamente más baratos que los modelos de IA occidentales establecidos.

¿Qué efecto tiene esto en las nuevas empresas e investigaciones?

Los precios de los tokens favorables permiten ventanas de contexto más largas y más iteraciones por experimento, lo que hace que la investigación sea más barata. Al mismo tiempo, los altos precios occidentales desplazan a los usuarios de bajo margen en la dirección de la infraestructura de Kimi K2, como Siliconflow o Groq.

¿Qué significa el Kimi Bang para la competencia transatlántica?

Según los analistas de Golem, Moonshot Ai OpenAai resulta abiertamente y obliga a las compañías estadounidenses a acelerar aún más los pasos de precios. Las revistas expertas comparan el efecto con una "serie Ki Sputnik" después de que Deepseek inició la narrativa. Los inversores en Europa advierten que la inercia regulatoria conduce a una mayor emigración tecnológica.

¿Cómo reaccionan los líderes del mercado?

En abril de 2025, OpenAai anunció su propio modelo de peso abierto por primera vez para contrarrestar la impresión de código abierto. Anthrope ahora ofrece descuentos agresivos de caché de hasta 90%, pero permanece detrás de Kimi K2.

¿Por qué es crucial Muonclip?

Moonshot y UCLA muestran que Muonclip minimiza las inestabilidades en miles de millones de dólares y reduce a la mitad el consumo de memoria de Adamw. Esto permite un entrenamiento de token de 15.5 billones sin ningún descanso.

¿Qué papel juega el diseño de la mezcla de expertos?

MOE activa solo un subconjunto de expertos especializados por token. Esto reduce el tiempo de computación y el consumo de electricidad, mientras que el número total de parámetros sigue siendo alto. GPT-4O y Claude, por otro lado, usan arquitecturas densas y tienen que calcular todos los pesos de qué costos.

¿Qué incluye la co-licenidad modificada?

Permite uso comercial, transmitir y sublicente, pero obliga a referirse a la fuente y la licencia. Esto significa que Kimi K2 puede usarse en entornos en los primeros, lo que aborda particularmente los requisitos de protección de datos europeos.

¿Hay lados oscuros?

Los investigadores critican que Kimi K2 pasó por alto los eventos históricos en la historia china y, por lo tanto, tiene sesgo. También tiene miedo de que la apertura facilite las aplicaciones indeseables, como la desinformación automatizada.

Inteligencia de agente: ¿Kimi K2 es un paso para los agentes autónomos de IA?

Sí. Moonshot entrenado explícitamente en la herramienta y las llamadas de funciones, para que Kimi K2 pueda orquestar de forma independiente. VentureBeat enfatiza las habilidades del agente como un punto de venta único. Esto distingue a Kimi K2 de Deepseek R1, que revela principalmente razonamiento, pero hace que el uso de herramientas dependa del marco de los agentes.

Integración en flujos de trabajo: ¿Cómo integro Kimi K2 en las tuberías de OpenAI existentes?

Moonshot ofrece puntos finales compatibles con OpenAI, por los cuales la temperatura solicitada se escala internamente a 0.6. Los desarrolladores solo tienen que intercambiar URL base y pueden usar herramientas como Langchain o Llamaindex sin ningún cambio.

¿Qué mejores prácticas hay para la llamada de herramientas?

- Funciones entregadas como un esquema JSON.

- Mantenga la temperatura 0.6 para forzar las llamadas de herramientas deterministas.

- Verifique los resultados con la solicitud de reflexión para minimizar las alucinaciones.

¿Qué proveedor de la nube alojó Kimi K2?

Siliconflow, Fireworks AI y Groq ofrecen pago por intrusión con un rendimiento de hasta 100 K TPM.

¿Cómo puede Europa ponerse al día?

Los analistas requieren una "AI Gigafactory" basada en el modelo estadounidense para capacitar a sus propios modelos con una fuente de alimentación favorable. Hasta entonces, Europa podría confiar en modelos abiertos como Kimi K2 y concentrarse en finetunas verticales.

¿Qué campos específicos de la aplicación benefician primero?

- Asistencia en el código: KIMI-DEV-72B utiliza datos KIMI-K2 y alcanza el 60,4% de Swe-Bench.

- Análisis de documentos: 128 K La ventana de contexto permite una larga opinión.

- Tuberías de datos: baja latencia de 0.54 s El primer token hace que los chatbots en tiempo real sean realistas.

¿Cuáles son los principales riesgos?

- Sesgo y censura en temas críticos.

- Salida de datos a través de API públicas.

- Los costos de hardware para la inferencia en el momento aún son altos a pesar de MOE.

¿Kimi K2 presionará permanentemente los precios occidentales?

La presión de precio ya se ha utilizado: OpenAi bajó GPT-4O tres veces en menos de doce meses. Claude socavó tarifas anteriores por mecanismos de caché. Los analistas ven a Kimi K2 como un catalizador para una "carrera hacia el fondo" para los precios del token, similar a AWS en forma de Cloud Market 2010.

¿Kimi K3 vendrá pronto?

Moonshot nombra modelos mundiales multimodales y arquitecturas autoinformadas como los próximos hitos. Las filtraciones de información privilegiada hablan de una ventana de contexto a la optimización de 512 K Tokens y Pegasus. Sin embargo, la compañía oficialmente no comenta sobre una hoja de ruta.

¿Qué queda del "Segundo momento de profundidad"?

Kimi K2 demuestra que los modelos abiertos no solo pueden mantenerse al día, sino que también dominan en términos de precio. El movimiento del poder, impulsa la innovación y obliga a todos los proveedores a hacer más transparencia. Para las empresas, se crea una nueva base de costos, un rico campo de prueba para los investigadores y para los reguladores la presión para mantenerse al día con la velocidad del desarrollo abierto.

El Kimi Bang así marca una vaina: los que combinan la apertura y la eficiencia en el futuro establecerán los estándares de la economía de IA.

Adecuado para:

Su transformación de IA, integración de IA y experto en la industria de la plataforma de IA

☑️ Nuestro idioma comercial es inglés o alemán.

☑️ NUEVO: ¡Correspondencia en tu idioma nacional!

Estaré encantado de servirle a usted y a mi equipo como asesor personal.

Puedes ponerte en contacto conmigo rellenando el formulario de contacto o simplemente llámame al +49 89 89 674 804 (Múnich) . Mi dirección de correo electrónico es: wolfenstein ∂ xpert.digital

Estoy deseando que llegue nuestro proyecto conjunto.