Prohlídka s průvodcem v transformaci AI: Workshop Zpráva pro odborníky a manažery

Předběžná verze Xpert

Výběr hlasu 📢

Publikováno dne: 10. května 2025 / Aktualizace od: 10. května 2025 - Autor: Konrad Wolfenstein

Prohlídka s průvodcem v transformaci AI: Zpráva Workshopu pro odborníky a manažery-image: xpert.digitální

Co nyní musí manažeři vědět s AI: Využijte příležitosti, spravujte rizika, vede s jistotou (čas čtení: 32 min / bez reklamy / bez výplaty)

Master The AI Revolution: Úvod do manažerů

Přepracování transformační síly AI: Redesign Work and Value Creation

Umělá inteligence (AI) je považována za technologii, která se otevírá jako žádné jiné nové možnosti zásadního přehodnocení práce a tvorby hodnot. Pro společnosti je integrace AI rozhodujícím krokem k tomu, aby zůstala v dlouhodobém horizontu úspěšná a konkurenceschopná, protože podporuje inovace, zvyšuje efektivitu a zvyšuje kvalitu. Ekonomické a sociální účinky AI jsou značné; Je to jedno z nejdůležitějších témat digitálních budoucích budoucích, rychle se vyvíjí a přílohy obrovský potenciál. Společnosti stále více rozpoznávají výhody automatizace a zvyšování účinnosti AI. Nejedná se pouze o technologickou změnu, ale o zásadní změnu v obchodních modelech, optimalizacích procesů a interakcí se zákazníky, které se přizpůsobují potřebě přežití v soutěži.

Mnohem -cinovaná „transformační síla“ AI přesahuje čisté zavedení nových nástrojů; To znamená posun paradigmatu ve strategickém myšlení. Manažeři jsou povinni znovu vyvolávat základní procesy, příslib hodnot a dokonce i průmyslové struktury. Pokud považujete AI pouze za nástroj pro účinnost, riskujete přehlídku svého hlubšího strategického potenciálu. Rychlý rozvoj AI splňuje stávající nedostatek kvalifikovaných pracovníků. To vytváří dvojitou výzvu: Na jedné straně existuje naléhavá potřeba rychlé další kvalifikace, aby bylo možné používat AI. Na druhé straně KI nabízí příležitost automatizovat úkoly, a tak potenciálně zmírnit nedostatek kvalifikovaných pracovníků v některých oblastech, zatímco současně vzniknou nové kvalifikační požadavky. To vyžaduje plánování nuance personálu ze strany manažerů.

Vhodné pro:

- Umělá inteligence jako business booster ve firmě – další praktické tipy pro zavádění AI ve firmách od jedenácti interim manažerů

Vážení příležitostí a rizik ve věku AI

Přestože systémy AI nabízejí vysoce efektivní příležitosti, jsou neoddělitelně spojeny s riziky, která je třeba řídit. Diskuse o AI zahrnuje zvážení vašeho významného potenciálu proti vlastním pohonům, který vyžaduje vyvážený přístup k využití výhod a minimalizaci nevýhod. Společnosti čelí výzvě podporovat inovace a zároveň dodržovat pokyny pro ochranu údajů a etiky, což činí rovnováhu mezi pokrokem a souladkou rozhodujícím.

Tento vyrovnávací akt není rozhodnutím o jednom, ale o trvalou strategickou potřebu. S dalším rozvojem technologií AI,-například ze specializovaných AI na obecnější dovednosti-změní se také typ příležitostí a rizik. To vyžaduje nepřetržité oživení a přizpůsobení správy a strategie. Vnímání rizik a výhod AI se může v rámci organizace výrazně lišit. Například aktivní uživatelé AI mají tendenci být optimističtější než ti, kteří dosud nezavedli AI. To ilustruje kritickou výzvu v řízení změn pro manažery: Tato mezera ve vnímání musí být uzavřena vzděláváním, jasnou komunikací a demonstrací hmatatelných výhod se současným řešením obav.

Pochopte krajinu AI: základní koncepty a technologie

Generative KI (Genai) a cesta k umělé obecné inteligenci (AGI)

Generative Ki (Genai)

Generativní KI (Genai) označuje modely AI, které jsou navrženy tak, aby vytvářely nový obsah ve formě psaného textu, zvuku, obrázků nebo videí a nabízejí širokou škálu aplikací. Genai podporuje uživatele při vytváření jedinečného, smysluplného obsahu a může působit jako inteligentní systém odpovědí na otázku nebo osobní asistent. Genai již revolucionizuje vytváření obsahu, marketingu a loajality zákazníků tím, že umožňuje rychlou výrobu personalizovaných materiálů a automatizaci odpovědí.

Okamžitá dostupnost a široká škála aplikací z Genai znamenají, že pro mnoho organizací často představuje „AI na základní úrovni“. Toto první dotykové tvary tvaruje vnímání a může řídit nebo bránit širší adaptaci AI. Manažeři musí pečlivě ovládat tyto první zkušenosti, aby vytvořili pozitivní dynamiku.

Umělá obecná inteligence (AGI)

Umělá obecná inteligence (AGI) odkazuje na hypotetickou inteligenci stroje, který je schopen porozumět nebo se naučit jakýkoli intelektuální úkol, který člověk dokáže zvládnout, a tak napodobuje lidské kognitivní dovednosti. Jde o systémy AI, které mohou plnit širokou škálu úkolů místo toho, aby se specializovaly na specializované.

Real AGI v současné době neexistuje; Zůstává to koncept a cíl výzkumu. OpenAI, přední společnost v této oblasti, definuje AGI jako „vysoce -autonomní systémy, které lidé přesahují v nejvíce ekonomicky cenné práci“. Do roku 2023 bylo dosaženo pouze prvního z pěti stoupajících hladin AGI, které se označuje jako „vznikající AI“.

Nejednoznačnost a různé definice AGI naznačují, že manažeři AGI by měli zvážit dlouhodobý, potenciálně transformační horizont než jako okamžitý provozní zájem. Důraz by se měl zaměřit na použití současné „silné AI“ a zároveň strategicky dodržovat pokrok AGI. Přes investice do spekulativních scénářů AGI by mohly odvrátit zdroje od okamžitých příležitostí AI. Vývoj specializované AI prostřednictvím Genai k probíhajícímu výzkumu AGI znamená rostoucí úroveň autonomie a výkonu systémů AI. Tento trend koreluje přímo s rostoucí potřebou robustních podmínek a správy etických rámců, protože silnější AI přináší větší potenciál pro zneužívání nebo neúmyslné důsledky.

Vhodné pro:

AIS asistent vs. AI agent AI: Definujte role a dovednosti

Asi asistenti AI podporují lidi v jednotlivých úkolech, reagují na dotazy, odpovídají na otázky a uvádějí návrhy. Obvykle jsou reaktivní a čekají na lidské příkazy. Brzy asistenti byli pravidelně založeni, ale moderní se spoléhají na strojové učení (ML) nebo nadační modely. Naproti tomu agenti AI jsou autonomnější a jsou schopni sledovat cíle a rozhodovat nezávisle s minimálním lidským zásahem. Jsou proaktivní, mohou interagovat se svým okolím a přizpůsobit je učením.

Hlavní rozdíly spočívají v autonomii, složitosti úkolů, interakcí uživatele a dovednosti rozhodování. Asistenti poskytují informace pro lidská rozhodnutí, zatímco agenti mohou přijímat a provádět rozhodnutí. V oblasti aplikace zlepšují asistenti zákazníky, podporují HR úkoly v bankovních dotazech a optimalizují. Agenti se naproti tomu mohou přizpůsobit chování uživatele v reálném čase, aktivně zabránit podvodům a automatizovat komplexní HR procesy, jako je talenta pancial.

Přechod z asistentů AI na agenty AI signalizuje vývoj z AI jako „nástroje“ na AI jako „spolupracovníka“ nebo dokonce jako „autonomní zaměstnanec“. To má hluboké účinky na design práce, týmové struktury a nezbytné dovednosti lidských zaměstnanců, kteří s nimi stále více musí spravovat a pracovat. Vzhledem k tomu, že agenti AI jsou stále běžnější a jsou schopni přijímat nezávislá rozhodnutí, „mezera z odpovědnosti“ se stává naléhavějším problémem. Pokud agent AI učiní nesprávné rozhodnutí, přidělení odpovědnosti se stává složitým. To zdůrazňuje kritickou nutnost robustní vlády AI, která se zabývá jedinečnými výzvami autonomních systémů.

Níže je srovnání nejdůležitějších rozlišovacích rysů:

Porovnání asistentů AI a agentů AI

Tato tabulka nabízí manažerům jasné pochopení základních rozdílů, aby vybral správnou technologii pro konkrétní potřeby a předvídal různé stupně dohledu a složitosti integrace.

Srovnání asistentů AI a agentů AI ukazuje významné rozdíly v jejich charakteristikách. Zatímco asistenti AI jsou spíše reaktivní a čekají na lidské příkazy, agenti AI jednají proaktivní a autonomně tím, že jedná nezávisle. Primární funkce asistenta AI spočívá v provádění úkolů na vyžádání, zatímco agent AI je zaměřen na dosažení cíle. Asi asistenti AI podporují lidi při rozhodování, zatímco agenti AI nezávisle přijímají a provádějí rozhodnutí. Učební chování těchto dvou se také liší: AI asistent se většinou učí omezené a verze založené na verzi, zatímco agenti AI jsou adaptivní a neustále se učí. Mezi hlavní aplikace asistentů AI patří chatboty a informační volání, ale oblasti aplikace agentů AI patří automatizace procesů, detekce podvodů a řešení složitých problémů. Interakce s lidmi vyžaduje stálý vstup pro AI asistenta, zatímco pro agenty AI je nezbytný pouze minimální lidský zásah.

Strojová místnost: strojové učení, velké hlasové modely (LLM) a základní modely

Machine Learning (ML)

Machine Learning je pododstavec AI, ve které se počítače učí z dat a zlepšují se zkušenostmi, aniž by byly výslovně naprogramovány. Algoritmy jsou vyškoleny k nalezení vzorů ve velkých datových souborech a na základě toho rozhodování a předpovědi. Modely ML zahrnují monitorované učení (učení z označených dat), nepřekonatelné učení (nalezení vzorů v datech bez označených), částečně monitorované učení (směs označených a ne značených dat) a posilování učení (učení prostřednictvím experimentů s odměnami). ML zvyšuje účinnost, minimalizuje chyby a podporuje rozhodování ve společnostech.

Porozumění různým typům strojového učení není důležité pouze pro manažery z technického hlediska, ale také pro pochopení požadavků na údaje. Monitorované učení například vyžaduje velká množství vysoce kvalitních, označených datových záznamů, které mají dopad na datovou strategii a investice. Ačkoli identifikace obchodních problémů by měla být na začátku, použitelnost určitého typu ML bude silně záviset na dostupnosti a typu dat.

Velké hlasové modely (LLM)

Velké hlasové modely jsou druhem hlubokého algoritmu učení, který je vyškolen v obrovských datových záznamech a často se používá v aplikacích zpracování přirozeného jazyka (NLP), aby reagoval na dotazy v přirozeném jazyce. Příklady toho jsou série GPT od OpenAI. LLMS může generovat lidské texty, řídit chatboty a podporovat automatizovaný zákaznický servis. Můžete však také převzít nepřesnosti a zkreslení z údajů o školení a vyvolat obavy ohledně autorských práv a bezpečnosti.

Problém „merorizace“ na LLMS, ve kterém doslova vystupujete text z tréninkových dat, obsahuje značná rizika autorských práv a plagiátorství pro společnosti, které používají obsah generovaný LLM. To vyžaduje pečlivé procesy kontroly a pochopení původu edicí LLM.

Základní modely

Základní modely jsou velké modely AI, které byly vyškoleny na široká data a mohou být upraveny (jemně doladěné) pro různé downstream úkoly. Vyznačují se vznikem (neočekávané dovednosti) a homogenizací (společná architektura). Liší se od klasických modelů AI v tom, že jsou zpočátku specifické pro domácí, používají učení monitorované samosprávy, umožňují přenosové učení a jsou často multimodální (zpracování textu, obrázku, zvuku). LLM jsou druh základního modelu. Mezi výhody patří rychlejší přístup na trh a škálovatelnost, ale výzvy jsou průhlednost (problém „černé skříňky“), ochrana údajů a vysoké náklady nebo požadavky na infrastrukturu.

Vzestup základních modelů signalizuje změnu směrem k všestrannějšímu a přizpůsobivějšímu AI. Vaše povaha „černé skříňky“ a značné zdroje, které jsou nezbytné pro váš trénink nebo jemné doladění, však znamenají, že by mohl být přístup a kontrola koncentrován, což vytváří potenciálně závislosti na několika velkých poskytovatelích. To má strategické dopady na rozhodnutí „make-or-buy“ a riziko uzamčení dodavatele. Multimodální schopnost mnoha základních modelů otevírá zcela nové kategorie aplikací, které mohou syntetizovat nálezy z různých datových typů (např. Analýza textových zpráv spolu s monitorováním záznamů kamery). To jde nad rámec toho, co dokáže LLMS zaměřené na text, a vyžaduje širší přemýšlení o jejich dostupných databázích.

Regulační kompas: Navigace prostřednictvím právních a etických rámcových podmínek

Zákon EU Ki: Základní ustanovení a účinky pro společnosti

Zákon EU Ki, který vstoupil v platnost 1. srpna 2024, je prvním komplexním zákonem AI na světě a stanoví klasifikační systém založený na rizicích pro AI.

Kategorie rizik:

- Neachotatelné riziko: Systémy AI, které představují jasnou hrozbu pro bezpečnost, živobytí a práva, jsou zakázány. Příklady toho patří sociální bodování veřejných orgánů, kognitivní manipulace s chováním a nevyžádané čtení obrázků na obličej. Většina z těchto zákazů vstoupí v platnost do 2. února 2025.

- Vysoké riziko: Systémy AI, které negativně ovlivňují bezpečnost nebo základní práva. Podléhají přísným požadavkům, včetně systémů řízení rizik, správy dat, technické dokumentace, dohledu nad lidmi a hodnocení shody před trhem. Příklady jsou AI v kritických infrastrukturách, zdravotnických prostředcích, zaměstnanosti a vymáhání práva. Většina pravidel pro vysoce rizikovou AI platí od 2. srpna 2026.

- Omezené riziko: Systémy AI, jako jsou chatboti nebo systémy, které generují hluboké papíry, musí splňovat závazky transparentnosti a informovat uživatele, že interagují s AI nebo že obsah je generován AI.

- Minimální riziko: AI systémy, jako jsou spamové filtry nebo videohry na bázi AI. Zákon umožňuje svobodné použití, i když jsou podporovány dobrovolné chování.

Vhodné pro:

Zákon určuje povinnosti pro poskytovatele, dovozce, obchodníky a uživatele (operátory) systémů AI, přičemž poskytovatelé vysoce rizikových systémů podléhají nejpřísnějším požadavkům. Vzhledem k extrateritoriální aplikaci ovlivňuje také společnosti mimo EU, pokud se jejich systémy AI používají na trhu EU. Specifická pravidla se vztahují na modely AI s obecným účelem (modely GPAI) s dalšími závazky pro ty, které jsou klasifikovány jako „systémové riziko“. Tato pravidla se obecně platí od 2. srpna 2025. Pokud se nesplňuje, existují značné pokuty, až 35 milionů EUR nebo 7 % globálního ročního obratu pro zakázané žádosti. Od února 2025 článek 4 rovněž předepisuje přiměřenou úroveň kompetence AI pro personál poskytovatelů a provozovatelů některých systémů AI.

Přístup zákona EU AI založený na riziku vyžaduje zásadní změnu přístupu společností k rozvoji a používání AI. Nejedná se pouze o technickou proveditelnost nebo obchodní hodnotu; Od začátku životního cyklu AI musí být integrovány regulační dodržování a snížení rizika („dodržování návrhu“). „Povinnost kompetencí AI“ je důležitým včasným odhodláním. To znamená okamžitá potřeba, aby společnosti hodnotily a implementovaly vzdělávací programy nejen pro technické týmy, ale také pro každého, kdo vyvíjí, používá nebo monitoruje systémy AI. To přesahuje základní povědomí a zahrnuje porozumění funkcím, limitům a etickým a právním rámci. Zaměření zákona na modely GPAI, zejména na systémovém riziku, naznačuje regulační obavy ohledně širokých a potenciálně nepředvídaných účinků těchto mocných, rozmanitých modelů. Společnosti, které takové modely používají nebo vyvíjejí, podléhají intenzivnímu zkoumání a závazkům, které ovlivňují jejich plány rozvoje a úvodní strategie na trhu.

Přehled kategorií rizik zákona EU Ki a základních závazků

Tato tabulka shrnuje základní strukturu zákona EU Ki a pomáhá manažerům rychle rozpoznat, do které kategorie by jejich systémy AI mohly spadnout a porozumět odpovídajícímu zatížení a plány dodržování předpisů.

Přehled kategorií rizik zákona EU KI ukazuje, že systémy s nepřijatelným rizikem, jako je sociální bodování, kognitivní manipulace a neochované škrábání obličejových obrazů, jsou plně zakázány a již se nemusí uplatňovat od února 2025. závazky. Poskytovatelé a provozovatelé musí mimo jiné mít systém řízení rizik, řízení kvality dat a technickou dokumentaci, zajistit transparentnost, zajistit lidský dohled a splňovat kritéria, jako je robustnost, přesnost, kybernetická bezpečnost a posouzení shody. Odpovídající opatření vstoupí v platnost od srpna 2026, částečně od srpna 2027. Omezené rizikové obavy se týkají aplikací AI, jako jsou chatboty, systémy detekce emocí, biometrické kategorizační systémy a hlubší. Povinnosti transparentnosti, jako je označování jako systém AI nebo obsah generovaný AI, se také považují za účinné od srpna 2026. Neexistují žádné specifické závazky pro žádosti AI s minimálním rizikem, jako jsou spamové filtry nebo videohry podporované AI, přičemž dobrovolné behaviorální KODICE jsou doporučeny. Takové systémy lze okamžitě použít.

Položení napětí závazku výpočtu inovací: Najděte správnou rovnováhu

Společnosti musí zvládnout oblast napětí mezi podporou inovací AI a zárukou odpovědnosti, ochrany údajů (GDPR) a etickém využití. Principy GDPR (zákonnost, spravedlnost, transparentnost, účelová vazba, minimalizace dat, správnost, odpovědnost) jsou zásadní pro odpovědnou AI a ovlivňují to, jak se systémy AI vyvíjejí a používají. Strategie rovnováhy zahrnují včasnou integraci týmů pro dodržování předpisů a ochrany údajů, běžné audity, využití externích znalostí a použití specializovaných nástrojů pro dodržování předpisů. Někteří nepovažují regulační pokyny za inovační brzdy, ale za urychlovač, který vytváří důvěru a zvyšuje přijímání nových technologií.

„Napínací oblast povinné povinnosti inovací“ není statickým kompromisem, ale dynamickým zůstatkem. Společnosti, které aktivně vkládají odpovědnost a etické úvahy do svého inovačního cyklu AI, častěji budují udržitelná a důvěryhodná řešení AI. To nakonec podporuje hlavní inovace tím, že se vyhýbá nákladnému dodatečnému vybavení, poškození pověsti nebo regulačními tresty. Výzva zachování odpovědnosti je posílena rostoucí složitostí a potenciální „černou skříňkou“ povahou pokročilých modelů AI (jak je uvedeno v základních modelech). To vyžaduje silnější zaměření na techniky vysvětlitelnosti (XAI) a robustní mechanismy auditu, aby se zajistilo, že rozhodnutí AI lze v případě potřeby pochopit, odůvodnit a zpochybnit.

🎯📊 Integrace nezávislé platformy AI pro AI v celé společnosti 🤖🌐 Pro všechny záležitosti

Ki-Gamechanger: Nejflexibilnější řešení platformy AI na platformě AI, která snižují náklady, zlepšují jejich rozhodnutí a zvyšují efektivitu

Nezávislá platforma AI: Integruje všechny relevantní zdroje dat společnosti

- Tato platforma AI interaguje se všemi specifickými zdroji dat

- Z SAP, Microsoft, Jira, Confluence, Salesforce, Zoom, Dropbox a mnoho dalších systémů správy dat

- Rychlá integrace AI: Řešení AI na míru na míru na míru nebo dny místo měsíců

- Flexibilní infrastruktura: cloudové nebo hostování ve vašem vlastním datovém centru (Německo, Evropa, svobodný výběr umístění)

- Nejvyšší zabezpečení dat: Používání v právnických firmách je bezpečný důkaz

- Používejte napříč širokou škálou zdrojů firemních dat

- Výběr vašich vlastních nebo různých modelů AI (DE, EU, USA, CN)

Výzvy, které naše platforma AI řeší

- Nedostatek přesnosti konvenčních řešení AI

- Ochrana dat a zabezpečení správy citlivých dat

- Vysoké náklady a složitost individuálního vývoje AI

- Nedostatek kvalifikované AI

- Integrace AI do stávajících IT systémů

Více o tom zde:

Strategie AI pro manažery: Praktické pokyny a příklady

AI v akci: Aplikace, aplikace a efektivní interakce

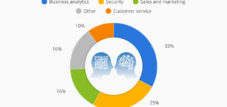

Rozpoznat příležitosti: AI AIPORIKACE A APLIKACE PRO PRŮMYSLU

KI nabízí širokou škálu aplikací, včetně vytváření obsahu, personalizovaného přístupu zákazníka, optimalizace procesů ve výrobě a logistice, údržby a podpory v oblasti financí, lidských zdrojů a IT.

Konkrétní příklady průmyslu zahrnují:

- Automobil/výroba: AI a simulace ve výzkumu (Arena2036), Automatizovaná interakce robotů (FESTO), Optimalizace procesů a prediktivní údržba ve výrobě (BOSCH).

- Finanční služby: Zvýšené zabezpečení analýzou velkého množství údajů o podezřelých transakcích, automatizované faktuře, analýze investic.

- Zdravotní péče: rychlejší diagnózy, rozšířený přístup k péči (např. Interpretace lékařských obrazů), Optimalizace farmaceutického výzkumu.

- Telekomunikace: Optimalizace výkonu sítě, audiovizuální vylepšení, prevence migrace zákazníků.

- Maloobchod/elektronický obchod: Personalizovaná doporučení, chatboty pro zákaznický servis, automatizované pokladní procesy.

- Marketing a prodej: Vytváření obsahu (chatgpt, canva), optimalizované kampaně, segmentace zákazníků, prognózy prodeje.

Zatímco mnoho aplikací se zaměřuje na automatizaci a efektivitu, důležitou nově vznikajícím trendem je role AI při zlepšování lidského rozhodnutí a umožnění nových forem inovací (např. Vývoj léčiv; vývoj produktu). Manažeři by se měli podívat nad rámec snížení nákladů, aby identifikovali možnosti růstu a inovací řízených AI. Mezi nejúspěšnější implementace AI často patří integrace AI do stávajících základních procesů a systémů (např. SAP používá KI v firemním softwaru, Microsoft 365 Copilot) místo toho, aby zacházelo AI jako nezávislou izolovanou technologii. To vyžaduje holistický pohled na architekturu společnosti.

Vhodné pro:

- Umělá inteligence: Pět klíčových strategií pro transformaci AI úspěšná integrace pro udržitelné správy podniků

Master The Dialog: Efektivní výzva k generativní AI

Okamžitě inženýrství je iterativní proces kontrolovaný test pro zlepšení výstupu modelu, který vyžaduje jasné cíle a systematické testování. Efektivní výzvy závisí jak na obsahu (pokyny, příklady, kontext), tak na struktuře (pořadí, označování, separátor).

Důležité komponenty výzvy jsou: cíl/mise, pokyny, omezení (co dělat/dělat), zvuk/styl, data kontextu/pozadí, několik příkladů, žádost o ospravedlnění (řetězec) a požadovaný formát odpovědi.

Mezi osvědčené postupy patří:

- Stanovte jasné cíle a použijte akční slovesa.

- Poskytněte kontext a základní informace.

- Přesně definujte cílovou skupinu.

- AI řekne, co by to nemělo dělat.

- Formulovat výzvu, stručně, stručné as přesným výběrem slov.

- Přidejte výstupní hranice, zejména pro psaní úkolů.

- Přiřaďte roli (např. „Jste matematický učitel“).

- Okamžité řetězení (použití propojené výzvy) může generovat nepřetržité nápady.

Efektivní výzva je menší hledání jediné „dokonalé výzvy“ než vývoj strategického přístupu pro interakci s LLMS. To zahrnuje pochopení modelových dovedností, iterativní zdokonalení výzev na základě výstupu a použití technik, jako je přidělení rolí a řetězec, i když za účelem vedení AI k požadovaným výsledkům. Je to schopnost, která vyžaduje cvičení a kritické myšlení. Schopnost poskytovat relevantní kontext a definovat omezení je nanejvýš důležitá pro získání cenných výsledků od Genai. To znamená, že kvalita obsahu generovaného AI je často přímo úměrná kvalitě a specificitě lidského vstupu, což zdůrazňuje přetrvávající význam lidských odborných znalostí v tomto procesu.

Osvědčené postupy pro vytváření efektivních výzev AI

Tato tabulka nabízí praktické, implementovatelné rady, které se mohou manažeři a specialisté okamžitě přihlásit ke zlepšení svých interakcí s generativními nástroji AI.

Aby bylo možné dosáhnout cenných výsledků k použití generativní AI, je zásadní řešit konkrétně a jasně, přesně definovat cíl a používat akční slovesa, jako je „Vytvořit seznam klíčových bodů, který shrnuje nejdůležitější výsledky příspěvku“. Je stejně důležité poskytnout kontext, například poskytováním základních informací a relevantních údajů, jako je „Na základě finanční zprávy, analyzovat ziskovost posledních pěti let“. Cílová skupina a požadovaný zvuk by měly být jasně artikulovány, například „Napište popis produktu pro mladé dospělé, kteří si cení udržitelnosti“. AI může být také přidělena specifická role nebo osobnost, například „Jste marketingový odborník. Denort kampaň pro ...“. S pomocí několika příkladů, například „Vstup: Apple. Výstup: ovoce. Vstup: Carrow. Výstup:“, lze lépe ilustrovat požadovaný výstupní formát. Přesné formátování odpovědí je také rozumné definovat, jak „formátovat vaši odpověď v Markdown“. Omezení, jako je „Vyhněte se technickému žargonu. Odpověď by již neměla být více než 200 slov“ pomáhat optimalizovat výstup. Iterativní přístup, ve kterém je výzva přizpůsobena a zdokonalena na základě předchozích výsledků, dále zvyšuje kvalitu. Nakonec lze řetězec použít myšlenky (řetězový řetězec) tím, že požádá AI, aby vysvětlil svůj myšlení krok za krokem, například „Vysvětlete svůj argument krok za krokem“.

Řešení Invisible AI: Porozumění a spravujte stínové aplikace (Shadow AI)

Schadten-Ki označuje neoprávněné nebo neregulované používání nástrojů AI zaměstnanci, často ke zvýšení produktivity nebo k zabránění pomalým oficiálním procesům. Je to podkategorie stínu.

Rizika stínu Ki:

- Zabezpečení dat a ochrana dat: Neoprávněné nástroje mohou vést k porušování ochrany dat, zveřejnění citlivých dat -vlastněných dat/společnosti a nedodržení GDPR/HIPAA.

- Soulad a právo: Porušení zákonů o ochraně údajů, problémy s autorskými právy, konflikty se svobodou informací. Žádost o „kompetence AI“ zákona EU Ki od února 2025 je argument naléhavě.

- Ekonomicky/operační: neefektivní paralelní struktury, skryté náklady prostřednictvím jednotlivých předplatných, nedostatek kontroly nad licencemi, nekompatibilita se stávajícími systémy, narušení pracovních procesů, snížená účinnost.

- Kvalita a kontrola: Nedostatek transparentnosti při zpracování dat, potenciál pro zkreslené nebo zavádějící výsledky, eroze veřejnosti/interní důvěry.

- Podkopání správy: OBELENÍ IT Vláda, což ztěžuje vymáhání bezpečnostních pokynů.

Strategie pro správu Schadten-KI:

- Rozvoj jasné strategie AI a zřízení odpovědné pokyny AI.

- Poskytování oficiálních, schválených nástrojů AI jako alternativy.

- Definice jasných pokynů pro použití AI, zpracování dat a schválené nástroje.

- Školení a senzibilizace zaměstnanců pro odpovědné použití AI, rizika a osvědčené postupy.

- Implementace pravidelných auditů pro odhalení neautorizované AI a zajištění dodržování předpisů.

- Přijetí přírůstkového přístupu vlády AI, počínaje malými kroky a zdokonalením pokynů.

- Propagace křížové spolupráce a zapojení zaměstnanců.

Schadten-Ki je často příznakem pro nenaplněné potřeby uživatele nebo nadměrné byrokratické procesy při zavádění technologie. Čistě restriktivní přístup („zakázán AI“) může odrazit. Efektivní řízení vyžaduje pochopení příčin a poskytování praktických a bezpečných alternativ kromě jasné správy. Vzestup snadno přístupných nástrojů Genai (jako je Chatgpt) pravděpodobně zrychlil šíření Schatten-KI. Zaměstnanci mohou tyto nástroje rychle používat bez účasti IT. Díky tomu je proaktivní školení kompetencí AI (jak vyžaduje zákon EU Ki) a jasnou komunikaci prostřednictvím schválených nástrojů ještě důležitější.

Rizika stínové AI a strategických reakcí

Tato tabulka nabízí strukturovaný přehled o různých hrozbách z neregulovaného používání AI a konkrétních, implementovatelných strategií pro manažery.

Stín AI nese četná rizika, s nimiž se společnosti musí strategicky setkat. V oblasti zabezpečení dat se může objevit úniky dat, neoprávněný přístup k citlivým informacím nebo infekcím malwaru. Mezi strategická opatření patří zavedení pokynů pro využití AI, vytvoření seznamu schválených nástrojů, použití šifrování, implementaci přísných kontrol přístupu a školení zaměstnanců. Pokud jde o rizika dodržování předpisů, jako je porušení GDPR, porušení průmyslových předpisů nebo porušení autorských práv, pravidelné audity, sekvence ochrany dat (DSFA) pro nové nástroje, jasně definované pokyny pro zpracování dat a v případě potřeby jsou právní poradenství nezbytné. Finanční rizika vyplývají z nekontrolovaných výdajů na předplatné, redundantní licence nebo neefektivnost. Společnosti by se proto měly spoléhat na centralizované zakázky, přísnou kontrolu rozpočtu a pravidelný přezkum používání nástrojů. Operativní výzvy, jako jsou nekonzistentní výsledky, nekompatibilita se stávajícími firemními systémy nebo poruchami procesů lze zvládnout poskytováním standardizovaných nástrojů, jejich integrací do stávajících pracovních postupů a nepřetržitými kontrolami kvality. Konečně, reputační rizika jsou nebezpečím, například ztráta důvěry zákazníků v důsledku poruch dat nebo nesprávné komunikace generované AI. Transparentní komunikace, dodržování etických pokynů a promyšleným plánem reakce na incidenty jsou zásadními opatřeními k udržení důvěry ve společnost a minimalizují možné poškození.

🎯🎯🎯 Využijte rozsáhlé, pětinásobné odborné znalosti Xpert.Digital v komplexním balíčku služeb | R&D, XR, PR & SEM

AI & XR 3D rendering Machine: Pětinásobná odbornost od Xpert.Digital v komplexním balíčku služeb, R&D XR, PR & SEM - Obrázek: Xpert.Digital

Xpert.Digital má hluboké znalosti z různých odvětví. To nám umožňuje vyvíjet strategie šité na míru, které jsou přesně přizpůsobeny požadavkům a výzvám vašeho konkrétního segmentu trhu. Neustálou analýzou tržních trendů a sledováním vývoje v oboru můžeme jednat s prozíravostí a nabízet inovativní řešení. Kombinací zkušeností a znalostí vytváříme přidanou hodnotu a poskytujeme našim zákazníkům rozhodující konkurenční výhodu.

Více o tom zde:

Jak transformovat vedení a spolupráci a posílit měkké dovednosti ve vedení: lidská výhoda ve věku AI

Jak transformovat vedení a spolupráci a posílit měkké dovednosti ve vedení: lidská výhoda ve věku AI: Xpert.digital

Lidský prvek: Účinky AI na vedení, spolupráci a kreativitu

Změna vedení ve věku AI: Nové požadavky a kompetence

AI vyžaduje posun ve vedení na jedinečné lidské dovednosti: povědomí, soucit, moudrost, empatie, sociální porozumění, transparentní komunikaci, kritické myšlení a přizpůsobivost. Manažeři musí rozvíjet technologické kompetence, aby přijali opodstatněná rozhodnutí o nástrojích AI a vedení týmů prostřednictvím změn. To zahrnuje pochopení dat a kritické posouzení informací generovaných AI.

Mezi nejdůležitější úkoly v oblasti řízení patří podpora kultury rozhodování řízeného daty, účinné řízení změn, řešení etických úvah prostřednictvím vlády AI a podpora inovací a kreativity. AI může zmírnit manažery rutinních úkolů, aby se mohli soustředit na strategické a lidské aspekty, jako je motivace a rozvoj zaměstnanců. Může vzniknout nová role „hlavního referenta inovace a transformace“ (CITO), která kombinuje technickou odbornost, znalost chování a strategickou vizi. Manažeři musí navigovat komplexní etická krajina, podporovat kulturní transformace, řídit spolupráci mezi lidmi a AI, řídit křížovou funkční integraci a zajistit odpovědné inovace.

Hlavní výzvou pro manažery ve věku AI není jen porozumět AI, ale také vést lidskou reakci na AI. To zahrnuje pěstování kultury učení, vypořádání se s obavami před ztrátou práce a výskyt etického používání AI, což zvyšuje měkké dovednosti důležitější než kdy jindy. Ve věku umělé inteligence je potenciální nesoulad ve vnímání mezilidských vztahů: 82 % zaměstnanců je považuje za nezbytné, ve srovnání s pouze 65 % manažerů. Tato mezera by mohla vést k strategiím vedení, které investují příliš málo do lidských spojení a potenciálně narušují morálku a spolupráci. Efektivní vedení AI zahrnuje sadu paradoxních schopností: přijetí objektivity řízené údaji AI při posilování subjektivního lidského úsudku, intuice a etického argumentu. Jde o rozšiřování lidské inteligence, ne vytváření umělé inteligence.

Vhodné pro:

- Přijetí zavádění nových technologií, jako je umělá inteligence, rozšířená a rozšířená realita, a způsob, jak je lze podporovat

Transformace týmové práce: Vliv AI na spolupráci a dynamiku týmu

AI může zlepšit týmovou práci automatizací rutinních úkolů a umožňuje zaměstnancům soustředit se na strategickou a kreativní práci. Systémy AI mohou podporovat lepší rozhodování analýzou dat a poskytováním týmů. Nástroje AI mohou podporovat lepší komunikaci a koordinaci, umožnit spolupráci v reálném čase a výměnu informací a zdrojů. Správa znalostí založená na AI může usnadnit přístup k centralizovaným znalostem, umožnit inteligentní vyhledávání a propagovat výměnu znalostí. Kombinace lidských tvůrčích dovedností, úsudku a emoční inteligence s dovednostmi AI s analýzou dat a automatizací může vést k efektivnější a opodstatněné práci.

Výzvy zahrnují záruku ochrany údajů a etické zpracování dat ve spolupráci AI nástrojů, potenciál „ztráty kompetencí“ mezi zaměstnanci, pokud AI přebírá příliš mnoho úkolů bez strategie pro další kvalifikaci a strach, že osobní kontakty by se mohly stát méně běžnými.

Zatímco AI může zlepšit efektivitu spolupráce (např. Rychlejší informace o zadávání zakázek, automatizace úkolů), musí manažeři aktivně pracovat, aby si udrželi kvalitu lidské interakce a soudržnosti týmu. To znamená navrhnout pracovní procesy takovým způsobem, že členové týmu AI doplnili místo izolovaných a vytvářejí příležitosti pro skutečné lidské spojení. Úspěšná integrace AI do týmové práce silně závisí na důvěře ve spolehlivosti a spravedlivosti technologií a důvěře mezi členy týmu, jak se používají znalosti založené na umělé inteligenci. Nedostatek důvěry může vést k odporu a podstoupit úsilí o spolupráci.

AI jako kreativní partner: Expanze a redefinice kreativity v organizacích

Generativní AI může, pokud je zavedena strategicky a pečlivě, vytvořit prostředí, ve kterém lidská kreativita a AI koexistují a spolupracují. AI může podporovat kreativitu tím, že působí jako partner, nabízí nové perspektivy a přesouvá limity možných oblastí, jako jsou média, umění a hudba. AI může automatizovat rutinní podíly kreativních procesů a tak uvolnit lidi pro více koncepční a inovativní práce. Může také pomoci rozpoznat nové trendy nebo zrychlit vývoj produktů prostřednictvím experimentů založených na AI.

Etická dilemata a výzvy vyplývají ze skutečnosti, že obsah generovaný AI zpochybňuje tradiční myšlenky autorství, originality, autonomie a záměru. Použití dat chráněných autorskými právy pro školení modelů AI a generování potenciálně právního obsahu je značné obavy. Kromě toho existuje riziko nadměrné závislosti na AI, která by mohla v dlouhodobém horizontu potenciálně potlačit nezávislý rozvoj lidského kreativního průzkumu a kompetencí.

Integrace AI do tvůrčích procesů není jen otázkou nových nástrojů, ale také zásadní předefinování kreativity samotného vzoru modelu vytváření lidského ki-ko. To vyžaduje změnu mentality pro kreativní profesionály a jejich manažery, kteří zdůraznili práci s AI jako novou modalitu. Etické úvahy související s obsahem generovaným AI (autorství, zaujatost, hluboké pobyty) znamenají, že organizace nemohou jednoduše převzít kreativní nástroje AI bez robustních etických pokynů a dohledu. Manažeři musí zajistit, aby AI byla zodpovědně používána k rozšíření kreativity, nikoli pro podvod nebo porušení.

Vytvořit pořádek: Implementace vlády AI pro odpovědnou transformaci

Potřeba vlády AI: Proč je to důležité pro její společnost

Vláda AI zajišťuje, že systémy AI jsou vyvíjeny a používány eticky, transparentně a v souladu s lidskými hodnotami a právními požadavky.

Důležité důvody vlády AI jsou:

- Etické úvahy: Zabývá se potenciálem zkreslených rozhodnutí a nespravedlivých výsledků, zajišťuje spravedlnost a úctu k lidským právům.

- Právní a regulační dodržování: Zajišťuje dodržování rozvoje zákonů specifických pro AI (jako je zákon EU Ki) a stávající předpisy o ochraně údajů (GDPR).

- Řízení rizik: Nabízí rámec pro identifikaci, hodnocení a kontrolu rizik souvisejících s AI, jako je ztráta důvěryhodnosti zákazníka, ztráta kompetence nebo zkreslené rozhodnutí -procesy tvorby.

- Dohled: Podporuje transparentnost a vysvětlovatelnost v případě rozhodnutí AI a vytváří důvěru mezi zaměstnanci, zákazníky a zúčastněnými stranami.

- Maximalizace hodnoty: Ujistěte se, že použití AI je zaměřeno na obchodní cíle a jeho výhody jsou účinně implementovány.

Bez přiměřené správy věcí veřejných může AI vést k neúmyslnému poškození, etickým porušováním, právním trestům a poškození pověsti.

Vláda AI není jen funkcí snižování dodržování předpisů nebo snižování rizik, ale strategickým průkopníkem. Stanovení jasných pravidel, povinností a etických pokynů mohou organizace podporovat prostředí, ve kterém mohou AI inovace zodpovědně prosperovat, což vede k udržitelnějším a důvěryhodnějším řešením AI. Potřeba vlády AI je přímo úměrná rostoucí autonomii a složitosti systémů AI. Pokud organizace z jednoduchých asistentů AI předají sofistikovanější agenty AI a základní modely, musí být rozsah a přísnost správy také dále rozvíjena, aby se vyrovnaly s novými výzvami, pokud jde o účetní závazek, transparentnost a kontrolu.

Rámcové práce a osvědčené postupy pro efektivní vládu AI

Přístupy pro správu a řízení se pohybují od neformálních (založených na hodnotách firem) po ad hoc řešení (reakce na konkrétní problémy) až po formální (komplexní rámcové práce).

Přední framework Works (příklady):

- Rámec pro řízení rizik AI NIST (AI RMF): Zaměřuje se na podporu organizací při kontrole rizik souvisejících s AI prostřednictvím funkcí, jako jsou daně, mapování, měření a řízení.

- ISO 42001: Zřizuje komplexní systém řízení AI, který vyžaduje pokyny, řízení rizik a neustálé zlepšování.

- Principy AI OECD: Podporovat odpovědné zacházení s AI a zdůraznit lidská práva, spravedlnost, transparentnost a odpovědnost.

Nejlepší postup pro implementaci:

- Budování struktur interní správy (např. AI etiky, mezifunkční pracovní skupiny) s jasnými rolemi a povinnostmi.

- Implementace klasifikačního systému založeného na riziku pro aplikace AI.

- Zajištění robustní datové vlády a řízení, včetně kvality dat, ochrany údajů a přezkumu pro zkreslení.

- Provádění kontrol dodržování předpisů a shody na základě příslušných standardů a předpisů.

- Předepsat lidský dohled, zejména pro vysoce rizikové systémy a kritická rozhodnutí.

- Integrace zúčastněných stran (zaměstnanci, uživatelé, investoři) prostřednictvím transparentní komunikace.

- Vývoj jasných etických pokynů a jejich integrace do vývojového cyklu AI.

- Investice do školení a řízení změn, aby bylo zajištěno porozumění a přijetí pokynů pro správu věcí veřejných.

- Začněte s jasně definovanými aplikacemi a pilotními projekty a poté postupně škálování.

- Správa adresáře AI systémů používaných ve společnosti.

Efektivní vláda AI není jednotka. Organizace musí přizpůsobit rámcové díla, jako je NIST AI RMF nebo ISO 42001 jejich konkrétnímu odvětví, velikosti, riziku rizika a typy umělé inteligence, které používají. Čistě teoretické převzetí rámce bez praktické adaptace pravděpodobně není účinné. „Faktor člověka“ ve vládě AI je stejně klíčový jako aspekty „proces“ a „technologie“. To zahrnuje jasné přiřazení odpovědnosti, komplexní školení a propagaci kultury, která oceňuje etické a odpovědné použití AI. Bez přijetí a porozumění ze strany zaměstnanců selže dokonce i nejlépe navržený rámec pro správu.

Klíčové komponenty rámce vlády AI

Tato tabulka nabízí komplexní kontrolní seznam a pokyny pro manažery, kteří chtějí zřídit nebo zlepšit svou vládu AI.

Klíčové komponenty vládního rámce AI jsou zásadní pro zajištění odpovědného a účinného používání AI. Ústřední principy a etické pokyny by se měly odrážet na hodnotách podniků a orientovat se na lidská práva, spravedlnost a transparentnost. Role a odpovědnosti mají být jasně definovány; To zahrnuje radu AI etiky, správci dat a modelové zkoušející, přičemž musí být jasně stanoveny úkoly, rozhodovací pravomoci a povinnost k účtu. Efektivní řízení rizik vyžaduje identifikaci, hodnocení a snížení rizik, jako jsou například kategorie práva EU KI. Ústřední roli zde hrají pravidelná hodnocení rizik, jakož i vývoj a monitorování strategií redukce. Správa dat zajišťuje, že jsou zohledněny aspekty, jako je kvalita, ochrana dat, bezpečnost a uznání zkreslení, včetně dodržování GDPR a opatření proti diskriminaci. Správa životního cyklu modelu zahrnuje standardizované procesy pro vývoj, validaci, použití, monitorování a uvedení do provozu a klade zvláštní důraz na dokumentaci, verzi a nepřetržité sledování výkonu. Pro zajištění sledovatelnosti rozhodnutí AI je nezbytná transparentnost a vysvětlitelnost a zveřejnění použití AI. Dodržování právních požadavků, jako je zákon EU Ki a GDPR, musí být také zajištěno probíhajícími přezkumy a úpravami procesů a spoluprací s právním oddělením. Školení a ostření vědomí pro vývojáře, uživatele a manažery podporují porozumění základům AI, etických aspektech a pokynech pro správu. Nakonec musí být zaručena reakce a nápravu incidentu, aby bylo možné účinně řešit poruchy, etické porušení nebo bezpečnostní incidenty. To zahrnuje zavedené trasy hlášení, eskalační procesy a nápravná opatření, která umožňují rychlý a cílený zásah.

Vhodné pro:

- Závod v oblasti umělé inteligence (AI): 7 zemí, které byste měli sledovat – včetně Německa – top ten tip

Vezměte vedení: Strategický imperativ pro transformaci AI

Pěstování připravenosti AI: Role nepřetržitého učení a další kvalifikace

Kromě specializovaných znalostí potřebují manažeři strategické porozumění AI, aby mohli účinně rozvíjet své společnosti. Školení AI pro manažery by mělo pokrývat základny AI, úspěšné případové studie, správu dat, etické úvahy a identifikaci potenciálu AI ve své vlastní společnosti. Od 2. února 2025 předepisuje zákon EU Ki (čl. 4) „kompetence AI“ pro personál, který se podílí na rozvoji nebo používání systémů AI. To zahrnuje pochopení technologií AI, znalostí aplikací, kritických myšlení a právních podmínek.

Mezi výhody školení AI pro manažery patří schopnost řídit projekty AI, rozvíjet udržitelné strategie AI, optimalizovat procesy, zajistit konkurenční výhody a zajistit etické a odpovědné využití umělé inteligence. Nedostatek kompetence a dovedností AI je značnou překážkou pro adaptaci AI. K dispozici jsou různé formáty školení: kurzy certifikátů, semináře, online kurzy, školení o přítomnosti.

Připravenost AI nejen znamená získávání technických dovedností, ale také podporu způsobu myšlení o neustálém učení a přizpůsobivosti v celé organizaci. S ohledem na rychlý vývoj AI může být specifické trénink založené na nástroji zastaralý. Základní znalosti a dovednosti AI pro kritické myšlení jsou proto trvalejší investice. „Povinnost kompetencí AI“ z zákona EU KI je regulačním řidičem pro další kvalifikaci, ale organizace by to měly považovat za příležitost a nejen za zátěž dodržování předpisů. Více kompetentní pracovní síly AI je lépe vybavena k identifikaci inovativních aplikací AI, efektivního používání nástrojů a k porozumění etickým důsledkům, což vede k lepšímu celkovému výsledku AI. Existuje jasné spojení mezi nedostatkem dovedností/porozumění AI a šířením stínové AI. Investice do komplexní formace AI mohou přímo snížit rizika spojená s neautorizovaným používáním AI tím, že umožňují zaměstnancům přijímat informovaná a odpovědná rozhodnutí.

Šance a rizika syntetizujte: Plán pro suverénní vedení AI

Řízení transformace AI vyžaduje holistické porozumění potenciálu technologie (inovace, efektivita, kvalita) a jeho vlastní rizika (etická, legálně, sociálně).

Proaktivní design výletů AI organizace zahrnuje vedení AI svrchovaného AI:

- Zřízení robustní vlády AI založené na etických principech a právním rámci, jako je zákon EU Ki.

- Podpora kultury nepřetržitého učení a kompetence AI na všech úrovních.

- Strategická identifikace a prioritizace aplikací AI, které poskytují hmatatelnou hodnotu.

- Posílení lidských talentů prostřednictvím zaměření na dovednosti doplněné namísto nahrazení a řízení lidských účinků AI.

- Proaktivní výzvy pro správu, jako je Schatten-KI.

Konečným cílem je použít AI jako strategický průkopník pro udržitelný růst a konkurenceschopné výhody a zároveň snížit jejich potenciální nevýhody. Skutečné „vedení AI svrchovaného AI“ přesahuje interní organizační řízení a zahrnuje širší porozumění sociálním účinkům AI a roli společnosti v tomto ekosystému. To znamená účast na politických diskusích, přispívající k určení etických standardů a zajištění toho, aby se AI používá pro sociální studnu a nejen pro zisk. Cesta transformace AI není lineární a bude obsahovat navigaci prostřednictvím nejednoznačnosti a neočekávaných výzev. Manažeři proto musí kultivovat organizační obratnost a odolnost, aby se jejich týmy mohly přizpůsobit nepředvídanému technologickému pokroku, regulačním změnám nebo poruchám souvisejícím s trhem pomocí AI.

Vhodné pro:

- Top deset pro poradenství a plánování – přehled a tipy umělé inteligence: Různé modely umělé inteligence a typické oblasti použití

Porozumění a používání technologií: Základny AI pro tvůrce rozhodnutí

Transformace prostřednictvím umělé inteligence již není vzdálenou vizí budoucnosti, ale současná realita, která zpochybňuje společnosti všech velikostí a průmyslových odvětví a zároveň nabízí obrovské příležitosti. Pro specialisty a manažery to znamená hrát aktivní roli při navrhování této změny, aby se zodpovědně zvednul potenciál AI a s jistotou s jistotou řídil související rizika.

Základy AI, od generativních modelů po rozlišení mezi asistenty a agenty až po technologické řidiče, jako je strojové učení a základní modely, tvoří základ pro hlubší porozumění. Tato znalost je nezbytná pro to, aby bylo možné přijímat opodstatněná rozhodnutí o používání a integraci systémů AI.

Právní rámec, zejména zákon EU Ki, stanoví jasné pokyny pro rozvoj a uplatňování AI. Přístup založený na riziku a výsledné povinnosti, zejména pro vysoce rizikové systémy a s ohledem na požadovanou kompetence zaměstnanců AI, vyžadují proaktivní diskusi a provádění robustních struktur správy. Oblast napětí mezi snahou o inovaci a potřebou odpovědnosti musí být rozpuštěna integrovanou strategií, která považuje dodržování předpisů a etiky za nedílnou součást inovačního procesu.

Možné použití AI je rozmanitá a napříč průmyslovými odvětvími. Identifikace vhodných případů použití, kontrola účinných interakčních technik, jako je výzva a vědomé použití stínových aplikací, jsou klíčovými kompetencemi za účelem implementace přidané hodnoty AI ve vaší vlastní oblasti odpovědnosti.

V neposlední řadě AI udržitelně mění cestu, jak je vedeno, spolupracovala a žila kreativita. Manažeři jsou povinni přizpůsobit své dovednosti, aby se více soustředili na lidské dovednosti, jako je empatie, kritické myšlení a řízení změn, a vytvořili kulturu, ve které lidé a strojová práce synergeticky. Propagace spolupráce a integrace AI jako kreativního partnera vyžadují nové způsoby myšlení a řízení.

Zřízení komplexní vlády AI není volitelným příslušenstvím, ale strategickou nutností. Vytváří rámec pro etické, transparentní a bezpečné používání AI, minimalizuje rizika a buduje důvěru ve všechny zúčastněné strany.

Transformace AI je cesta, která vyžaduje nepřetržité učení, přizpůsobivost a jasnou vizi. Specialisté a manažeři, kteří čelí těmto výzvám a internalizují zde uvedené principy a postupy, jsou dobře vybaveni k navrhování budoucnosti jejich organizací, oblastí a týmů a sebevědomě ve věku umělé inteligence.