جولة موجهة في تحول الذكاء الاصطناعي: تقرير ورشة عمل للمتخصصين والمديرين

الإصدار المسبق لـ Xpert

اختيار اللغة 📢

تم نشره على: 10 مايو 2025 / تحديث من: 10 مايو 2025 - المؤلف: Konrad Wolfenstein

جولة مصحوبة بمرشدين في تحول الذكاء الاصطناعى: تقرير ورشة عمل للمتخصصين والمديرين-صورة: xpert.digital

ما يحتاج المديرون الآن إلى معرفته مع الذكاء الاصطناعى: اغتنم الفرص ، وإدارة المخاطر ، والقيادة بثقة (وقت القراءة: 32 دقيقة / لا إعلانات / لا paywall)

إتقان ثورة الذكاء الاصطناعي: مقدمة للمديرين

إعادة تصميم القوة التحويلية لمنظمة العفو الدولية: إعادة تصميم العمل وخلق القيمة

تعتبر الذكاء الاصطناعي (AI) تقنية تفتح مثل أي إمكانيات جديدة أخرى لإعادة التفكير بشكل أساسي في العمل وخلق القيمة. بالنسبة للشركات ، يعد دمج الذكاء الاصطناعى خطوة حاسمة للبقاء ناجحًا وتنافسيًا على المدى الطويل لأنه يعزز الابتكار ، ويزيد من الكفاءة ويزيد من الجودة. الآثار الاقتصادية والاجتماعية لمنظمة العفو الدولية كبيرة ؛ إنها واحدة من أهم مواضيع المستقبل الرقمي ، وتتطور بسرعة وتأوي إمكانات هائلة. تعترف الشركات بشكل متزايد بمزايا الأتمتة وزيادة الكفاءة من قبل الذكاء الاصطناعي. هذا ليس مجرد تغيير تكنولوجي ، ولكن تغيير أساسي في نماذج الأعمال ، والتحسينات العمليات وتفاعلات العملاء التي تجعل التكيف مع الحاجة إلى البقاء في المنافسة.

تتجاوز "القوة التحويلية" التي تتم الإشارة إليها من الذكاء الاصطناعى تقديم أدوات جديدة ؛ إنه ينطوي على تحول نموذج في التفكير الاستراتيجي. يتعين على المديرين إعادة تقييم العمليات الأساسية ووعد القيم وحتى هياكل الصناعة. إذا كنت تعتبر الذكاء الاصطناعي فقط أداة كفاءة ، فأنت تتعرض لخطر التغلب على إمكاناتك الاستراتيجية الأعمق. يلتقي التطور السريع لمنظمة العفو الدولية بنقص حالي في العمال المهرة. هذا يخلق تحديًا مزدوجًا: من ناحية ، هناك حاجة ملحة لمزيد من التأهيل السريع حتى تتمكن من استخدام الذكاء الاصطناعي. من ناحية أخرى ، توفر KI الفرصة لأتمتة المهام وبالتالي تخفيف نقص العمال المهرة في بعض المجالات ، بينما تنشأ متطلبات التأهيل الجديدة في الوقت نفسه. وهذا يتطلب تخطيط أفراد دقيق من جانب المديرين.

مناسب ل:

- الذكاء الاصطناعي كمعزز للأعمال في الشركة - نصائح عملية إضافية لإدخال الذكاء الاصطناعي في الشركات من أحد عشر مديرًا مؤقتًا

وزن الفرص والمخاطر في عصر الذكاء الاصطناعي

على الرغم من أن أنظمة الذكاء الاصطناعى توفر فرصًا فعالة للغاية ، إلا أنها مرتبطة ارتباطًا وثيقًا بالمخاطر التي يجب إدارتها. يتضمن الخطاب حول الذكاء الاصطناعي النظر في إمكاناتك الكبيرة ضد محركات الأقراص المتأصلة ، والتي تتطلب اتباع نهج متوازن لاستخدام المزايا وتقليل العيوب. تواجه الشركات التحدي المتمثل في تعزيز الابتكارات وفي الوقت نفسه الامتثال لإرشادات حماية البيانات والأخلاقيات ، مما يجعل التوازن بين التقدم والامتثال حاسمًا.

هذا القانون الموازنة ليس قرارًا واحدًا ، ولكنه حاجة استراتيجية مستمرة. مع زيادة التطوير لتقنيات الذكاء الاصطناعى-مثال من الذكاء الاصطناعى المتخصصة نحو المزيد من المهارات العامة-سيتغير أيضًا نوع الفرص والمخاطر. وهذا يتطلب إعادة التقييم المستمر والتكيف مع الحوكمة والاستراتيجية. يمكن أن يختلف تصور مخاطر ومزايا الذكاء الاصطناعي بشكل كبير داخل المنظمة. على سبيل المثال ، يميل مستخدمو الذكاء الاصطناعى النشطين إلى أن يكونوا أكثر تفاؤلاً من أولئك الذين لم يقدموا بعد الذكاء الاصطناعي. يوضح هذا التحدي الحاسم في إدارة التغيير للمديرين: يجب أن تنتهي هذه الفجوة في الإدراك من خلال التعليم والتواصل الواضح وإظهار المزايا الملموسة مع معالجة متزامنة للمخاوف.

فهم المناظر الطبيعية لمنظمة العفو الدولية: المفاهيم والتقنيات الأساسية

ki (genai) والطريقة إلى الذكاء العام الاصطناعي (AGI)

ki (Genai) التوليدي (Genai)

تشير ki (Genai) عن نماذج الذكاء الاصطناعى المصممة لإنشاء محتوى جديد في شكل نص مكتوب أو صوت أو صور أو مقاطع فيديو ويقدم مجموعة واسعة من التطبيقات. يدعم Genai المستخدمين في إنشاء محتوى فريد وذات مغزى ويمكن أن يكون بمثابة نظام ذكي وجواب أو مساعد شخصي. يثير Genai بالفعل ثورة في إنشاء المحتوى والتسويق وولاء العملاء من خلال تمكين الإنتاج السريع للمواد الشخصية وأتمتة الإجابات.

تعني إمكانية الوصول الفوري والمجموعة الواسعة للتطبيق من Genai أنها غالبًا ما تمثل "AI للمبتدئين" للعديد من المنظمات. هذا التصور الأول لللمس ويمكن أن يقود أو يعيق التكيف الأوسع من الذكاء الاصطناعي. يتعين على المديرين التحكم بعناية في هذه التجارب الأولى من أجل خلق ديناميات إيجابية.

الذكاء العام الاصطناعي (AGI)

يشير الذكاء العام الاصطناعي (AGI) إلى الذكاء الافتراضي لآلة قادرة على فهم أو تعلم أي مهمة فكرية يمكن للشخص إدارتها وبالتالي تقليد المهارات المعرفية البشرية. إنه يتعلق بأنظمة الذكاء الاصطناعي التي يمكن أن تنفذ مجموعة واسعة من المهام بدلاً من التخصص في محدد.

AGI الحقيقي حاليا غير موجود ؛ يبقى مفهوم وهدف البحث. تعرّف Openai ، وهي شركة رائدة في هذا المجال ، AGI بأنها "أنظمة عالية الاستخدام التي يتجاوزها الناس في العمل الأكثر قيمة اقتصاديًا". بحلول عام 2023 ، تم تحقيق أول خمسة مستويات AGI الصاعدة ، والتي يشار إليها باسم "AI الناشئة".

يشير الغموض والتعاريف المختلفة لـ AGI إلى أن المديرين AGI يجب أن يفكروا في أفق طويل على المدى الطويل من المحتمل أن يكونوا من الشواغل التشغيلية الفورية. يجب أن يكون التركيز على استخدام "الذكاء الاصطناعى القوي" الحالي وفي الوقت نفسه مراقبة استراتيجيًا تقدم AGI. يمكن أن تصرف الاستثمارات في سيناريوهات AGI المضاربة الموارد من فرص الذكاء الاصطناعى الأكثر إلحاحًا. ينطوي تطوير الذكاء الاصطناعي المتخصص عبر Genai نحو الأبحاث المستمرة على AGI إلى زيادة مستوى الاستقلال الذاتي وأداء أنظمة الذكاء الاصطناعى. يرتبط هذا الاتجاه مباشرة بالحاجة المتزايدة لظروف إطار أخلاقية قوية وحكم ، لأن الذكاء الاصطناعى الأكثر قوة يحمل إمكانات أكبر للإساءة أو العواقب غير المقصودة.

مناسب ل:

مساعد AI مقابل AI Agent: تحديد الأدوار والمهارات

يدعم مساعدو الذكاء الاصطناعى الأشخاص في المهام الفردية ، والرد على الاستفسارات ، والإجابة على الأسئلة ، وتقديم الاقتراحات. فهي عادة ما تكون تفاعلية وينتظرون الأوامر البشرية. كان المساعدون الأوائل يعتمدون بانتظام ، ولكن يعتمدون على نماذج التعلم الآلي (ML) أو نماذج الأساس. في المقابل ، يكون عوامل الذكاء الاصطناعى أكثر استقلالية وقادرة على متابعة الأهداف واتخاذ القرارات بشكل مستقل مع الحد الأدنى من التدخل البشري. فهي استباقية ، ويمكن أن تتفاعل مع محيطهم وتكييفها من خلال التعلم.

تكمن الاختلافات الرئيسية في الحكم الذاتي وتعقيد المهمة وتفاعل المستخدم ومهارات القرار. يقدم المساعدون معلومات عن القرارات البشرية ، بينما يمكن للوكلاء اتخاذ القرارات وتنفيذها. في مجال التطبيق ، يحسن المساعدون تجربة العملاء ، ودعم مهام الموارد البشرية في الاستفسارات المصرفية والتحسين. يمكن للوكلاء ، من ناحية أخرى ، التكيف مع سلوك المستخدم في الوقت الفعلي ، ويمنعون الاحتيال بشكل استباقي وأتمتة عمليات الموارد البشرية المعقدة مثل البكرية الموهبة.

يشير الانتقال من مساعدي الذكاء الاصطناعى إلى وكلاء الذكاء الاصطناعى إلى تطور من الذكاء الاصطناعي كـ "أداة" إلى الذكاء الاصطناعى باعتباره "متعاونًا" أو حتى "موظفًا مستقلاً". هذا له آثار عميقة على تصميم العمل وهياكل الفريق والمهارات اللازمة للموظفين البشر الذين يتعين عليهم بشكل متزايد إدارة والعمل معهم. نظرًا لأن عملاء الذكاء الاصطناعى أصبحوا شائعين بشكل متزايد ويكونون قادرين على اتخاذ قرارات مستقلة ، فإن "الفجوة في المساءلة" تصبح مشكلة أكثر إلحاحًا. إذا اتخذ وكيل الذكاء الاصطناعى قرارًا غير صحيح ، يصبح تخصيص المسؤولية معقدًا. هذا يؤكد على الضرورة الحاسمة لحكومة منظمة العفو الدولية القوية التي تعالج التحديات الفريدة للأنظمة المستقلة.

فيما يلي مقارنة بين أهم الميزات المميزة:

مقارنة مساعدي الذكاء الاصطناعى ووكلاء الذكاء الاصطناعى

يوفر هذا الجدول للمديرين فهمًا واضحًا للاختلافات الأساسية من أجل اختيار التكنولوجيا الصحيحة لتلبية الاحتياجات المحددة وتوقع درجات مختلفة من التعقيد الإشراف والتكامل.

تُظهر المقارنة بين مساعدي الذكاء الاصطناعى وعوامل الذكاء الاصطناعي اختلافات كبيرة في خصائصهم. في حين أن مساعدي الذكاء الاصطناعى رد فعلون إلى حد ما وينتظرون الأوامر البشرية ، فإن عملاء الذكاء الاصطناعى يتصرفون بشكل استباقي ومستقلة من خلال التصرف بشكل مستقل. تكمن الوظيفة الأساسية لمساعد الذكاء الاصطناعى في تنفيذ المهام عند الطلب ، في حين أن وكيل الذكاء الاصطناعى موجه نحو تحقيق الهدف. يدعم مساعدو الذكاء الاصطناعى الأشخاص في صنع القرار ، بينما يتخذ وكلاء الذكاء الاصطناعى وتنفيذ القرارات بشكل مستقل. يختلف سلوك التعلم بين الاثنين أيضًا: يتعلم مساعد AI في الغالب محدودًا وقائمًا على الإصدار ، في حين أن وكلاء الذكاء الاصطناعى هم متكيفون ويتعلمون باستمرار. تتضمن التطبيقات الرئيسية لمساعدي الذكاء الاصطناعى chatbots ومكالمة المعلومات ، لكن مجالات تطبيق وكلاء الذكاء الاصطناعى تشمل أتمتة العملية ، والكشف عن الاحتيال ، وحل المشكلات المعقدة. يتطلب التفاعل مع الأشخاص مدخلات ثابتة لمساعد الذكاء الاصطناعي ، في حين أن الحد الأدنى من التدخل البشري ضروري فقط لوكلاء الذكاء الاصطناعي.

غرفة الماكينة: التعلم الآلي ، نماذج صوتية كبيرة (LLMS) والنماذج الأساسية

التعلم الآلي (ML)

التعلم الآلي هو منطقة فرعية من الذكاء الاصطناعي التي تتعلم فيها أجهزة الكمبيوتر من البيانات والتحسن مع الخبرة دون أن تكون مبرمجة بشكل صريح. يتم تدريب الخوارزميات على العثور على أنماط في مجموعات البيانات الكبيرة ولتخذ القرارات والتنبؤات بناءً على هذا. تتضمن نماذج ML التعلم المراقب (التعلم من البيانات الملحوظة) ، والتعلم الذي لا يمكن التغلب عليه (إيجاد أنماط في البيانات غير المميزة) ، والتعلم المراقب جزئيًا (مزيج من البيانات الملحوظة وغير المميزة) وتعزيز التعلم (التعلم من خلال التجارب مع المكافآت). ML يزيد من الكفاءة ، يقلل من الأخطاء ويدعم اتخاذ القرار في الشركات.

إن فهم الأنواع المختلفة من التعلم الآلي ليس مهمًا للمديرين فقط من وجهة نظر فنية ، ولكن أيضًا لفهم متطلبات البيانات. يتطلب التعلم المراقب ، على سبيل المثال ، كميات كبيرة من سجلات البيانات العالية ذات الجودة العالية ، والتي لها تأثير على استراتيجية البيانات والاستثمارات. على الرغم من أن تحديد مشكلة العمل يجب أن يكون في البداية ، فإن قابلية تطبيق نوع ML معين سيعتمد اعتمادًا كبيرًا على توفر ونوع البيانات.

نماذج صوتية كبيرة (LLMS)

النماذج الصوتية الكبيرة هي نوع من خوارزمية التعلم العميق التي يتم تدريبها في سجلات البيانات الضخمة وغالبًا ما تستخدم في تطبيقات معالجة اللغة الطبيعية (NLP) للرد على الاستفسارات في اللغة الطبيعية. أمثلة على هذا هي سلسلة GPT من Openai. يمكن لـ LLMS إنشاء نصوص شبيهة بشري ، وقيادة chatbots ودعم خدمة العملاء الآلية. ومع ذلك ، يمكنك أيضًا تولي عدم الدقة والتشوهات من بيانات التدريب وزيادة المخاوف بشأن حقوق الطبع والنشر والأمن.

إن مشكلة "الحفظ" في LLMS ، والتي تقوم فيها بإخراج النص حرفيًا من بيانات التدريب ، وتأمل حقوق الطبع والنشر والانتحال الكبيرة للشركات التي تستخدم المحتوى الذي تم إنشاؤه بواسطة LLM. هذا يتطلب عمليات مراجعة دقيقة وفهم أصل إصدارات LLM.

نماذج قاعدة

النماذج الأساسية هي نماذج كبيرة من الذكاء الاصطناعى التي تم تدريبها على بيانات واسعة ويمكن تكييفها (ضبطها) لمجموعة متنوعة من المهام المصب. تتميز بالظهور (المهارات غير المتوقعة) والتجانس (العمارة المشتركة). إنها تختلف عن نماذج الذكاء الاصطناعى الكلاسيكية من حيث أنها في البداية محددة محلية ، وتستخدم التعلم الذاتي ، وتمكين التعلم النقل وغالبًا ما تكون متعددة الوسائط (معالجة النص ، الصورة ، الصوت). LLMS هي نوع من النموذج الأساسي. تشمل المزايا الوصول بشكل أسرع للوصول إلى الأسواق وقابلية التوسع ، ولكن التحديات هي الشفافية (مشكلة "الصندوق الأسود") ، وحماية البيانات والتكاليف المرتفعة أو متطلبات البنية التحتية.

يشير صعود النماذج الأساسية إلى تغيير نحو أكثر من الذكاء الاصطناعي متعدد الاستخدامات وأكثر قابلية للتكيف. ومع ذلك ، فإن طبيعتك "الصندوق الأسود" والموارد الكبيرة الضرورية لتدريبك أو صقلك تعني أنه يمكن تركيز الوصول والتحكم ، مما يخلق تبعيات محتملة على عدد قليل من مقدمي الخدمات الكبار. هذا له آثار استراتيجية على قرارات "Make-Or-Buy" وخطر قفل البائع. تفتح القدرة المتعددة الوسائط للعديد من النماذج الأساسية فئات جديدة تمامًا من التطبيقات التي يمكنها توليف النتائج من أنواع البيانات المختلفة (مثل تحليل تقارير النص مع تسجيلات الكاميرا المراقبة). يتجاوز هذا النص الذي يمكن أن يفعله LLMs المركز ويتطلب تفكيرًا أوسع في قواعد البيانات المتاحة.

البوصلة التنظيمية: التنقل من خلال الظروف الإطار القانونية والأخلاقية

قانون الاتحاد الأوروبي KI: الأحكام الأساسية والآثار للشركات

يعد قانون الاتحاد الأوروبي KI ، الذي دخل حيز التنفيذ في 1 أغسطس 2024 ، أول قانون شامل في العالم ويؤسس نظام تصنيف قائم على المخاطر لمنظمة العفو الدولية.

فئات المخاطر:

- المخاطر غير المقبولة: تحظر أنظمة الذكاء الاصطناعي التي تمثل تهديدًا واضحًا للأمن وسبل العيش والحقوق. ومن الأمثلة على ذلك التسجيل الاجتماعي من قبل السلطات العامة ، والتلاعب المعرفي بالسلوك والقراءة غير المرغوب فيها للصور الوجه. تدخل معظم هذه الحظر حيز التنفيذ حتى 2 فبراير 2025.

- المخاطر العالية: أنظمة الذكاء الاصطناعى التي تؤثر سلبا على الأمن أو الحقوق الأساسية. هذه تخضع لمتطلبات صارمة ، بما في ذلك أنظمة إدارة المخاطر ، وحوكمة البيانات ، والوثائق الفنية ، والإشراف على الإنسان وتقييمات المطابقة أمام السوق. ومن الأمثلة على ذلك الذكاء الاصطناعي في البنى التحتية الحرجة والأجهزة الطبية والعمالة وإنفاذ القانون. تنطبق معظم قواعد الذكاء الاصطناعي عالية الخطورة اعتبارًا من 2 أغسطس 2026.

- المخاطر المحدودة: يجب أن تفي أنظمة الذكاء الاصطناعى مثل chatbots أو تلك التي تنشئ أوراقًا عميقة من التزامات الشفافية وإبلاغ المستخدمين بأنهم يتفاعلون مع الذكاء الاصطناعي أو أن المحتوى الذي تم إنشاؤه.

- الحد الأدنى من المخاطر: أنظمة الذكاء الاصطناعي مثل مرشحات البريد العشوائي أو ألعاب الفيديو القائمة على الذكاء الاصطناعي. يسمح القانون بالاستخدام المجاني ، على الرغم من تشجيع المهارات السلوكية الطوعية.

مناسب ل:

يحدد القانون التزامات مقدمي الخدمات والمستوردين والتجار والمستخدمين (المشغلين) لأنظمة الذكاء الاصطناعى ، حيث يخضع مقدمو الأنظمة ذات الخطورة العالية للمتطلبات الأكثر صرامة. نظرًا للتطبيق الإقليمي خارج الأرض ، فإنه يؤثر أيضًا على الشركات خارج الاتحاد الأوروبي إذا تم استخدام أنظمة الذكاء الاصطناعى الخاصة بهم في سوق الاتحاد الأوروبي. تنطبق قواعد محددة على نماذج الذكاء الاصطناعي ذات الغرض العام (نماذج GPAI) ، مع التزامات إضافية لأولئك الذين يتم تصنيفهم على أنهم "مخاطر منهجية". تنطبق هذه القواعد عمومًا من 2 أغسطس ، 2025. إذا كانت عدم الامتثال ، فهناك غرامات كبيرة ، ما يصل إلى 35 مليون يورو أو 7 ٪ من دوران السنوي العالمي للتطبيقات المحظورة. من فبراير 2025 ، تحدد المادة 4 أيضًا مستوى مناسبًا من كفاءة الذكاء الاصطناعي لموظفي مقدمي الخدمات ومشغلي بعض أنظمة الذكاء الاصطناعى.

يتطلب النهج القائم على المخاطر لقانون الاتحاد الأوروبي لمنظمة العفو الدولية تغييرًا أساسيًا في نهج الشركات لتطوير واستخدام الذكاء الاصطناعي. لم يعد الأمر يتعلق فقط بالجدوى التقنية أو القيمة التجارية ؛ يجب دمج الامتثال التنظيمي والحد من المخاطر من بداية دورة حياة الذكاء الاصطناعي ("الامتثال حسب التصميم"). "التزام كفاءة الذكاء الاصطناعي" هو قرار مهم ومبكر. هذا يعني حاجة فورية للشركات لتقييم وتنفيذ برامج التدريب ، ليس فقط للفرق الفنية ، ولكن لأي شخص يقوم بتطوير أو يستخدم أو يراقب أنظمة الذكاء الاصطناعي. هذا يتجاوز الوعي الأساسي ويشمل فهم الوظائف والحدود وكذلك الإطار الأخلاقي والقانوني. يشير تركيز القانون على نماذج GPAI ، وخاصة تلك المعرضة للخطر الجهازي ، إلى وجود قلق تنظيمي بشأن التأثيرات الواسعة وغير المتوقعة لهذه النماذج القوية المتنوعة. تخضع الشركات التي تستخدم أو تطوير مثل هذه النماذج لفحص مكثف والالتزامات ، مما يؤثر على خطط التنمية والاستراتيجيات التمهيدية في السوق.

نظرة عامة على فئات المخاطر لقانون الاتحاد الأوروبي KI والالتزامات الأساسية

يلخص هذا الجدول الهيكل الأساسي لقانون الاتحاد الأوروبي KI ويساعد المديرين على التعرف بسرعة على الفئة التي يمكن أن تندرج أنظمة الذكاء الاصطناعي الخاصة بهم في وفهم تحميل وجداول الامتثال المقابلة.

تُظهر نظرة عامة على فئات المخاطر لقانون الاتحاد الأوروبي KI أن الأنظمة ذات المخاطر غير المقبولة ، مثل التسجيل الاجتماعي ، والتلاعب المعرفي والتجشير غير المشترك لصور الوجه ، محظورة تمامًا وقد لا يتم تطبيقها من فبراير 2025. التزامات واسعة. من بين أشياء أخرى ، يجب أن يكون لدى مقدمي الخدمات والمشغلين نظام لإدارة المخاطر ، وإدارة جودة البيانات والوثائق الفنية ، وضمان الشفافية ، وضمان الإشراف البشري وتلبية معايير مثل المتانة والدقة وتقييم الأمن السيبراني وتقييم المطابقة. تدخل التدابير المقابلة حيز التنفيذ اعتبارًا من أغسطس 2026 ، جزئياً من أغسطس 2027. تتعلق المخاطر المحدودة بتطبيقات الذكاء الاصطناعى مثل chatbots وأنظمة الكشف عن المشاعر وأنظمة التصنيف البيومترية وأعمق. تعتبر التزامات الشفافية ، مثل وضع العلامات كنظام الذكاء الاصطناعي أو المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعى ، فعالة اعتبارًا من أغسطس 2026. لا توجد التزامات محددة لتطبيقات الذكاء الاصطناعى مع الحد الأدنى من المخاطر ، مثل مرشحات البريد العشوائي أو ألعاب الفيديو المدعومة من الذكاء الاصطناعي ، مع موصى بها. يمكن استخدام هذه الأنظمة على الفور.

حقل الجهد لالتزام حساب الابتكار: ابحث عن التوازن الصحيح

يجب على الشركات إتقان مجال التوتر بين الترويج لابتكار الذكاء الاصطناعي وضمان المساءلة وحماية البيانات (GDPR) والاستخدام الأخلاقي. تعتبر مبادئ الناتج المحلي الإجمالي (الشرعية ، والعدالة ، والشفافية ، وربط الغرض ، وتقليل البيانات ، والصحة ، والمساءلة) أمرًا أساسيًا في الذكاء الاصطناعي المسؤول والتأثير على كيفية تطوير أنظمة الذكاء الاصطناعى واستخدامها. تشمل استراتيجيات التوازن التكامل المبكر لفرق الامتثال وحماية البيانات ، ومراجعات منتظمة ، واستخدام الخبرة الخارجية واستخدام أدوات الامتثال المتخصصة. لا يعتبر البعض المبادئ التوجيهية التنظيمية بمثابة فرامل ابتكار ، ولكن بصفتها مسرعًا يبني الثقة ويزيد من قبول التقنيات الجديدة.

"مجال توتر الابتكار التزام إلزامي" ليس حل وسط ثابت ، ولكنه توازن ديناميكي. الشركات التي تضمنت المساءلة والاعتبارات الأخلاقية في دورة ابتكار الذكاء الاصطناعى لها أكثر عرضة لبناء حلول AI مستدامة وجديرة بالثقة. هذا في النهاية يعزز الابتكارات الرئيسية من خلال تجنب التعديل التحديثي المكلف أو تلف السمعة أو العقوبات التنظيمية. يتم تعزيز التحدي المتمثل في الحفاظ على المساءلة من خلال التعقيد المتزايد وطبيعة "الصندوق الأسود" المحتملة لنماذج الذكاء الاصطناعى المتقدمة (كما تمت مناقشتها في النماذج الأساسية). وهذا يتطلب تركيزًا أقوى على تقنيات التوضيح (XAI) وآليات التدقيق القوية لضمان فهم القرارات التي اتخذتها الذكاء الاصطناعى وتبريرها وتجاوزها إذا لزم الأمر.

🎯📊 دمج منصة AI مستقلة وعلى مستوى المصدر 🤖🌐 لجميع مسائل الشركة

Ki-GameChanger: الحلول الأكثر مرونة في منصة الذكاء الاصطناعي التي تقلل من التكاليف ، وتحسين قراراتها وزيادة الكفاءة

منصة الذكاء الاصطناعى المستقلة: يدمج جميع مصادر بيانات الشركة ذات الصلة

- يتفاعل منصة الذكاء الاصطناعى مع جميع مصادر البيانات المحددة

- من SAP و Microsoft و JIRA و Confluence و Salesforce و Zoom و Dropbox والعديد من أنظمة إدارة البيانات الأخرى

- تكامل FAST AI: حلول الذكاء الاصطناعى المصممة خصيصًا للشركات في ساعات أو أيام بدلاً من أشهر

- البنية التحتية المرنة: قائمة على السحابة أو الاستضافة في مركز البيانات الخاص بك (ألمانيا ، أوروبا ، اختيار مجاني للموقع)

- أعلى أمن البيانات: الاستخدام في شركات المحاماة هو الدليل الآمن

- استخدم عبر مجموعة واسعة من مصادر بيانات الشركة

- اختيار نماذج الذكاء الاصطناعي الخاصة بك أو مختلف (DE ، الاتحاد الأوروبي ، الولايات المتحدة الأمريكية ، CN)

التحديات التي تحلها منصة الذكاء الاصطناعى

- عدم دقة حلول الذكاء الاصطناعي التقليدية

- حماية البيانات والإدارة الآمنة للبيانات الحساسة

- ارتفاع التكاليف وتعقيد تطوير الذكاء الاصطناعي الفردي

- عدم وجود منظمة العفو الدولية المؤهلة

- دمج الذكاء الاصطناعي في أنظمة تكنولوجيا المعلومات الحالية

المزيد عنها هنا:

استراتيجيات الذكاء الاصطناعي للمديرين: إرشادات عملية وأمثلة

الذكاء الاصطناعى في العمل: التطبيقات والتطبيقات والتفاعل الفعال

التعرف على الفرص: تطبيقات الذكاء الاصطناعي والتطبيقات عبر الصناعات

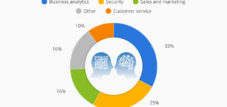

تقدم KI مجموعة واسعة من التطبيقات ، بما في ذلك إنشاء المحتوى ، ونهج العملاء المخصصين ، وتحسين العملية في الإنتاج والخدمات اللوجستية ، والصيانة ذات المظهر الأمامي ، وكذلك الدعم في التمويل والموارد البشرية وتكنولوجيا المعلومات.

تشمل أمثلة الصناعة المحددة:

- السيارات/الإنتاج: الذكاء الاصطناعي والمحاكاة في البحث (Arena2036) ، تفاعل الروبوت الآلي (FESTO) ، تحسين العملية والصيانة التنبؤية في الإنتاج (BOSCH).

- الخدمات المالية: زيادة الأمان من خلال تحليل كميات كبيرة من البيانات حول المعاملات المشبوهة والفاتورة الآلية وتحليل الاستثمار.

- الرعاية الصحية: تشخيصات أسرع ، الوصول الموسع إلى الرعاية (مثل تفسير الصور الطبية) ، تحسين الأبحاث الصيدلانية.

- الاتصالات السلكية واللاسلكية: تحسين أداء الشبكة ، والتحسينات السمعية البصرية ، والوقاية من ترحيل العملاء.

- التجزئة/التجارة الإلكترونية: توصيات مخصصة ، chatbots لخدمة العملاء ، عمليات أمين الصندوق الآلية.

- التسويق والمبيعات: إنشاء المحتوى (ChatGPT ، Canva) ، حملات محسنة ، تجزئة العملاء ، توقعات المبيعات.

في حين أن العديد من التطبيقات تهدف إلى الأتمتة والكفاءة ، فإن الاتجاه الناشئ المهم هو دور الذكاء الاصطناعى عند تحسين القرار البشري -اتخاذ القرارات البشرية وتمكين أشكال جديدة من الابتكار (مثل تطوير العقاقير ؛ تطوير المنتج). يجب أن ينظر المديرون إلى ما وراء تخفيضات التكاليف من أجل تحديد خيارات النمو والابتكار التي تحركها الذكاء الاصطناعي. غالبًا ما تتضمن تطبيقات الذكاء الاصطناعى الأكثر نجاحًا دمج الذكاء الاصطناعي في العمليات والأنظمة الأساسية الحالية (على سبيل المثال ، يستخدم SAP KI في برامج الشركات ، Microsoft 365 Copilot) بدلاً من التعامل مع الذكاء الاصطناعي كتقنية مستقلة معزولة. هذا يتطلب رؤية شاملة لهندسة الشركة.

مناسب ل:

- الذكاء الاصطناعي: خمس استراتيجيات رئيسية للتكامل الناجح لتحويل الذكاء الاصطناعي لإدارة الشركات المستدامة

إتقان الحوار: المطالبة الفعالة ل AI التوليدي

على الفور ، فإن الهندسة هي عملية تكرارية تسيطر عليها الاختبار لتحسين إخراج النموذج الذي يتطلب أهدافًا واضحة واختبارًا منهجيًا. تعتمد المطالبات الفعالة على كل من المحتوى (التعليمات ، الأمثلة ، السياق) والهيكل (الترتيب ، وضع العلامات ، الفاصل).

المكونات المهمة لمطالبة هي: الهدف/المهمة ، والتعليمات ، والقيود (ما يجب القيام به/للقيام به) ، والصوت/النمط ، وبيانات السياق/الخلفية ، وأمثلة قليلة ، وطلب التبرير (على الرغم من أن سلسلة من السلسلة) وتنسيق الرد المطلوب.

تشمل أفضل الممارسات:

- حدد أهدافًا واضحة واستخدم أفعال العمل.

- توفير السياق والمعلومات الأساسية.

- تحديد المجموعة المستهدفة بالضبط.

- الذكاء الاصطناعى يقول ما لا ينبغي أن تفعل.

- صياغة موجه ، بإنتاجه ، موجزة وباختيار دقيق للكلمات.

- إضافة حدود الإخراج ، وخاصة لكتابة مهام.

- قم بتعيين دور (على سبيل المثال "أنت مدرس للرياضيات").

- يمكن للسلاسل الفوري (استخدام موجه مترابط) إنشاء أفكار مستمرة.

المطالبة الفعالة هي أقل البحث عن "موجه مثالي" واحد من تطوير نهج استراتيجي للتفاعل مع LLMs. ويشمل ذلك فهم المهارات النموذجية ، والتحسين التكراري للمطالبات بناءً على الإخراج واستخدام التقنيات مثل تخصيص الأدوار وسلسلة من أجل قيادة الذكاء الاصطناعي إلى النتائج المرجوة. إنها قدرة تتطلب ممارسة الرياضة والتفكير النقدي. القدرة على توفير السياق ذي الصلة وتحديد القيود هي ذات أهمية قصوى للحصول على نتائج قيمة من Genai. هذا يعني أن جودة المحتوى الناتج عن الذكاء الاصطناعى غالبًا ما تتناسب بشكل مباشر مع جودة وخصوصية المدخلات البشرية ، والتي تؤكد الأهمية المستمرة للخبرة البشرية في هذه العملية.

أفضل الممارسات لإنشاء مطالبات AI فعالة

يقدم هذا الجدول نصيحة عملية وقابلة للتنفيذ يمكن للمديرين والمتخصصين التقدم فورًا لتحسين تفاعلاتهم مع أدوات الذكاء الاصطناعي.

من أجل تحقيق نتائج قيمة في استخدام الذكاء الاصطناعى التوليدي ، من الأهمية بمكان معالجة بشكل خاص وواضح ، لتحديد الهدف بدقة واستخدام أفعال الإجراء ، مثل "إنشاء قائمة نقاط رئيسية تلخص أهم نتائج الورقة". من المهم بنفس القدر توفير السياق ، على سبيل المثال من خلال تسليم المعلومات الأساسية والبيانات ذات الصلة مثل "بناءً على التقرير المالي ، تحليل ربحية السنوات الخمس الماضية". يجب توضيح المجموعة المستهدفة والصوت المطلوب بوضوح ، مثل "كتابة وصف منتج للشباب البالغين الذين يقدرون الاستدامة". يمكن أيضًا تعيين منظمة العفو الدولية دورًا أو شخصية محددة ، على سبيل المثال "أنت خبير في التسويق. Desort A Campaign for ...". بمساعدة أمثلة قليلة ، مثل "الإدخال: Apple. الإخراج: الفاكهة. الإدخال: carrow. الإخراج:" ، يمكن توضيح تنسيق الإخراج المطلوب بشكل أفضل. إن التنسيق الدقيق للإجابات معقول أيضًا لتحديد كيفية "تنسيق إجابتك في تخفيض التنفيذ". القيود مثل "تجنب المصطلحات التقنية. لا ينبغي أن تكون الإجابة أكثر من 200 كلمة" تساعد على تحسين الإخراج. النهج التكراري ، الذي يتم تكييف المطالبة وتكييفه بناءً على النتائج السابقة ، يزيد من الجودة. أخيرًا ، يمكن استخدام السلسلة من خلال الأفكار (على الرغم من أن سلسلة من الذكاء الاصطناعي) من خلال مطالبة الذكاء الاصطناعى لشرح عملية تفكيرها خطوة بخطوة ، مثل "شرح خطوة خطوة بخطوة".

معالجة الذكاء الاصطناعي غير المرئي: فهم وإدارة تطبيقات الظل (الظل AI)

يشير Schadten-KI إلى الاستخدام غير المصرح به أو غير المنظم لأدوات الذكاء الاصطناعى من قبل الموظفين ، وغالبًا لزيادة الإنتاجية أو لتجنب العمليات الرسمية البطيئة. إنها فئة فرعية من الظل.

مخاطر الظل كي:

- أمان البيانات وحماية البيانات: يمكن أن تؤدي الأدوات غير المصرح لها إلى انتهاكات حماية البيانات ، والكشف عن البيانات العامة/الشركة المملوكة الحساسة وغير المملوكة للناتج المحلي الإجمالي/HIPAA.

- الامتثال والقانون: انتهاكات قوانين حماية البيانات ، مشاكل حقوق الطبع والنشر ، تتعارض مع حرية المعلومات. إن طلب "كفاءة الذكاء الاصطناعي" لقانون الاتحاد الأوروبي KI من فبراير 2025 يجعل الحجة بشكل عاجل.

- اقتصاديًا/تشغيليًا: الهياكل الموازية غير الفعالة ، والتكاليف الخفية من خلال الاشتراكات الفردية ، والافتقار إلى السيطرة على التراخيص ، وعدم التوافق مع الأنظمة الحالية ، وتعطيل عمليات العمل ، وتقليل الكفاءة.

- الجودة والتحكم: نقص الشفافية في معالجة البيانات ، وإمكانية تحقيق نتائج متحيزة أو مضللة ، وتآكل الثقة العامة/الداخلية.

- تقويض الحوكمة: تجاوز حكومة تكنولوجيا المعلومات ، مما يجعل من الصعب فرض إرشادات الأمن.

استراتيجيات لإدارة Schadten-Ki:

- تطوير استراتيجية واضحة من الذكاء الاصطناعى وإنشاء مبادئ توجيهية مسؤولة من الذكاء الاصطناعي.

- توفير أدوات AI الرسمية المعتمدة كبدائل.

- تعريف إرشادات واضحة لاستخدام الذكاء الاصطناعي ومعالجة البيانات والأدوات المعتمدة.

- تدريب وتوعية الموظفين عن استخدام الذكاء الاصطناعي المسؤول والمخاطر وأفضل الممارسات.

- تنفيذ عمليات تدقيق منتظمة للكشف عن الذكاء الاصطناعي غير المصرح بها وضمان الامتثال.

- قبول نهج حكومي من الذكاء الاصطناعى التزايدي ، بدءا من خطوات صغيرة وصقل الإرشادات.

- تعزيز التعاون المتقاطع ومشاركة الموظفين.

غالبًا ما يكون Schadten-KI من أعراض احتياجات المستخدم غير المحققة أو العمليات البيروقراطية المفرطة في إدخال التكنولوجيا. يمكن أن يؤدي نهج تقييدي بحت ("لا سمح لمنظمة العفو الدولية") إلى نتائج عكسية. تتطلب الإدارة الفعالة فهم الأسباب وتوفير بدائل عملية وآمنة بالإضافة إلى الحوكمة الواضحة. من المحتمل أن يكون صعود أدوات Genai التي يمكن الوصول إليها بسهولة (مثل ChatGPT) تسريع انتشار Schatten-KI. يمكن للموظفين استخدام هذه الأدوات بسرعة دون مشاركة تكنولوجيا المعلومات. وهذا يجعل التدريب الاستباقي على الكفاءة من الذكاء الاصطناعي (كما هو مطلوب بموجب قانون الاتحاد الأوروبي KI) والتواصل الواضح عبر الأدوات المعتمدة أكثر أهمية.

مخاطر الظل من الذكاء الاصطناعي وردود الفعل الاستراتيجية

يقدم هذا الجدول نظرة عامة منظمة على التهديدات المتنوعة من استخدام الذكاء الاصطناعي غير المنظم والاستراتيجيات الملموسة والقابلة للتنفيذ للمديرين.

يحمل Shadow AI العديد من المخاطر التي يتعين على الشركات مواجهتها استراتيجياً. يمكن أن تحدث تسرب البيانات ، والوصول غير المصرح به إلى المعلومات الحساسة أو التهابات البرامج الضارة في مجال أمان البيانات. تتضمن التدابير الاستراتيجية إدخال مبادئ توجيهية لاستخدام الذكاء الاصطناعى ، وإنشاء قائمة بالأدوات المعتمدة ، واستخدام التشفير ، وتنفيذ ضوابط الوصول الصارمة وتدريب الموظفين. فيما يتعلق بمخاطر الامتثال ، مثل انتهاكات الناتج المحلي الإجمالي ، وانتهاكات لوائح الصناعة أو انتهاك حقوق الطبع والنشر ، ومراجعات منتظمة ، وتسلسلات حماية البيانات القائمة على البيانات (DSFA) للأدوات الجديدة ، والمبادئ التوجيهية المحددة بوضوح لمعالجة البيانات ، وإذا لزم الأمر ، فإن المشورة القانونية ضرورية. تنشأ المخاطر المالية من نفقات غير خاضعة للرقابة للاشتراكات أو التراخيص الزائدة أو عدم الكفاءة. لذلك ، يجب على الشركات الاعتماد على المشتريات المركزية ، والتحكم الصارم للميزانية والمراجعة المنتظمة لاستخدام الأدوات. يمكن إتقان التحديات الجراحية مثل النتائج غير المتناسقة ، وعدم التوافق مع أنظمة الشركة الحالية أو اضطرابات العمليات من خلال توفير أدوات موحدة ، وتكاملها في سير العمل الحالي وضغط الجودة المستمر. أخيرًا ، تشكل مخاطر السمعة خطرًا ، على سبيل المثال فقدان ثقة العملاء نتيجة لتفاصيل البيانات أو الاتصالات غير الصحيحة التي تم إنشاؤها. تعد التواصل الشفاف ، والامتثال لإرشادات الأخلاقيات وخطة الاستجابة المدروسة للحوادث ، تدابير حاسمة للحفاظ على الثقة في الشركة وتقليل الأضرار المحتملة.

🎯🎯🎯 استفد من خبرة Xpert.Digital الواسعة والخماسية في حزمة خدمات شاملة | البحث والتطوير، XR، العلاقات العامة والتسويق عبر محرك البحث

آلة العرض ثلاثية الأبعاد AI وXR: خبرة خمسة أضعاف من Xpert.Digital في حزمة خدمات شاملة، R&D XR، PR وSEM - الصورة: Xpert.Digital

تتمتع Xpert.Digital بمعرفة متعمقة بمختلف الصناعات. يتيح لنا ذلك تطوير استراتيجيات مصممة خصيصًا لتناسب متطلبات وتحديات قطاع السوق المحدد لديك. ومن خلال التحليل المستمر لاتجاهات السوق ومتابعة تطورات الصناعة، يمكننا التصرف ببصيرة وتقديم حلول مبتكرة. ومن خلال الجمع بين الخبرة والمعرفة، فإننا نولد قيمة مضافة ونمنح عملائنا ميزة تنافسية حاسمة.

المزيد عنها هنا:

كيفية تحويل القيادة والتعاون وتعزيز المهارات اللينة في القيادة: الميزة الإنسانية في عصر الذكاء الاصطناعي

كيفية تحويل القيادة والتعاون وتعزيز المهارات اللينة في القيادة: الميزة الإنسانية في صورة AI Age: Xpert.Digital

العنصر البشري: آثار الذكاء الاصطناعى على القيادة والتعاون والإبداع

تغيير القيادة في عصر الذكاء الاصطناعي: المتطلبات والكفاءات الجديدة

يتطلب الذكاء الاصطناعى تحولًا في القيادة إلى مهارات إنسانية فريدة: الوعي والرحمة والحكمة والتعاطف والتفاهم الاجتماعي والتواصل الشفاف والتفكير النقدي والقدرة على التكيف. يتعين على المديرين تطوير الكفاءة التكنولوجية من أجل اتخاذ قرارات جيدة حول أدوات الذكاء الاصطناعى والفرق القيادية من خلال التغيير. ويشمل ذلك فهم البيانات والتقييم النقدي للمعلومات التي تم إنشاؤها بواسطة الذكاء الاصطناعى.

تشمل أهم مهام الإدارة تعزيز ثقافة اتخاذ القرارات التي تسيطر عليها البيانات ، وإدارة التغيير الفعالة ، والتعامل مع الاعتبارات الأخلاقية من خلال حكومة الذكاء الاصطناعي وتعزيز الابتكار والإبداع. يمكن لمنظمة العفو الدولية تخفيف مديري المهام الروتينية حتى يتمكنوا من التركيز على الجوانب الاستراتيجية والبشرية مثل الدافع وتنمية الموظفين. قد ينشأ الدور الجديد لـ "كبير موظفي الابتكار والتحول" (CITO) ، والذي يجمع بين الخبرة الفنية ومعرفة السلوك والرؤية الاستراتيجية. يتعين على المديرين التنقل في المناظر الطبيعية الأخلاقية المعقدة ، وتعزيز التحولات الثقافية ، وإدارة التعاون بين الأشخاص و AI ، وقيادة التكامل الوظيفي وضمان الابتكار المسؤول.

التحدي الأساسي للمديرين في عصر الذكاء الاصطناعي ليس فقط لفهم الذكاء الاصطناعي ، ولكن أيضًا لقيادة رد الفعل البشري على الذكاء الاصطناعي. ويشمل ذلك زراعة ثقافة التعلم ، والتعامل مع المخاوف قبل فقدان العمل وحدوث استخدام الذكاء الاصطناعي الأخلاقي ، مما يجعل المهارات اللينة أكثر أهمية من أي وقت مضى. هناك تباين محتمل في تصور العلاقات الشخصية في عصر الذكاء الاصطناعي: 82 ٪ من الموظفين يعتبرونهم ضروريين ، مقارنة بـ 65 ٪ فقط من المديرين. يمكن أن تؤدي هذه الفجوة إلى استراتيجيات قيادة تستثمر القليل جدًا في الروابط البشرية وتضعف الأخلاق والتعاون. يتضمن إرشادات الذكاء الاصطناعى الفعالة مجموعة قدرة متناقضة: قبول الموضوعية التي تسيطر عليها البيانات من قبل الذكاء الاصطناعى مع تعزيز الحكم الإنساني الشخصي والحدس والحجة الأخلاقية. إنه يتعلق بتوسيع الذكاء البشري ، وعدم صنع الذكاء الاصطناعي.

مناسب ل:

تحول العمل الجماعي: تأثير الذكاء الاصطناعى على التعاون وديناميات الفريق

يمكن لمنظمة العفو الدولية تحسين العمل الجماعي من خلال أتمتة المهام الروتينية وتمكين الموظفين من التركيز على العمل الاستراتيجي والإبداعي. يمكن أن تدعم أنظمة الذكاء الاصطناعى اتخاذ القرارات بشكل أفضل من خلال تحليل البيانات وإعطاء الفرق. يمكن أن تعزز أدوات الذكاء الاصطناعى التواصل والتنسيق بشكل أفضل ، وتمكين التعاون في الوقت الفعلي وتبادل المعلومات والموارد. يمكن لإدارة المعرفة القائمة على الذكاء الاصطناعي تسهيل الوصول إلى المعرفة المركزية ، وتمكين عمليات البحث الذكية وتعزيز تبادل المعرفة. يمكن أن يؤدي الجمع بين المهارات الإبداعية البشرية والحكم والذكاء العاطفي مع تحليل البيانات ومهارات الأتمتة في الذكاء الاصطناعي إلى عمل أكثر كفاءة وأساليع.

تشمل التحديات ضمان حماية البيانات ومعالجة البيانات الأخلاقية في أدوات الذكاء الاصطناعى التعاونية ، وإمكانية "فقدان الكفاءة" بين الموظفين إذا كانت الذكاء الاصطناعي قد اتخذت الكثير من المهام دون استراتيجية لمزيد من التأهيل ، والخوف من أن تصبح الاتصالات الشخصية أقل شيوعًا.

على الرغم من أن الذكاء الاصطناعي يمكن أن يحسن كفاءة التعاون (مثل شراء المعلومات بشكل أسرع ، وأتمتة المهام) ، يجب على المديرين العمل بنشاط للحفاظ على جودة التفاعل البشري وتماسك الفريق. هذا يعني تصميم عمليات العمل بطريقة تستكملها أعضاء فريق الذكاء الاصطناعي بدلاً من المعزولة ويخلق فرصًا للتوصيلات البشرية الحقيقية. يعتمد التكامل الناجح لـ AI في العمل الجماعي بشدة على ثقة الثقة في موثوقية وإنصاف التكنولوجيا وكذلك الثقة بين أعضاء الفريق في كيفية استخدام المعرفة القائمة على الذكاء الاصطناعي. يمكن أن يؤدي الافتقار إلى الثقة إلى المقاومة ويخضع لعملية تعاونية.

منظمة العفو الدولية كشريك إبداعي: التوسع وإعادة تعريف الإبداع في المنظمات

يمكن لـ AI التوليدي ، إذا تم تقديمه بشكل استراتيجي وبعناية ، أن يخلق بيئة تتعايش فيها الإبداع الإنساني و AI ويعملون معًا. يمكن لمنظمة العفو الدولية تعزيز الإبداع من خلال العمل كشريك ، وتقديم وجهات نظر جديدة وتحويل حدود الممكنة في مجالات مثل الوسائط والفن والموسيقى. يمكن لمنظمة العفو الدولية أتمتة الأسهم الروتينية للعمليات الإبداعية وبالتالي إطلاق الناس للحصول على مزيد من العمل المفاهيمي والمبتكرة. يمكن أن يساعد أيضًا في التعرف على الاتجاهات الجديدة أو تسريع تطوير المنتج من خلال التجارب القائمة على الذكاء الاصطناعي.

تنشأ المعضلة الأخلاقية والتحديات من حقيقة أن المحتوى الذي تم إنشاؤه من الذكاء الاصطناعى يشكك في الأفكار التقليدية عن التأليف والأصالة والاستقلالية والنية. يعد استخدام البيانات المحمية بحقوق الطبع والنشر لتدريب نماذج الذكاء الاصطناعى وتوليد المحتوى القانوني المحتملة مخاوف كبيرة. بالإضافة إلى ذلك ، هناك خطر من الاعتماد المفرط على الذكاء الاصطناعى ، والتي يمكن أن تقمع الاستكشاف الإبداعي البشري المستقل وتنمية الكفاءة على المدى الطويل.

إن دمج الذكاء الاصطناعى في العمليات الإبداعية ليس فقط مسألة أدوات جديدة ، ولكن أيضًا إعادة تعريف أساسية للإبداع نفسها ، وهي نموذج لخلق الإنسان KI-ko. هذا يتطلب تغييرًا في عقلية المهنيين المبدعين ومديريهم الذين أكدوا على العمل مع الذكاء الاصطناعي كطريقة جديدة. تعني الاعتبارات الأخلاقية المتعلقة بالمحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعى (التأليف ، التحيز ، DeepFakes) أنه لا يمكن للمنظمات ببساطة تولي أدوات AI الإبداعية دون إرشادات أخلاقية قوية والإشراف. يجب على المديرين التأكد من استخدام الذكاء الاصطناعى بمسؤولية لتوسيع الإبداع ، وليس للخداع أو الانتهاك.

إنشاء ترتيب: تنفيذ حكومة الذكاء الاصطناعى لتحول مسؤول

الحاجة إلى حكومة الذكاء الاصطناعي: لماذا من المهم لشركتها

تضمن حكومة الذكاء الاصطناعي تطوير أنظمة الذكاء الاصطناعى واستخدامها أخلاقيا وشفافية ووفقًا للقيم الإنسانية والمتطلبات القانونية.

أسباب مهمة لحكومة الذكاء الاصطناعي هي:

- الاعتبارات الأخلاقية: يعالج إمكانات القرارات المتحيزة والنتائج غير العادلة ، يضمن الإنصاف والاحترام لحقوق الإنسان.

- الامتثال القانوني والتنظيمي: يضمن الامتثال للقوانين الخاصة بتطوير الذكاء الاصطناعي (مثل قانون الاتحاد الأوروبي KI) ولوائح حماية البيانات الحالية (GDPR).

- إدارة المخاطر: تقدم إطارًا لتحديد وتقييم ومراقبة المخاطر المتعلقة بالوكالة الذكاء الاصطناعى ، مثل فقدان ثقة العملاء ، وفقدان الكفاءة أو عمليات صنع القرار المتحيزة.

- المراقبة: تعزز الشفافية والقدرة على التوضيح في حالة قرارات الذكاء الاصطناعى وتخلق الثقة بين الموظفين والعملاء وأصحاب المصلحة.

- تعظيم القيمة: تأكد من أن استخدام الذكاء الاصطناعى موجه نحو أهداف العمل ويتم تنفيذ مزاياه بشكل فعال.

بدون حوكمة معقولة ، يمكن أن تؤدي الذكاء الاصطناعى إلى أضرار غير مقصودة ، وانتهاكات أخلاقية ، والعقوبات القانونية وأضرار السمعة.

حكومة الذكاء الاصطناعي ليست مجرد وظيفة الامتثال أو الحد من المخاطر ، ولكنها رائدة استراتيجية. من خلال تحديد القواعد الواضحة والمسؤوليات والإرشادات الأخلاقية ، يمكن للمنظمات تعزيز بيئة يمكن أن تزدهر فيها ابتكارات الذكاء الاصطناعى بمسؤولية ، مما يؤدي إلى حلول أكثر استدامة وأكثر جدارة بالثقة. تتناسب الحاجة إلى حكومة الذكاء الاصطناعي بشكل مباشر مع زيادة الاستقلالية والتعقيد لأنظمة الذكاء الاصطناعي. إذا انتقلت المنظمات من مساعدي الذكاء الاصطناعى البسيط إلى وكلاء الذكاء الاصطناعى الأكثر تطوراً والنماذج الأساسية ، فيجب تطوير نطاق وصداقة الحكم أيضًا من أجل مواجهة التحديات الجديدة من حيث الالتزام المحاسبي والشفافية والسيطرة.

أعمال الإطار وأفضل الممارسات لحكومة الذكاء الاصطناعي الفعالة

تتراوح أساليب الحوكمة من غير رسمي (استنادًا إلى قيم الشركات) إلى حلول مخصصة (رد فعل لمشاكل محددة) إلى أعمال إطار شاملة).

أعمال الإطار الرائدة (أمثلة):

- NIST AI Management Management Framework (AI RMF): يركز على دعم المنظمات في السيطرة على المخاطر المتعلقة بالنيابة من خلال وظائف مثل الضرائب والتعيين والقياس والإدارة.

- ISO 42001: يحدد نظام إدارة الذكاء الاصطناعي الشامل يتطلب إرشادات وإدارة المخاطر والتحسين المستمر.

- مبادئ OECD AI: تعزيز التعامل المسؤول عن الذكاء الاصطناعي والتأكيد على حقوق الإنسان والإنصاف والشفافية والمساءلة.

أفضل الممارسات للتنفيذ:

- بناء هياكل الحوكمة الداخلية (مثل أخلاقيات الذكاء الاصطناعي ، مجموعات العمل عبر الوظيفة) مع أدوار ومسؤوليات واضحة.

- تنفيذ نظام التصنيف القائم على المخاطر لتطبيقات الذكاء الاصطناعي.

- ضمان حكومة وإدارة البيانات القوية ، بما في ذلك جودة البيانات وحماية البيانات ومراجعة التشوهات.

- تنفيذ مراجعات الامتثال والمطابقة بناءً على المعايير واللوائح ذات الصلة.

- وصف الإشراف البشري ، وخاصة بالنسبة للأنظمة المعرضة للخطر والقرارات الحرجة.

- دمج أصحاب المصلحة (الموظفين والمستخدمين والمستثمرين) من خلال الاتصالات الشفافة.

- تطوير إرشادات أخلاقية واضحة وتكاملها في دورة تطوير الذكاء الاصطناعي.

- الاستثمار في الدورات التدريبية وإدارة التغيير لضمان فهم وقبول إرشادات الحوكمة.

- ابدأ بالتطبيقات المحددة بوضوح والمشاريع التجريبية ، ثم التحجيم تدريجياً.

- إدارة دليل أنظمة الذكاء الاصطناعى المستخدمة في الشركة.

حكومة الذكاء الاصطناعي الفعالة ليست حل الوحدة. يجب على المؤسسات تكييف الأعمال الإطارية مثل NIST AI RMF أو ISO 42001 مع صناعتها المحددة ، والحجم ، وخطر المخاطر وأنواع الذكاء الاصطناعى الذي يستخدمونه. إن الاستحواذ النظري البحت لإطار عمل بدون تكيف عملي ربما ليس فعالًا. إن "عامل الإنسان" في حكومة الذكاء الاصطناعى هو أمر بالغ الأهمية مثل الجوانب "العملية" و "التكنولوجيا". ويشمل ذلك المهمة الواضحة للمساءلة والتدريب الشامل وتعزيز الثقافة التي تقدر استخدام الذكاء الاصطناعي الأخلاقي والمسؤول. بدون قبول وفهم من جانب الموظفين ، سيفشل حتى إطار الحوكمة الأفضل تصميمًا.

المكونات الرئيسية لإطار حكومي من الذكاء الاصطناعى

يقدم هذا الجدول قائمة مراجعة شاملة وتعليمات للمديرين الذين يرغبون في إنشاء أو تحسين حكومة الذكاء الاصطناعي.

تعد المكونات الرئيسية لإطار حكومي من الذكاء الاصطناعي أمرًا بالغ الأهمية لضمان الاستخدام المسؤول والفعال لمنظمة العفو الدولية. يجب أن تنعكس المبادئ المركزية والإرشادات الأخلاقية على قيم الشركات وتوجيه نفسها نحو حقوق الإنسان والإنصاف والشفافية. يجب تعريف الأدوار والمسؤوليات بوضوح ؛ ويشمل ذلك مجلس أخلاقيات الذكاء الاصطناعى ومديري البيانات والمفحدين النمطين ، حيث يجب تحديد المهام وسلطات صنع القرار والالتزام بالحساب بوضوح. تتطلب إدارة المخاطر الفعالة تحديد وتقييم وتقليل المخاطر ، مثل تلك المحددة على أساس فئات قانون الاتحاد الأوروبي KI. تلعب تقييمات المخاطر المنتظمة وكذلك تطوير ومراقبة استراتيجيات التخفيض دورًا رئيسيًا هنا. تضمن حوكمة البيانات أن الجوانب مثل الجودة وحماية البيانات والأمن والتعرف على التحيز يتم أخذها في الاعتبار ، بما في ذلك الامتثال للناتج المحلي الإجمالي والتدابير ضد التمييز. تتضمن إدارة دورة الحياة النموذجية عمليات موحدة للتطوير والتحقق من الصحة والاستخدام والمراقبة والتكليف وتضع التركيز بشكل خاص على الوثائق والإصدار ومراقبة الأداء المستمر. تعد الشفافية والقدرة على التوضيح ضرورية لضمان تتبع قرارات الذكاء الاصطناعي والكشف عن استخدام الذكاء الاصطناعي. يجب أيضًا ضمان الامتثال للمتطلبات القانونية ، مثل قانون الاتحاد الأوروبي KI و GDPR ، من خلال المراجعات المستمرة وتعديلات العمليات وكذلك التعاون مع الإدارة القانونية. يعزز تدريب وتوحيد الوعي للمطورين والمستخدمين والمديرين فهم قواعد الذكاء الاصطناعي والجوانب الأخلاقية وإرشادات الحوكمة. أخيرًا ، يجب ضمان رد فعل الحادث والعلاج من أجل معالجة أعطال أو انتهاكات أخلاقية أو حوادث أمنية بشكل فعال. ويشمل ذلك طرق الإبلاغ المعمول بها ، وعمليات التصعيد والتدابير التصحيحية التي تتيح التدخل السريع والمستهدف.

مناسب ل:

- السباق في مجال الذكاء الاصطناعي (AI): 7 دول يجب عليك مراقبتها - بما في ذلك ألمانيا - النصائح العشرة الأوائل

خذ زمام المبادرة: الضرورة الاستراتيجية لتحول الذكاء الاصطناعي

زراعة استعداد الذكاء الاصطناعي: دور التعلم المستمر ومزيد من التأهيل

بالإضافة إلى المعرفة المتخصصة ، يحتاج المديرون إلى فهم استراتيجي لمنظمة العفو الدولية من أجل تقدم شركاتهم بشكل فعال. يجب أن يغطي تدريب الذكاء الاصطناعي للمديرين قواعد الذكاء الاصطناعي ، ودراسات الحالة الناجحة ، وإدارة البيانات ، والاعتبارات الأخلاقية ، وتحديد إمكانات الذكاء الاصطناعي في شركتهم الخاصة. من 2 فبراير ، 2025 ، يصف قانون الاتحاد الأوروبي KI (المادة 4) "كفاءة منظمة العفو الدولية" للموظفين المشاركين في تطوير أو استخدام أنظمة الذكاء الاصطناعي. ويشمل ذلك فهم تقنيات الذكاء الاصطناعي ومعرفة التطبيق والتفكير النقدي وظروف الإطار القانونية.

تتضمن مزايا تدريب الذكاء الاصطناعي للمديرين القدرة على إدارة مشاريع الذكاء الاصطناعي ، وتطوير استراتيجيات AI المستدامة ، وتحسين العمليات ، وتأمين المزايا التنافسية وضمان استخدام AI الأخلاقي والمسؤول. يعد الافتقار إلى كفاءة الذكاء الاصطناعي والمهارات عقبة كبيرة أمام تكيف الذكاء الاصطناعي. تتوفر تنسيقات التدريب المختلفة: دورات الشهادات والندوات والدورات عبر الإنترنت والتدريب على التواجد.

لا يعني استعداد الذكاء الاصطناعى الحصول على المهارات الفنية فحسب ، بل يعني أيضًا تعزيز طريقة التفكير في التعلم المستمر والقدرة على التكيف في المنظمة بأكملها. في ضوء التطور السريع لمنظمة العفو الدولية ، يمكن أن يكون التدريب القائم على الأدوات محددة. لذلك ، فإن المعرفة والمهارات الأساسية للتفكير النقدي هي استثمارات أكثر دائمة. يعد "التزام كفاءة الذكاء الاصطناعي" من قانون الاتحاد الأوروبي KI سائقًا تنظيميًا لمزيد من المؤهلات ، ولكن يجب أن ترى المنظمات ذلك على أنها فرصة وليس فقط كحمل امتثال. يتم تجهيز قوة عاملة أكثر من الذكاء الاصطناعي بشكل أفضل لتحديد تطبيقات الذكاء الاصطناعى المبتكرة ، واستخدام الأدوات بفعالية وفهم الآثار الأخلاقية ، مما يؤدي إلى نتائج أفضل من الذكاء الاصطناعي بشكل عام. هناك علاقة واضحة بين عدم وجود مهارات/فهم الذكاء الاصطناعي وانتشار الظل الذكاء الاصطناعي. يمكن أن تقلل الاستثمارات في تكوين الذكاء الاصطناعى الشامل بشكل مباشر من المخاطر المرتبطة باستخدام الذكاء الاصطناعي غير المصرح به من خلال تمكين الموظفين من اتخاذ قرارات مستنيرة ومسؤولة.

فرص ومخاطر توليف: خريطة طريق لقيادة الذكاء الاصطناعي السيادي

تتطلب إدارة تحول الذكاء الاصطناعي فهمًا كليًا لإمكانات التكنولوجيا (الابتكار والكفاءة والجودة) ومخاطرها المتأصلة (الأخلاقية ، قانونًا ، اجتماعيًا).

يشمل التصميم الاستباقي لرحلات الذكاء الاصطناعى في المنظمة قيادة الذكاء الاصطناعي:

- إنشاء حكومة منظمة العفو الدولية القوية على أساس المبادئ الأخلاقية والإطار القانوني مثل قانون الاتحاد الأوروبي KI.

- تعزيز ثقافة التعلم المستمر وكفاءة الذكاء الاصطناعي على جميع المستويات.

- التعرف الاستراتيجي وتحديد أولويات تطبيقات الذكاء الاصطناعي التي توفر قيمة ملموسة.

- تعزيز المواهب البشرية من خلال التركيز على المهارات المكملة بدلاً من استبدال وإدارة الآثار البشرية من الذكاء الاصطناعي.

- تحديات الإدارة الاستباقية مثل Schatten-KI.

الهدف النهائي هو استخدام منظمة العفو الدولية كرائد استراتيجي للنمو المستدام والمزايا التنافسية وفي الوقت نفسه تقليل عيوبها المحتملة. تتجاوز "قيادة الذكاء الاصطناعى السيادي" الإدارة التنظيمية الداخلية وتتضمن فهمًا أوسع للآثار الاجتماعية لمنظمة العفو الدولية ودور الشركة في هذا النظام البيئي. وهذا يعني المشاركة في المناقشات السياسية ، والمساهمة في تحديد المعايير الأخلاقية وضمان استخدام الذكاء الاصطناعى للبئر الاجتماعية وليس فقط للربح. رحلة تحول الذكاء الاصطناعي ليست خطية وستتضمن التنقل من خلال الغموض والتحديات غير المتوقعة. لذلك يجب على المديرين زراعة خفة الحركة والمرونة التنظيمية حتى تتمكن فرقهم من التكيف مع التقدم التكنولوجي غير المتوقع أو التغييرات التنظيمية أو الاضطرابات المتعلقة بالسوق من قبل الذكاء الاصطناعي.

مناسب ل:

- العشرة الأوائل للاستشارات والتخطيط - نظرة عامة ونصائح حول الذكاء الاصطناعي: نماذج الذكاء الاصطناعي المختلفة ومجالات التطبيق النموذجية

فهم واستخدام التقنيات: قواعد الذكاء الاصطناعى لصانعي القرار

لم يعد التحول من خلال الذكاء الاصطناعي رؤية بعيدة للمستقبل ، بل هو الواقع الحالي الذي يتحدى الشركات من جميع الأحجام والصناعات وفي الوقت نفسه فرصًا هائلة. بالنسبة للمتخصصين والمديرين ، هذا يعني لعب دور نشط في تصميم هذا التغيير من أجل رفع إمكانات الذكاء الاصطناعى بمسؤولية وإدارة المخاطر المرتبطة بثقة.

تشكل أساسيات الذكاء الاصطناعي ، من النماذج التوليدية إلى التمييز بين المساعدين والوكلاء إلى الدوافع التكنولوجية مثل التعلم الآلي والنماذج الأساسية ، الأساس لفهم أعمق. هذه المعرفة ضرورية من أجل أن تكون قادرة على اتخاذ قرارات جيدة حول استخدام وتكامل أنظمة الذكاء الاصطناعي.

يضع الإطار القانوني ، وخاصة قانون الاتحاد الأوروبي KI ، إرشادات واضحة لتطوير وتطبيق الذكاء الاصطناعي. يتطلب النهج القائم على المخاطر والالتزامات الناتجة ، وخاصة بالنسبة للأنظمة عالية الخطورة وفيما يتعلق بكفاءة الذكاء الاصطناعى المطلوبة للموظفين ، مناقشة استباقية وتنفيذ هياكل الحوكمة القوية. يجب حل مجال التوتر بين السعي وراء الابتكار والحاجة إلى المساءلة من خلال استراتيجية متكاملة ترى الامتثال والأخلاق جزءًا لا يتجزأ من عملية الابتكار.

الاستخدامات المحتملة لمنظمة العفو الدولية متنوعة وعبر الصناعات. إن تحديد حالات الاستخدام المناسبة ، والتحكم في تقنيات التفاعل الفعالة مثل المطالبة والاستخدام الواعي لتطبيقات الظل هي الكفاءات الرئيسية من أجل تنفيذ القيمة المضافة لمنظمة العفو الدولية في مجال مسؤوليتك.

أخيرًا وليس آخرًا ، يغير الذكاء الاصطناعي الطريق بشكل مستدام ، كما هو موجه ، يعمل معًا ويعيش الإبداع. يتعين على المديرين تكييف مهاراتهم للتركيز أكثر على المهارات الإنسانية مثل التعاطف والتفكير النقدي وإدارة التغيير وخلق ثقافة يعمل فيها الأشخاص والآلة بتآزر. يتطلب الترويج للتعاون ودمج الذكاء الاصطناعى كشريك مبدع طرقًا جديدة للتفكير والإدارة.

إن إنشاء حكومة منظمة العفو الدولية الشاملة ليس ملحقًا اختياريًا ، ولكنه ضرورة استراتيجية. إنه ينشئ إطارًا للاستخدام الأخلاقي والشفاف والآمن لمنظمة العفو الدولية ، ويقلل من المخاطر ويبني الثقة في جميع أصحاب المصلحة.

تحول الذكاء الاصطناعي هو رحلة تتطلب التعلم المستمر والقدرة على التكيف ورؤية واضحة. المتخصصون والمديرون الذين يواجهون هذه التحديات ويستوعبون المبادئ والممارسات الموضحة هنا مجهزة تجهيزًا جيدًا لتصميم مستقبل منظماتهم ومناطقهم وفرقهم بثقة في عصر الذكاء الاصطناعي.